что это такое и как с ним работать – простыми словами

Что такое кэш

Кэш (cache) – это совокупность временных копий файлов программ, а также специально отведенное место их хранения для оперативного доступа. Соответственно, кэшированием называется процесс записи этих данных при работе операционной системы и отдельных программ. ОС и приложения кэшируют свои файлы в автоматическом режиме, чтобы впоследствии быстро загружать их из кэша и тем самым быстрее работать.

В чем заключается принцип работы кэша

Большая часть ПО сохраняет свои рабочие файлы в архиве или загружает их на сетевой сервер. Когда пользователь работает с программой, ему требуется некоторое время, чтобы извлечь эти данные. Ускорить процесс можно, сохраняя временные рабочие файлы в кэш, тем самым обходя процедуру разархивации или скачивания. Впоследствии, при очередном обращении программы к этим данным они будут загружаться оперативнее. Чаще всего временные файлы сохраняются в оперативной памяти. Это обусловлено присущей ей высокой скоростью считывания и записи, благодаря чему информация из нее извлекается очень быстро.

Это обусловлено присущей ей высокой скоростью считывания и записи, благодаря чему информация из нее извлекается очень быстро.

Какие существуют способы кэширования

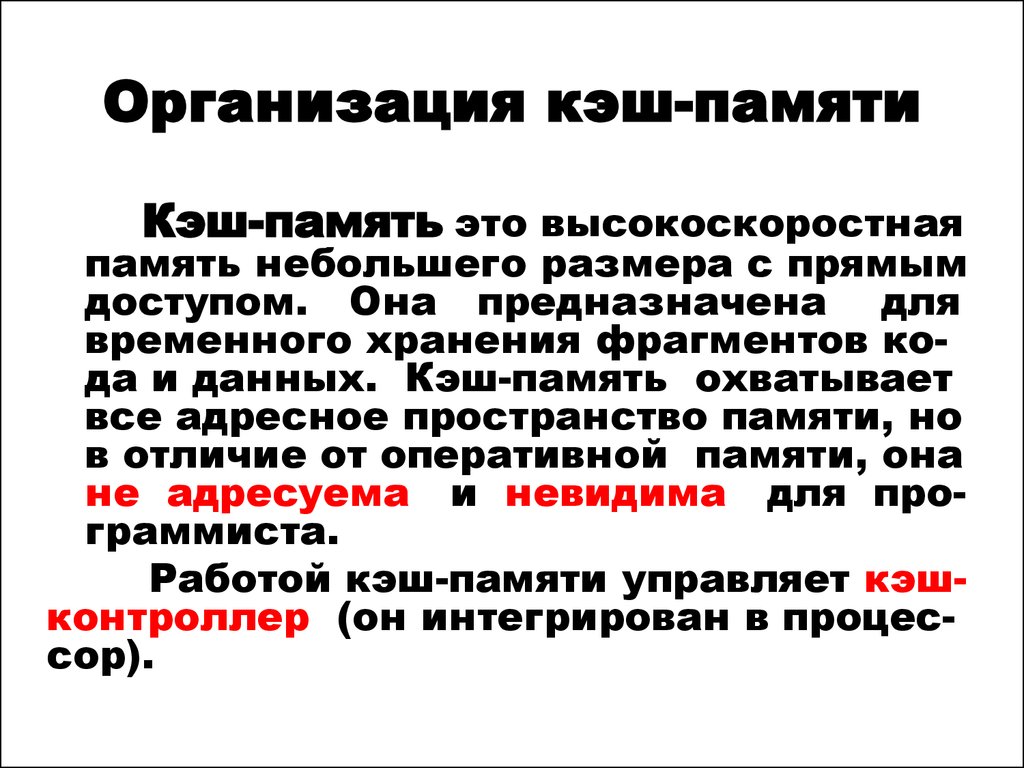

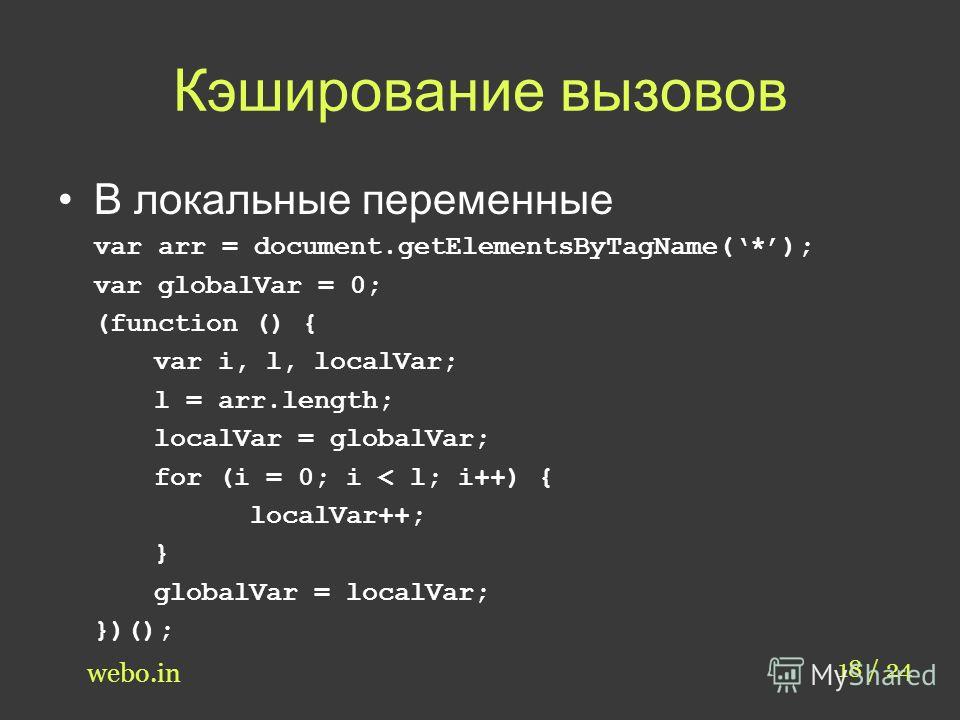

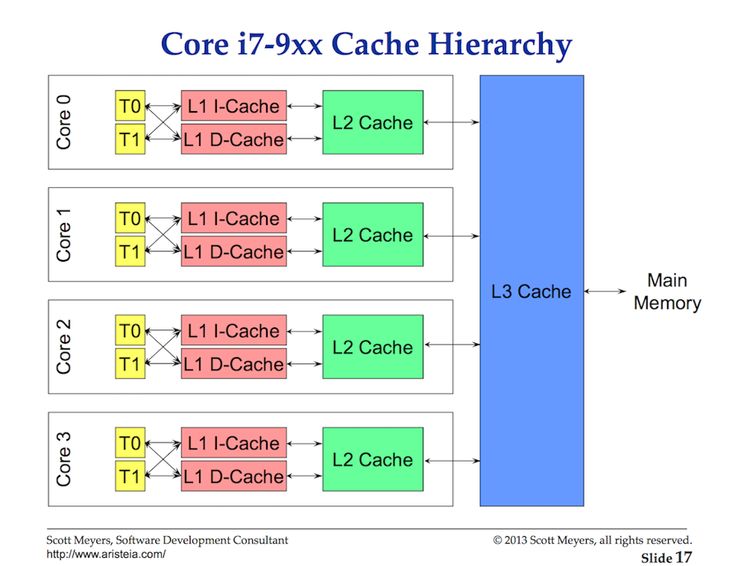

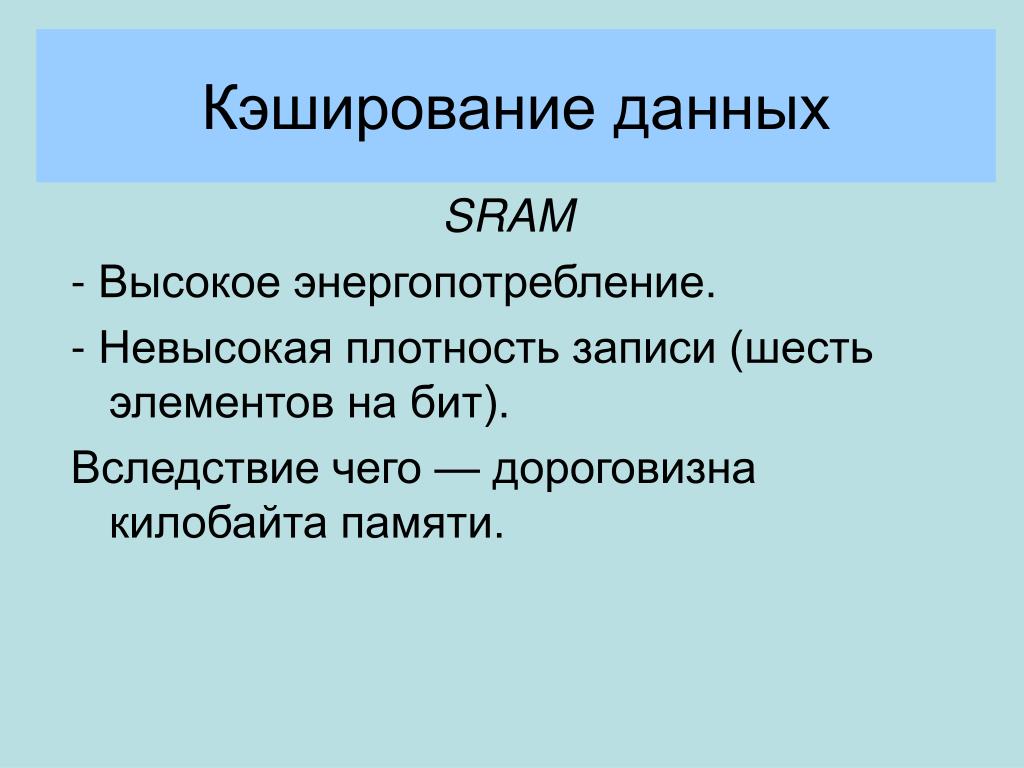

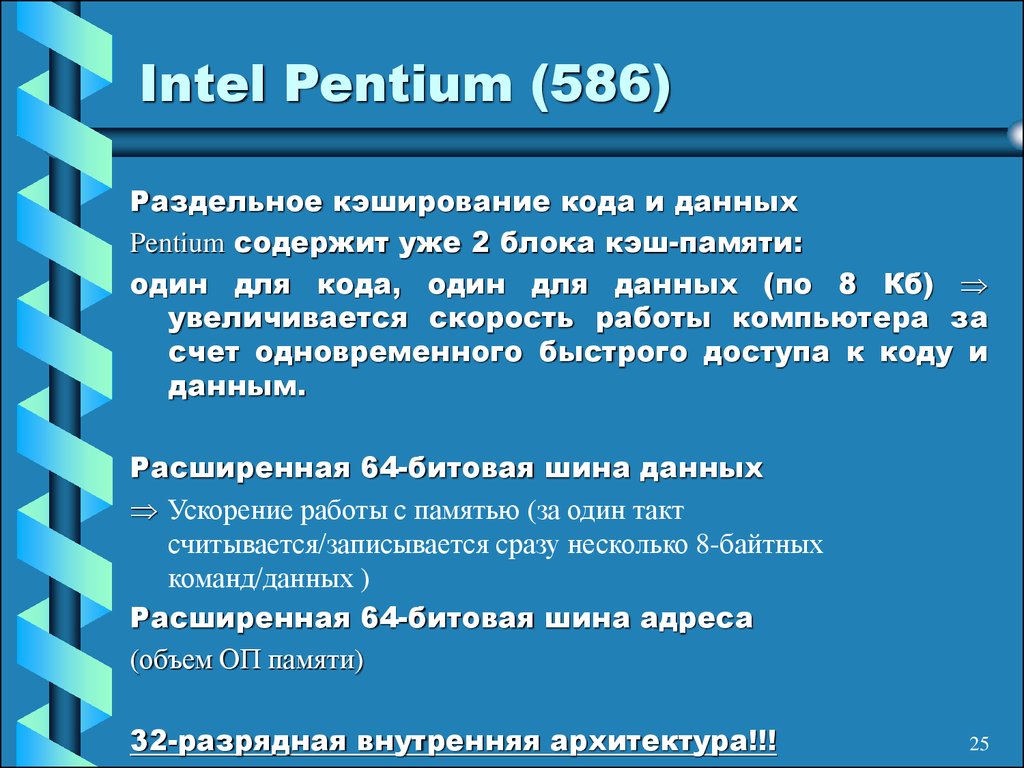

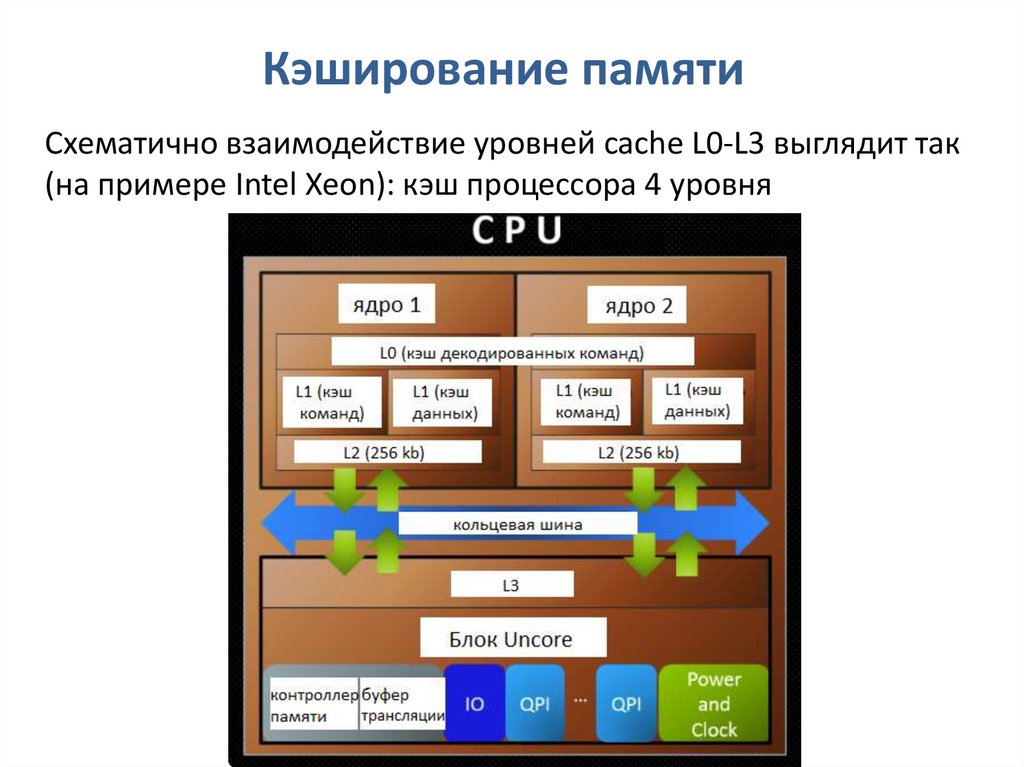

- Аппаратный. В этом случае временные файлы записываются на само устройство в специально отведенные для этого участки памяти. Например, аппаратное кэширование в центральном процессоре выполняется в трех видах cache-памяти – L1, L2 и L3. Это позволяет программам быстро извлечь их при необходимости без обращения к иным устройствам в системе.

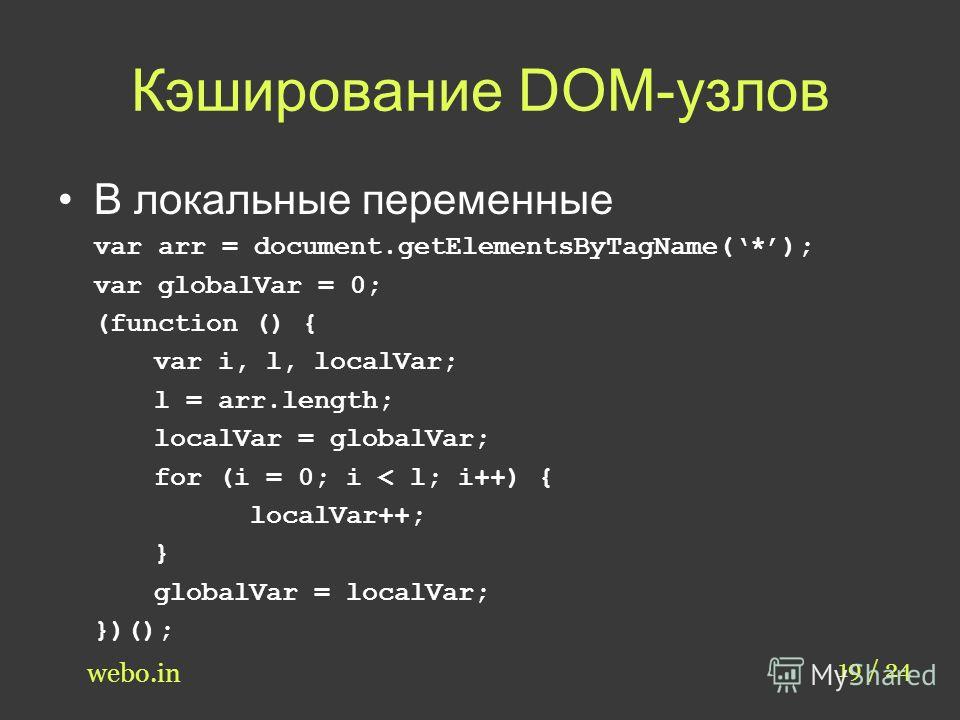

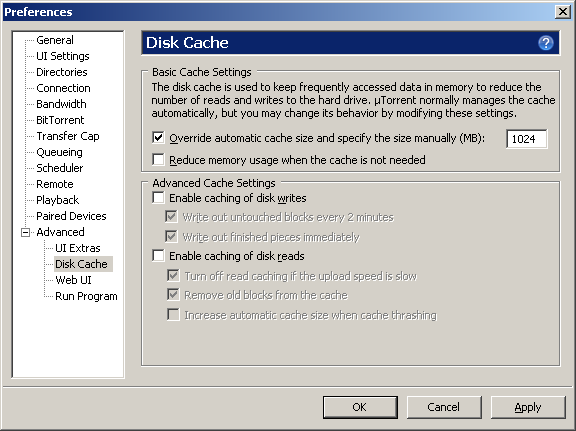

- Программный. Кэширование этого типа осуществляется в выделенный участок памяти в операционной системе (как правило, он имеет вид обычной папки). Расположение кэша у различных программ может быть разным. Например, браузеры сохраняют свои временные файлы в свои папки в разделе Document and Settings.

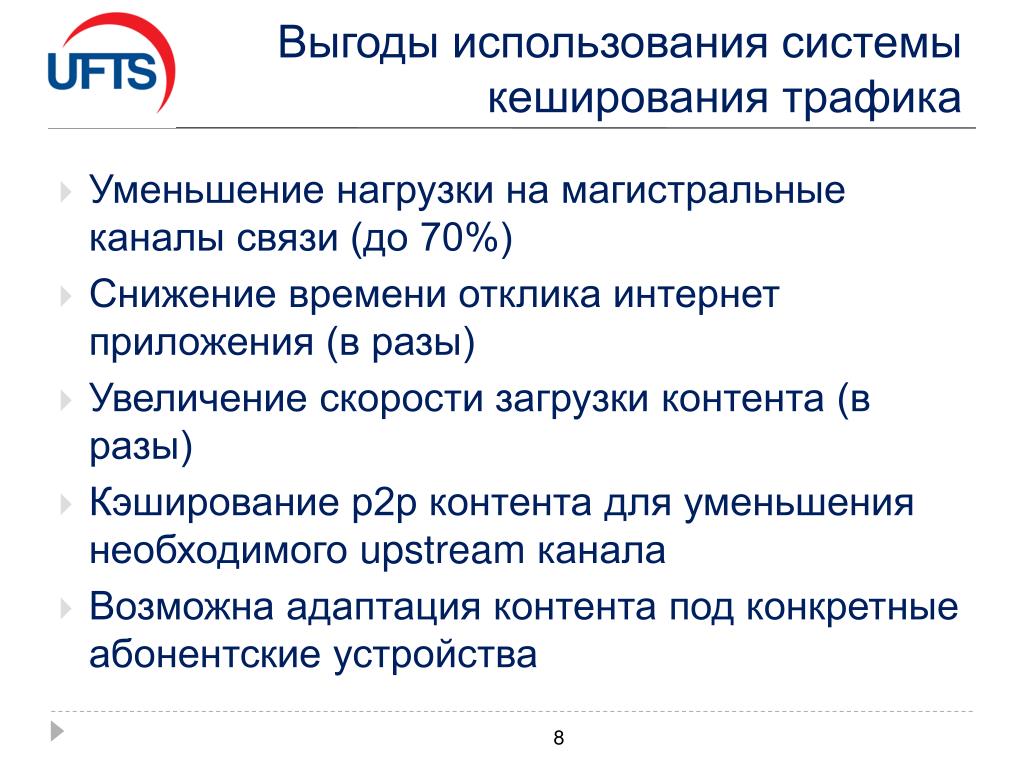

Независимо от того, какой из способов кэширования применяется, этот процесс обеспечивает:

- быстрый доступ к рабочим файлам;

- ускоренную загрузку ПО;

- экономию трафика;

- эффективное использование системных ресурсов;

- повышенную производительность аппаратного и программного обеспечения.

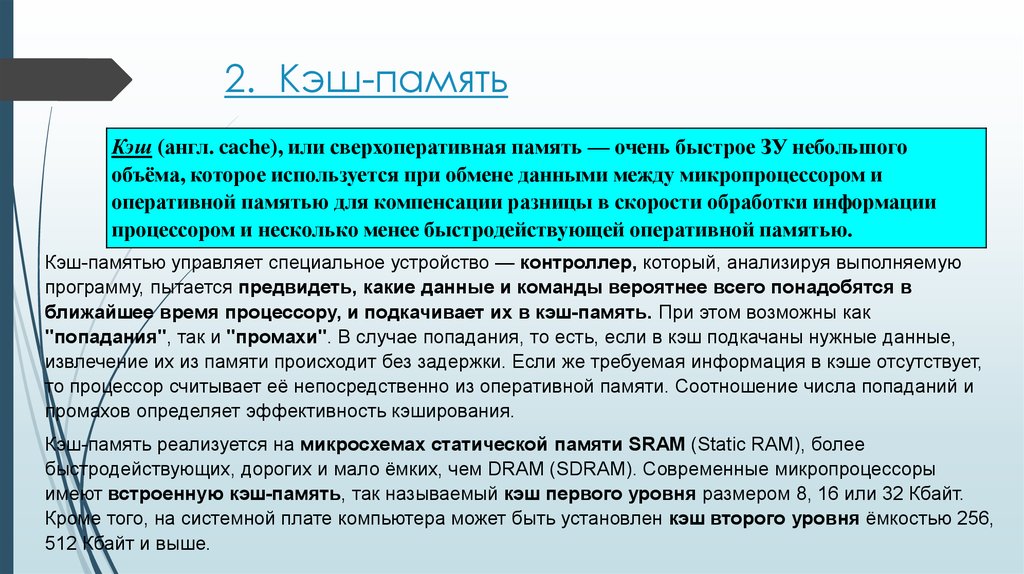

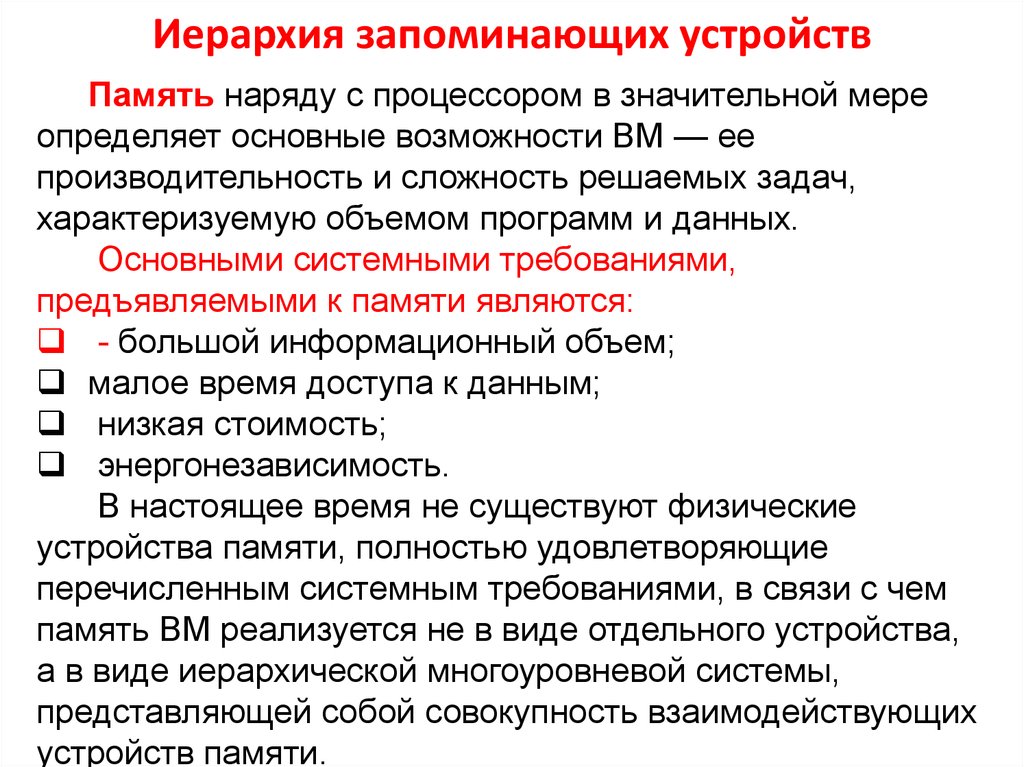

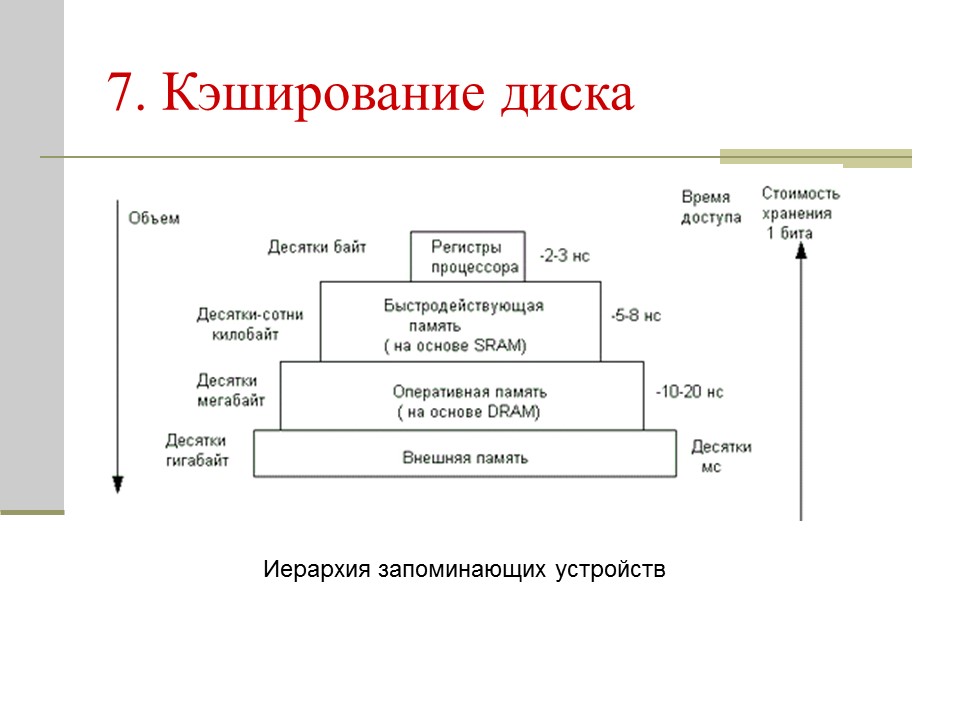

Что такое кэш-память

Кэш-память представляет собой интегрированный в устройство выделенный раздел памяти для сохранения в нем временных рабочих данных и быстрого их извлечения. Она имеется в процессорах и иных устройствах (оперативной памяти, жестком диске) и обеспечивает существенный рост производительности и скорости обработки информации за счет оперативного доступа к нужным файлам. На флеш-накопителях (SSD) ее размер составляет до 4 Гб, на хард-дисках (HHD) – до 256 Мб.

При аппаратном кэшировании временные файлы удаляются, как правило, автоматически, участия пользователя в этом процессе не требуется. Часто он даже не знает о существовании такой системной функции.

Как происходит очистка кэша

Удаление временных рабочих файлов в ОС выполняется, за редким исключением, автоматически и не нуждается в контроле пользователя. Например, для очистки кэша браузера достаточно одновременно нажать комбинацию клавиш Ctrl + F5 на открытой интернет-странице.

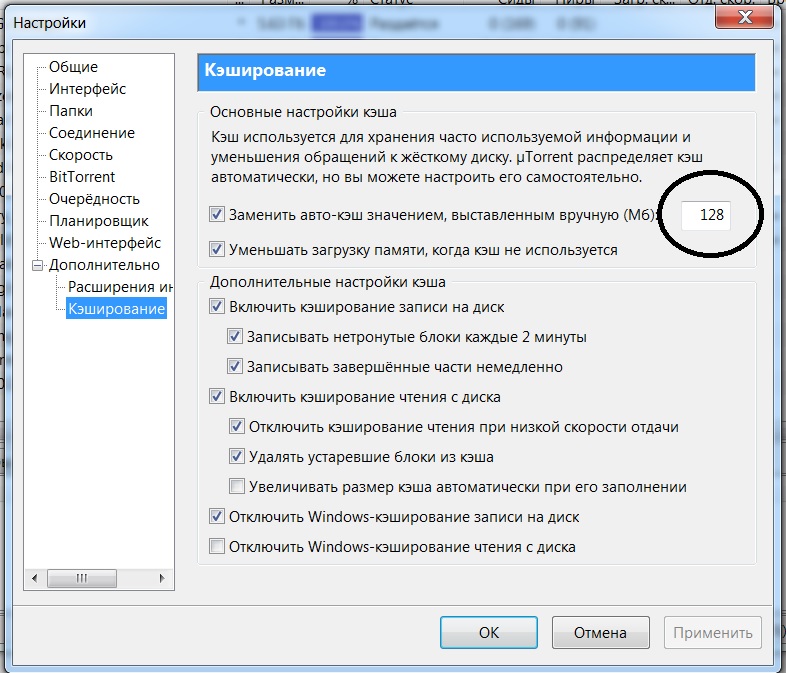

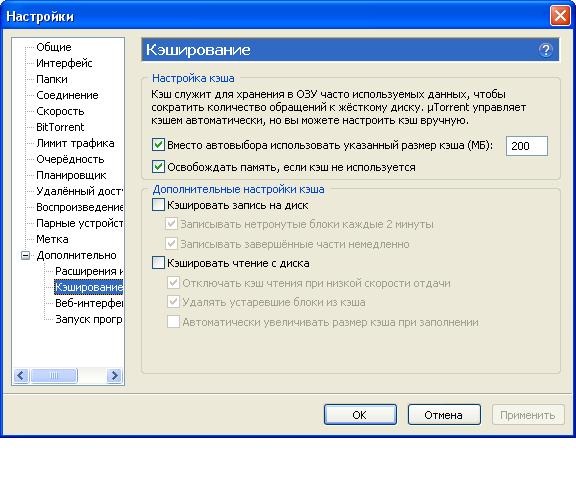

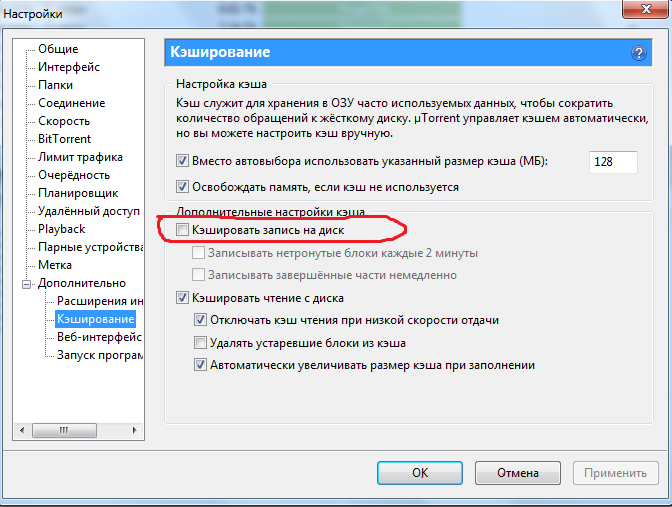

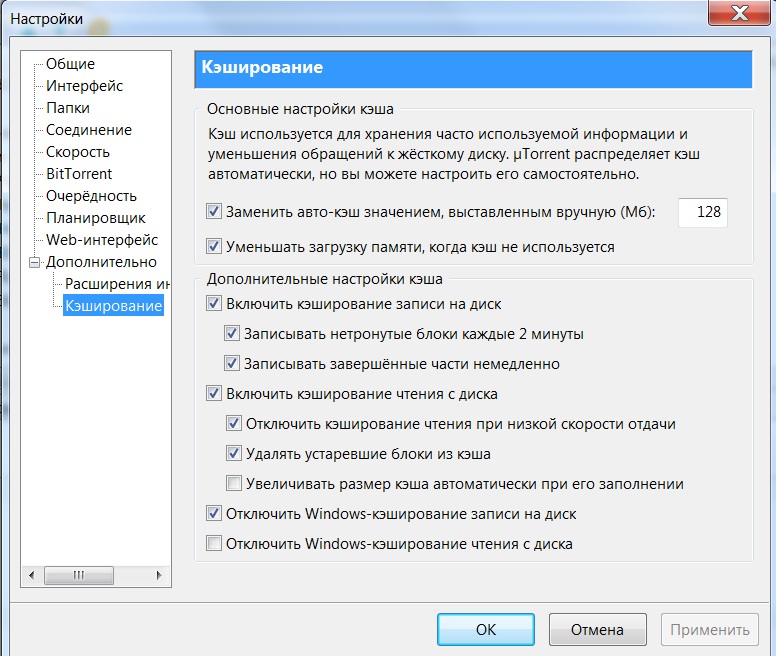

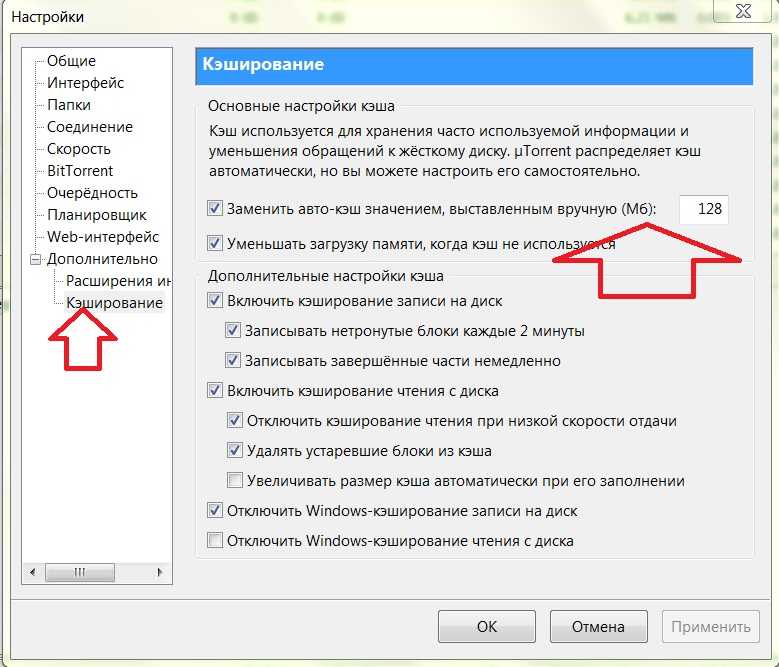

В других программах удаление временных данных осуществляется в настройках. Для этого необходимо зайти в соответствующий раздел меню и очистить кэш вручную. В операционной системе Windows таким образом выполняется очистка, как правило, только у браузеров. В iOS на iPhone или iPad данный процесс выполняется в полностью автоматическом режиме, а вот пользователям устройств с ОС Android часто нужно осуществлять его вручную. Однако с выходом каждой новой версии этой операционной системы процедура очистки временных файлов становится более понятной и автоматизированной.

Нужно ли чистить кэш

Иногда кэширование файлов работает некорректно. Из-за этого, например, может загружаться старый контент вместо нового. Зачастую такое случается именно в браузерах. По этой причине кэш необходимо периодически подчищать. Если этого не сделать, то при обновлении данных на сайте (например, при загрузке новых фотографий или изменении стилей) браузер может закачать устаревшую версию контента.

Для его очистки и загрузки актуального содержимого достаточно применить на активной интернет-странице комбинацию Ctrl + F5, после чего она перезагрузится с обновленным наполнением.

В заключение

Мы рассмотрели основные аспекты работы кэша, описали простыми словами, что значит определение, разобрались в назначении процесса и оценили важность регулярной очистки. Эта информация поможет вам эффективно расходовать системные ресурсы своего компьютера, предотвратить возможные сбои при наполнении контентом сайтов, ускорить загрузку и функционирование программного обеспечения. Усвоив эти несложные рекомендации, вы сможете быстрее работать и просто наслаждаться легким и удобным серфингом в интернете.

Другие термины на букву «К»

КлишеКлоноводКоды ошибокКоды перенаправленияКоллтрекингКомьюнитиКонверсияКонтекстная рекламаКонтент

Все термины SEO-Википедии

Теги термина

Что такое кэширование? | Microsoft Azure

Разработчики и ИТ-специалисты используют кэширование для сохранения данных типа “ключ-значение” во временной памяти и получения к ним более быстрого доступа, чем к данным, хранящимся в обычном хранилище данных.

Кэширование можно использовать, чтобы снизить затраты на базу данных, обеспечить более высокую пропускную способность и меньшею задержку, чем может обеспечить большинство баз данных, а также повысить производительность облачных и веб-приложений.

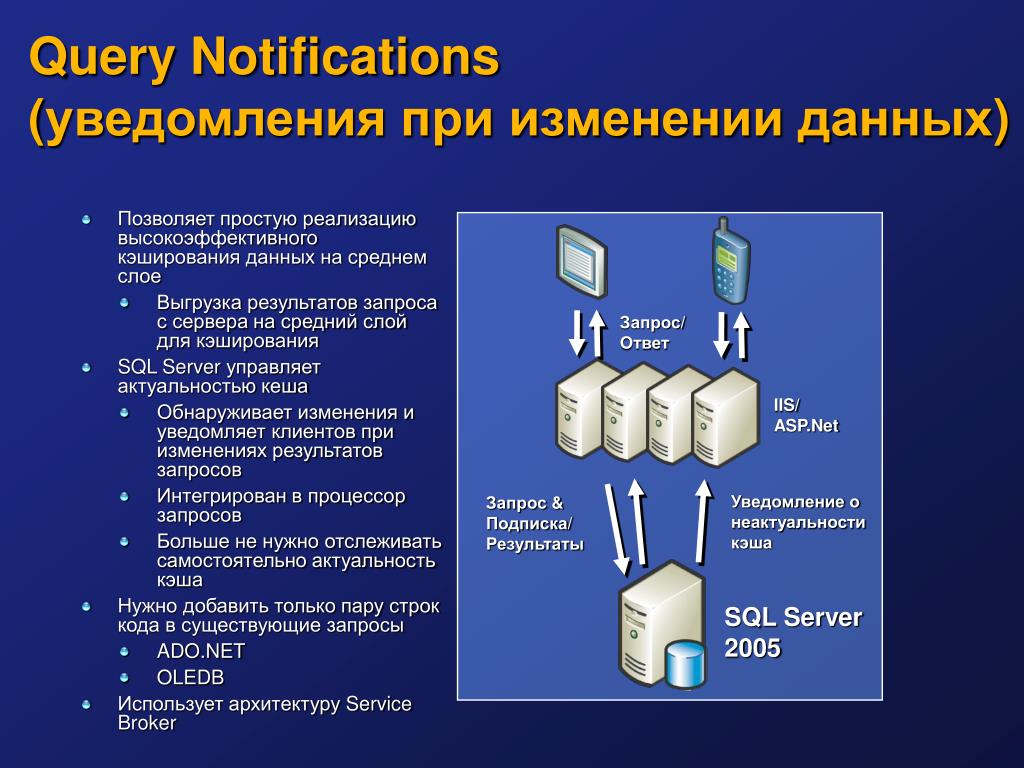

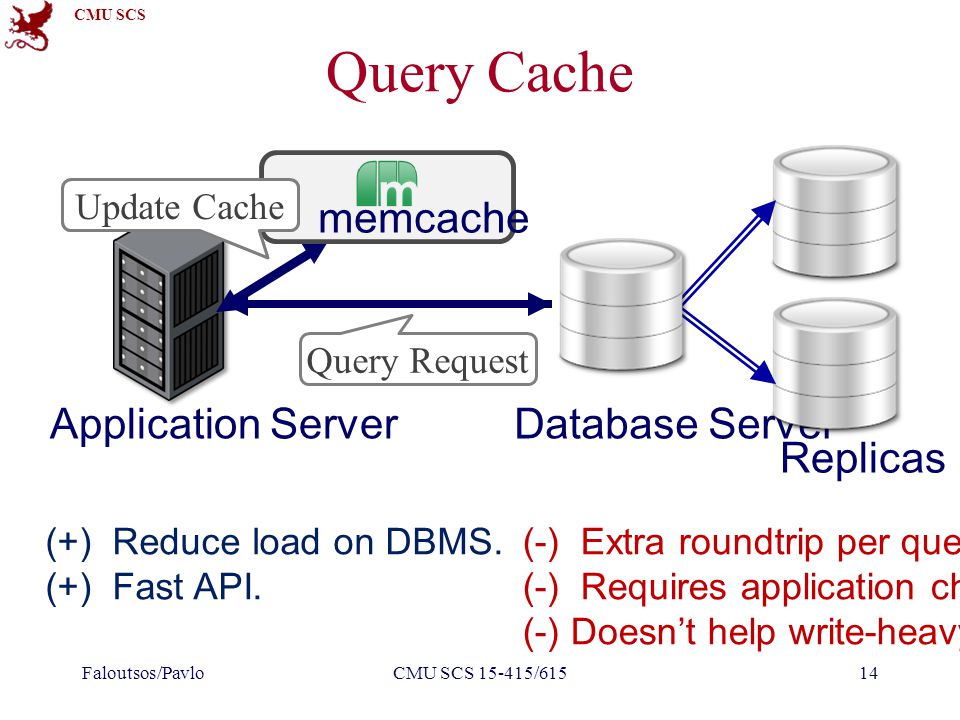

Как работает кэширование в базах данных?

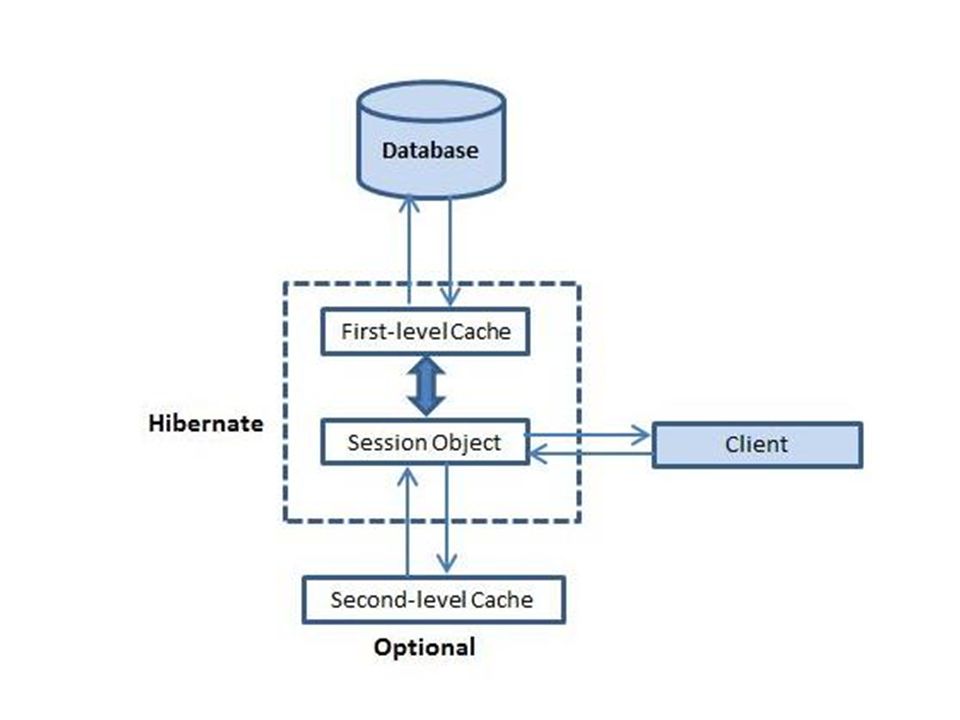

Разработчики могут добавить кэш в базу данных-источник, который можно разместить в базе данных или приложении, либо настроить его как отдельный уровень. Обычная база данных, как правило, используется для хранения больших и полных наборов данных длительного пользования, а кэш для хранения временных подмножеств данных с целью быстрого их извлечения.

Обычная база данных, как правило, используется для хранения больших и полных наборов данных длительного пользования, а кэш для хранения временных подмножеств данных с целью быстрого их извлечения.

Кэширование можно использовать со всеми типами хранилищ данных, включая базы данных NoSQL, а также реляционные базы данных, такие как SQL Server, MySQL и MariaDB. Кэширование также хорошо работает со многими специфическими платформами обработки данных, такими как База данных Azure для PostgreSQL, База данных SQL Azure и Управляемый экземпляр SQL Azure. Прежде чем приступать к настройке архитектуры данных, рекомендуется изучить, какой тип хранилища данных будет соответствовать вашим требованиям наилучшим образом. Например, вам необходимо понять, что представляет собой база данных PostgreSQL, прежде чем использовать ее для объединения реляционных и неструктурированных хранилищ данных.

Каковы преимущества многоуровневого кэша? И что такое Redis?

Разработчики используют многоуровневое кэширование, называемое также уровнями кэширования, для хранения различных типов данных в отдельных кэшах в соответствии с потребностями приложений. Добавление одного или нескольких уровней кэширования позволяет существенно повысить пропускную способность и производительность уровня данных с задержкой.

Добавление одного или нескольких уровней кэширования позволяет существенно повысить пропускную способность и производительность уровня данных с задержкой.

Redis — это популярное хранилище данных в памяти с открытым исходным кодом, используемое для создания высокопроизводительных многоуровневых кэшей и других хранилищ данных. Недавнее исследование показало, что использование образца приложения совместно с Кэшем Azure для Redis увеличивает пропускную способность данных более чем на 800 % и уменьшает время задержки более чем на 1000 %

Кэши также позволяют снизить совокупную стоимость владения уровнем данных. Используя кэши для сохранения наиболее распространенных запросов и снижения нагрузки на базу данных, вы можете уменьшить количество приобретаемых экземпляров базы данных, что приведет к значительной экономии средств и снижению совокупной стоимости владения.

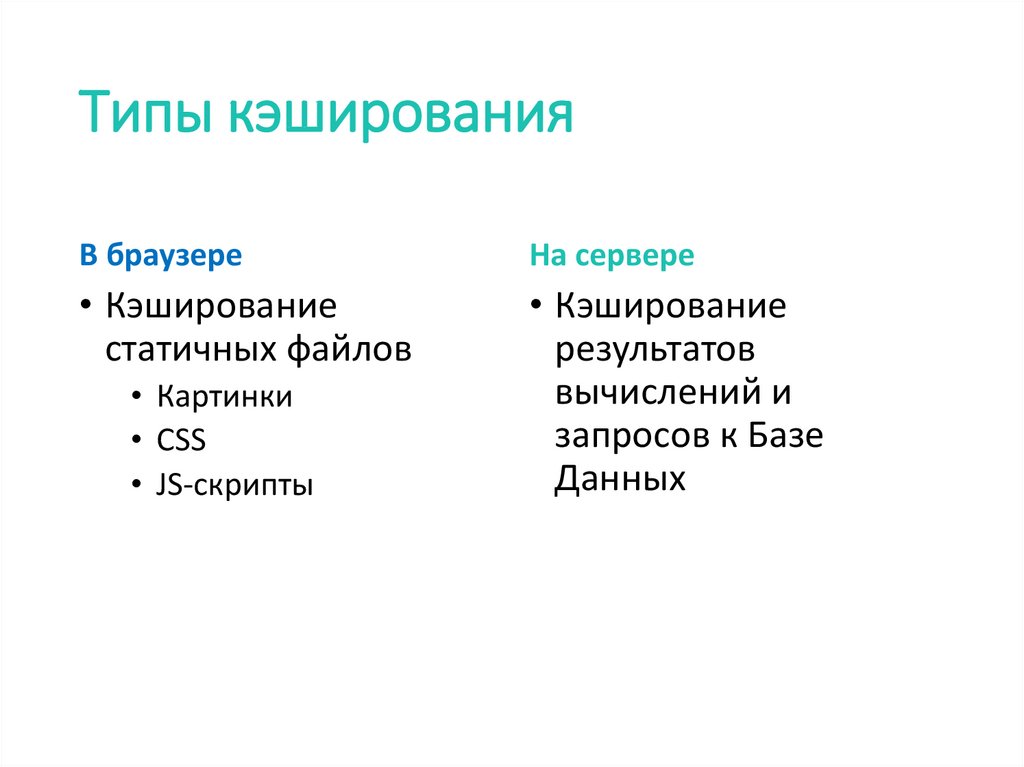

Типы кэширования

Стратегия кэширования зависит от того, как приложение считывает и записывает данные.

Кэш на стороне

Для приложений, выполняющих большое количество операций чтения, разработчики часто используют модель программирования «кэш на стороне». Они размещают кэш вне приложения, которое затем подключается к кэшу для запроса и получения данных или соединяется напрямую с базой данных, если данных в кэше нет. После получения данных приложение копирует их в кэш для будущих запросов.

Кэш на стороне можно использовать, чтобы повысить производительность приложения, обеспечить согласованность данных в кэше и хранилище, а также предотвратить устаревание данных в кэше.

Кэш сквозного чтения и сквозной записи

Данные кэшей сквозного чтения постоянно обновляются..jpg) При использовании кэшей сквозной записи приложение сначала записывает данные в кэш, а затем в базу данных. Эти кэши тесно интегрированы с базой данных, и приложение рассматривает их как основное хранилище данных.

При использовании кэшей сквозной записи приложение сначала записывает данные в кэш, а затем в базу данных. Эти кэши тесно интегрированы с базой данных, и приложение рассматривает их как основное хранилище данных.

Кэши сквозного чтения позволяют упростить работу приложений, в которых регулярно запрашиваются одни и те же данные. При этом сам кэш имеет сложную структуру, а двухэтапный процесс сквозной записи может вызывать задержки. Разработчики сочетают разные типы кэшей, чтобы обеспечить согласованность данных в кэше и базе данных, уменьшить задержку в работе кэша сквозной записи и упростить обновление кэша сквозного чтения.

С помощью кэшей сквозного чтения и сквозной записи разработчики могут упростить код приложения, увеличить масштабируемость кэша и уменьшить нагрузку на базу данных.

Кэш отложенной или обратной записи

В этом сценарии приложение записывает данные в кэш, которые сразу подтверждаются, а затем кэш записывает данные в базу данных в фоновом режиме. Кэши отложенной записи, также известные как кэши обратной записи, лучше всего подходят для рабочих нагрузок с интенсивной записью данных. Они повышают производительность записи, так как приложению не требуется ждать завершения записи, чтобы перейти к выполнению следующей задачи.

Кэши отложенной записи, также известные как кэши обратной записи, лучше всего подходят для рабочих нагрузок с интенсивной записью данных. Они повышают производительность записи, так как приложению не требуется ждать завершения записи, чтобы перейти к выполнению следующей задачи.

Распределенный кэш и хранилище сеансов

Пользователи часто путают распределенные кэши и хранилища сеансов, которые похожи, но имеют разные требования и назначения. Вместо добавления в базу данных распределенного кэша разработчики внедряют хранилища сеансов — хранилища временных данных на уровне пользователя, чтобы хранить профили, сообщения и другие пользовательские данные сеансовых приложений, таких как веб-приложения.

Что такое хранилище сеансов?

Сеансовые приложения отслеживают действия, выполняемые пользователями при входе в систему. Чтобы сохранить эти данные при выходе пользователя из системы, их можно сохранить в хранилище сеансов. Это позволит улучшить управление сеансами, снизить затраты и повысить производительность приложений.

Это позволит улучшить управление сеансами, снизить затраты и повысить производительность приложений.

В чем различия между хранилищем сеансов и кэшем базы данных?

В хранилище сеансов, как правило, записываются данные с коротким сроком хранения, а в кэш базы данных-источника с длительным сроком хранения. Хранилище сеансов требует репликации, высокой доступности и надежности данных, чтобы гарантировать сохранность данных транзакций и присутствие пользователей в системе. С другой стороны, если данные кэша на стороне теряются, в постоянной базе данных остается их копия.

Преимущества кэширования

Улучшение производительности приложений

Чтение данных из кэша в памяти происходит намного быстрее, чем чтение данных из дискового хранилища данных. Быстрый доступ к данным, в свою очередь, позволяет существенно улучшить общую производительность приложений.

Уменьшение нагрузки на базу данных и сокращение затрат

Кэширование позволяет уменьшить количество запросов к базе данных, повысить ее производительность и снизить издержки, устраняя необходимость в масштабировании инфраструктуры базы данных и снижая затраты на пропускную способность.

Масштабируемая и прогнозируемая производительность

Один экземпляр кэша позволяет обрабатывать миллионы запросов в секунду, обеспечивая такой уровень пропускной способности и масштабируемости, который не может обеспечить ни одна база данных. Кэширование также обеспечивает гибкость, которая необходима для горизонтального и вертикального масштабирования приложений и хранилищ данных.

Для чего используется кэширование?

Кэширование выводимых данных

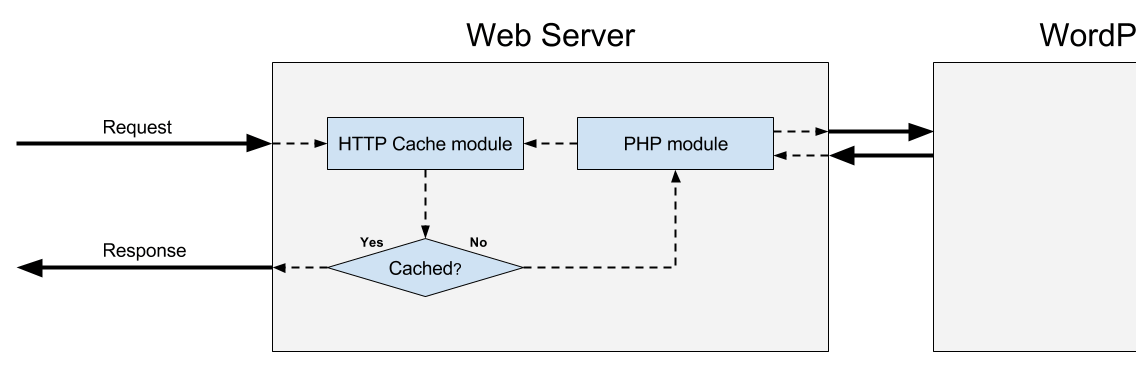

Кэширование выводимых данных позволяет повысить производительность веб-страниц благодаря сохранению их полного исходного кода, например HTML-сценариев и клиентских сценариев, которые сервер отправляет браузерам для отображения. Каждый раз, когда пользователь просматривает веб-страницу, сервер кэширует выводимый код в памяти приложения. Это позволяет приложению обрабатывать запросы без запуска кода страницы и без взаимодействия с другими серверами.

Кэширование данных и баз данных

Скорость и пропускная способность базы данных может иметь большое значение для общей производительности приложений. Кэширование используется для часто вызываемых данных, которые редко меняются, например данные о ценах или запасах. Кэширование способствует более быстрой загрузке веб-сайтов и приложений благодаря увеличению пропускной способности и уменьшению времени задержки при получении данных из серверных баз данных.

Кэширование используется для часто вызываемых данных, которые редко меняются, например данные о ценах или запасах. Кэширование способствует более быстрой загрузке веб-сайтов и приложений благодаря увеличению пропускной способности и уменьшению времени задержки при получении данных из серверных баз данных.

Хранение данных сеансов пользователей

Пользователи приложений часто создают данные, которые необходимо хранить в течение короткого периода времени. Хранилище данных в памяти, такое как Redis, лучше подходит для эффективного, экономного и надежного хранения больших объемов данных сеансов, например данных, вводимых пользователями, записей корзины или параметров персонализации, чем хранилища или базы данных.

Брокеры сообщений и архитектуры типа «издатель-подписчик»

Облачным приложениям часто требуется обмениваться данными между службами. Они могут использовать кэширование для реализации брокеров сообщений и архитектур типа «издатель-подписчик», чтобы уменьшить задержку и ускорить управление данными.

Приложения и API

Как и браузеры, приложения сохраняют важные файлы и данные, чтобы в случае необходимости быстро получать к ним доступ. Кэширование ответов API уменьшает нагрузку на серверы и базы данных приложений, обеспечивая более быстрое время отклика и более высокую производительность.

1Утверждения о производительности основаны на данных исследования, проведенного компанией GigaOm в октябре 2020 г. по заказу корпорации Майкрософт. В исследовании сравнивается производительность тестового приложения, использующего базу данных Azure с реализацией Кэша Azure для Redis в качестве решения для кэширования и без нее. В качестве элемента базы данных в исследовании использовались База данных SQL Azure и База данных Azure для PostgreSQL. Использовался экземпляр Базы данных SQL Azure общего назначения 5-го поколения с 2 виртуальными ядрами и экземпляр Базы данных Azure для PostgreSQL общего назначения с 2 виртуальными ядрами в сочетании с экземпляром Azure для Redis уровня P1 Premium на 6 ГБ.

Добавьте в свое приложение гибкий уровень кэширования с помощью полностью управляемой службы Redis. Узнайте, как начать работу с Кэшем Azure для Redis.

Начать

Если вы хотите реализовать гибкое кэширование на основе файлов для высокопроизводительных приложений, ознакомьтесь со сведениями об Azure HPC Cache.

Azure HPC Cache

Кэширование: определение, проверка, настройка, и как оно вообще работает

Кэширование — это способ временно сохранить информацию из прошлых запросов пользователя, чтобы в будущем быстрее ее предоставить.

Кэширование является стратегическим процессом, обеспечивающим высокую производительность программ. Однако кэширование должно быть разумным, так как оно обладает побочными эффектами.

Кэшированные данные — информация, сохраненная локально в памяти устройства, которую пользователь чаще всего использует. Обычно это информация о разных приложениях, если мы говорим об устройстве. Но в каждом браузере организовано веб-кэширование. Это процесс сохранения информации внутри браузера о посещенных веб-сайтах. Благодаря этому процессу браузеру не нужно постоянно обращаться к серверу о часто посещаемом веб-ресурсе, что экономит время пользователя.

Однако размер кэша не безграничен. Кэшированные данные занимают память, а это значит, что если не ставить ограничения на объем кэша и не проводить периодическую «чистку», тогда есть риск, что память переполнится. Переполнение памяти грозит аварийным завершением работы устройства или программы.

Кэширование — что это?

Кэширование — это технология сохранения копии информации в локальной памяти.

Этот процесс часто связан с информацией, которую создавать повторно дорого или долго. Извлечение такой информации непосредственно из памяти устройства дешевле и быстрее.

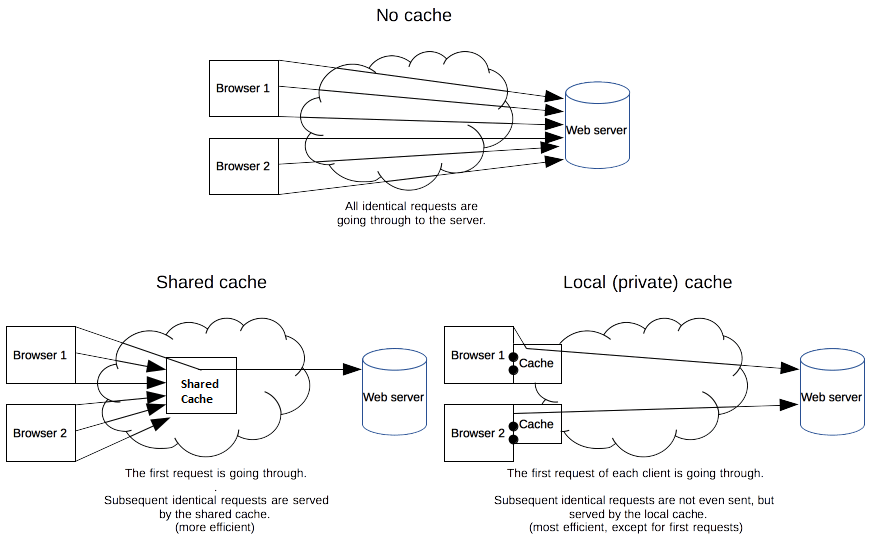

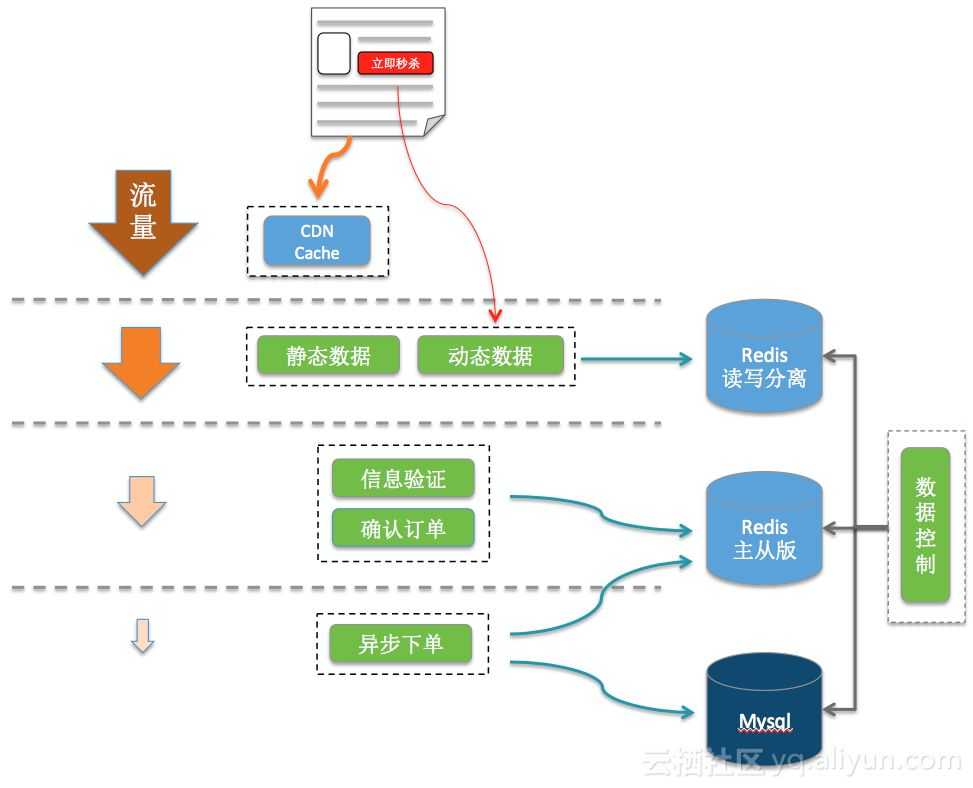

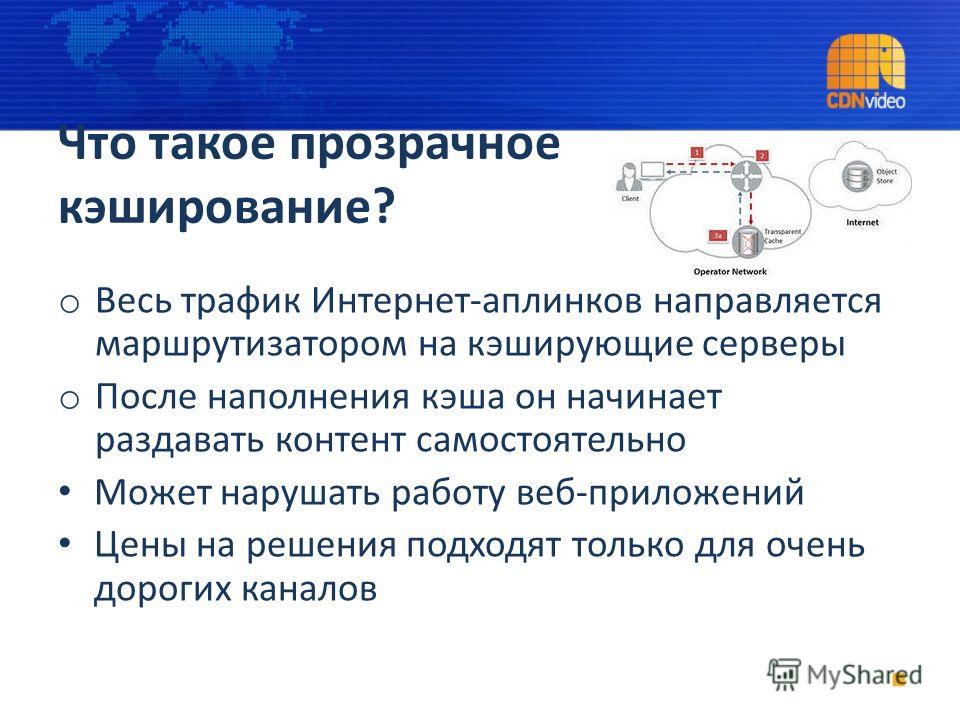

Кэширование — это многоуровневый процесс. Рядовой пользователь знаком с кэшированием на уровне браузера, когда проводится чистка кэша и его истории, или на уровне устройства, когда чистится кэш и «мусорные файлы» телефона или компьютера. Однако это не все уровни кэширования. Между пользователем и сервером-источником информации различают следующие уровни кэширования:

общие кэшированные данные веб-сервера — обычно это информация сразу для нескольких пользователей;

кэшированные данные сети доставки информации — это также информация сразу о нескольких пользователях;

кэширование интернет-провайдера — это также кэш сразу о нескольких пользователях;

кэшированные данные устройства — это информация о запускаемых программах;

кэширование веб-браузера — информация о посещенных веб-страницах.

Каждый отдельный пользователь имеет влияние только на последние два уровня кэширования: кэш устройства и веб-браузера.

Что такое кэшированные данные и их актуальность

Кэшированные данные — это некая сохраненная информация. Однако несложно догадаться, что такая информация устаревает, потому что кэшированный ресурс постоянно изменяется. Но для пользователя важно получать «свежую» информацию. Чтобы поддерживать актуальность кэша, важно постоянно его обновлять.

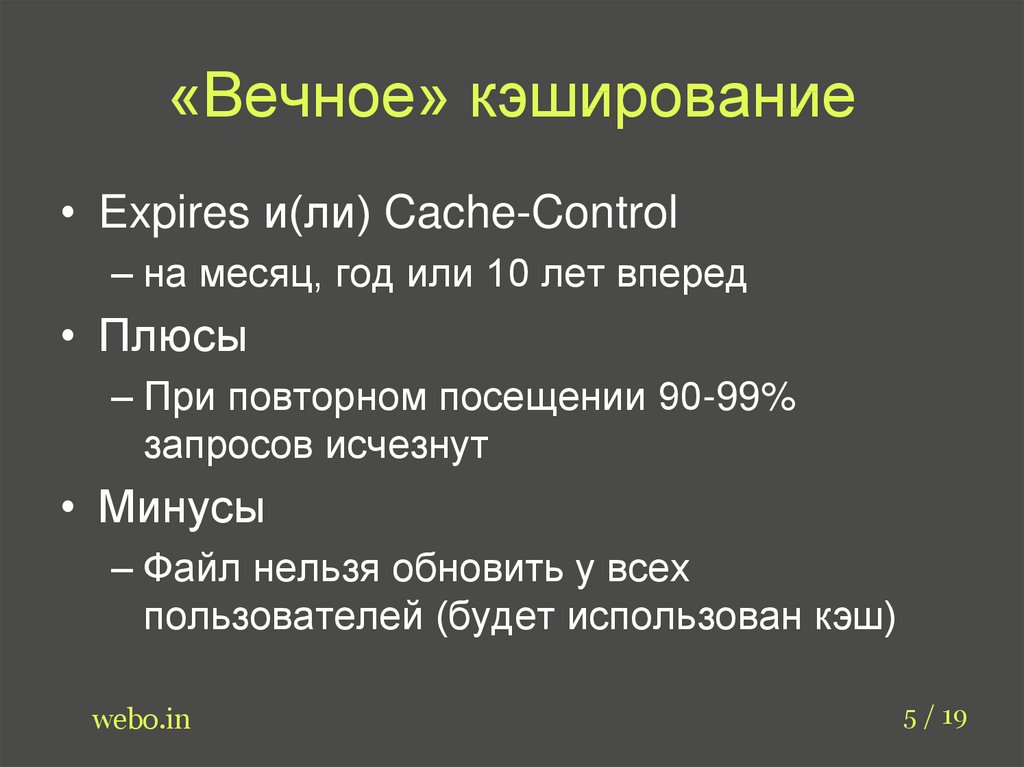

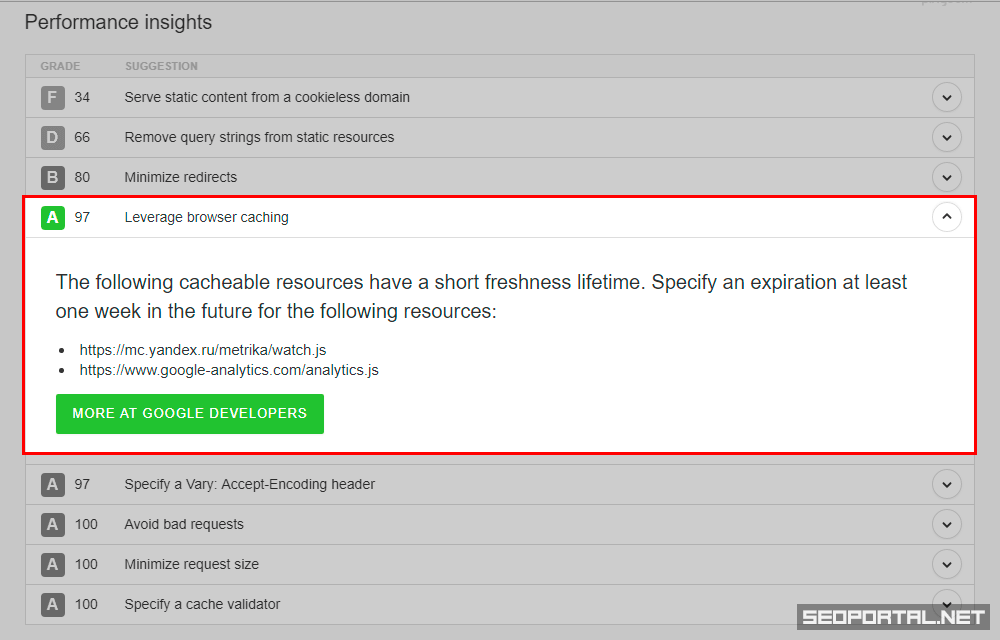

Кэшированные данные не сравниваются с данными сервера при каждом обращении к ним. Если бы это делалось, тогда смысла в кэшировании не было бы, потому что тратилось бы много времени на проверку актуальности информации, плюс дополнительно нагружалась бы сеть. Поэтому принято считать кэшированные данные актуальными и отправлять их пользователю в течение определенного времени. Время актуальности информации определяется параметрами кэша. То есть при определении кэша для ресурса ему задается период времени, во время которого кэш считается актуальным.

Таким образом, браузер, запуская веб-ресурс из кэша, не проверят его актуальность с серверной версией, а лишь следит, чтобы кэш соответствовал определенному периоду. Если кэш «устарел», тогда браузер скачивает с сервера его свежую копию и отправляет ее пользователю. Если кэш актуальный, тогда информация сразу доставляется пользователю.

Чуть выше мы описали работу кэширования в браузере. Однако на уровне сервера оно происходит по похожему алгоритму, только сервер кэширует данные для нескольких пользователей. Плюс кэширует в больших масштабах, чем браузер. Например, в кэше сохраняются часто используемые веб-сайты и хранимый на них контент: аудио, видео, изображения, статьи и др. Такой подход позволяет серверам быстрее показывать веб-сайты пользователям.

Кэширование и его преимущества

Для разных уровней кэширования этот процесс несет свои преимущества. Например:

Снижает стоимость запросов.

Потому что есть возможность кэшировать контент ближе к потребителю, а значит, для предоставления контента не нужно проходить весь путь по сети.

Повышает отзывчивость. Потому что пользователь быстрее получает кэшированный контент, например, из браузера — практически мгновенный процесс. А это значит, что пользователь может быстрее взаимодействовать с контентом.

Повышает производительность. Так как кэширование происходит на разных уровнях, это означает, что нагрузка на обслуживание пользователя плавно распределяется. В конечном счете распределение нагрузки улучшает общую производительность.

Оставляет контент доступным. В случае коротких сбоев в сети кэшированные данные остаются доступными для пользователя.

Кэшировать можно не весь контент. Например, контент, который очень быстро меняется, нужно кэшировать осторожно, потому что есть риск, что пользователю будет показана не свежая информация.

Категорически не рекомендуется кэширование конфиденциальной информации, например, личные данные или банковские реквизиты.

Стратегии кэширования

Идеальный интернет — это если можно было бы закэшировать все веб-ресурсы максимально близко к пользователям. Однако с технической стороны это не представляется возможным, поэтому стратегию кэширования приходится балансировать между меняющимся контентом и временем кэша.

Есть такие ситуации, когда реализовать кэширование невозможно. Например, когда на сайте присутствует динамический контент, который очень часто меняется, или контент, который генерируется для каждого отдельного пользователя. Если закэшировать такой ресурс, тогда пользователю будет предоставляться неточный контент.

Нет единой стратегии кэширования. Для каждого отдельного ресурса этот процесс будет иметь собственное значение. Важно помнить, что при создании кэша нужно соблюдать баланс. Поэтому нужно брать во внимание, что на каждом веб-ресурсе будут:

компоненты, которые можно надолго кэшировать;

компоненты, у которых срок кэширования будет коротким;

компоненты, которые нельзя кэшировать.

Заключение

Кэширование — это способ быстрее показать нужный контент для пользователя, увеличить производительность, сократить расходы на обслуживание компонентов сайта и др. При этом не нужно думать, что кэшированные данные — это волшебная палочка для веб-ресурса. Кэширование — это еще один инструмент, чтобы сделать контент и пользователя «ближе».

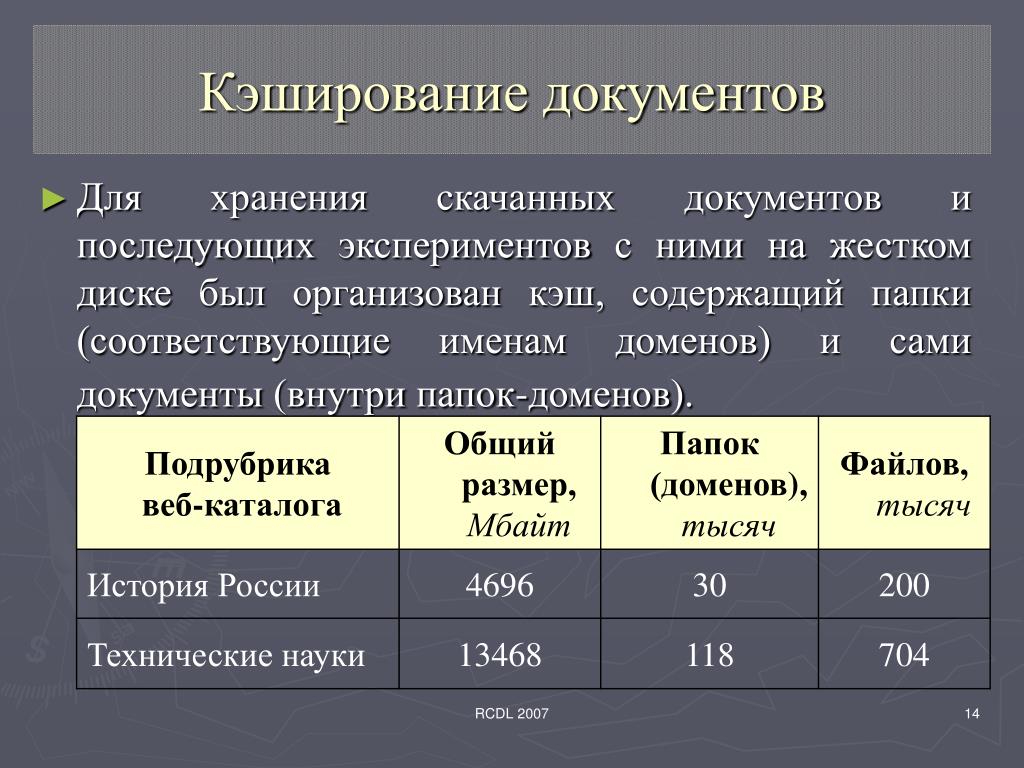

Что такое кэширование карт?—ArcGIS Server

Кэширование карт — это способ ускорить работу ваших картографических сервисов и сервисов изображений. При создании кэша карты сервер отрисовывает карту на нескольких уровнях масштабирования и сохраняет копии этих изображений. После этого, когда кто-нибудь запрашивает карту, сервер может предоставить эти изображения. Всякий раз, когда сервер получает запрос на карту, он гораздо быстрее возвратит кэшированное изображение, чем заново нарисует карту. Другое преимущество кэширования состоит в том, что высокая детализация изображения не сказывается на времени предоставления информации.

Что происходит во время процесса кэширования?

Кэширование не происходит автоматически. Чтобы создать кэш, сначала нужно разработать карту, а затем предоставить ее для совместного использования. После этого нужно задать параметры кэша и начать создание листов. Можно создать все листы сразу или предоставить возможность формирования некоторых листов при необходимости, т.е. при первом обращении к ним.

При кэшировании карты вы отрисовываете ее на нескольких заданных уровнях масштабирования, чтобы затем пользователи смогли приближать и отдалять карту. При выборе параметров кэша нужно определить, какие масштабы требуется кэшировать. Если это просто первая проба инструментов кэширования, можно разрешить компьютеру выбрать какие-то масштабы. Однако обычно масштабы заранее подбирают так, чтобы обеспечить качественное отображение карты в каждом из этих масштабов. Следует записать масштабы и использовать их при разработке карт в ArcMap. Когда придет время создавать кэш, нужно указать эти масштабы в настройках инструмента создания кэша.

Есть и другие параметры, которые важно понимать при создании кэша. Дополнительную информацию см. в разделе Редактирование свойств кэширования сервиса в ArcGIS Server Manager.

Кэш хранится в директории кэша вашего сервера. При установке ArcGIS Server директория кэша сервера создается в локальной папке. При добавлении дополнительных ГИС-серверов для поддержки сайта следует настроить общий доступ к директории кэша сервера, для того чтобы она была доступна с других задействованных компьютеров.

Выбираемые масштабы и устанавливаемые значения параметров кэша составляют схему листов. В каждом кэше есть файл схемы листов, который можно импортировать при создании кэшей, чтобы все кэши использовали одни и те же размеры листов и масштабы. Это как правило помогает поднять производительность веб-приложений, содержащих более одного кэшированного сервиса. Дополнительно можно использовать именно ту схему листов, которая используется в ArcGIS Online, Bing Maps и Google Maps. Это позволит производить наложение ваших листов кэша на листы этих картографических онлайн-сервисов.

Можно ли кэшировать все карты?

Кэш карты представляет собой снимок карты в какой-то момент времени. Поэтому кэш прекрасно работает для таких карт, которые нечасто меняются. К таким случаям относятся карты общего назначения, карты данных аэрофотосъемки и топокарты.

Если даже данные изменяются, все равно можно использовать кэширование, периодически обновляя кэш с помощью соответствующих инструментов. Также настраивается график автоматического запуска таких обновлений. Чтобы понять — можно ли кэшировать карту, которая часто меняется, полезно ответить на такие вопросы:

Насколько актуальной должна быть моя карта?

Если необходимо, чтобы данные на карте были «живыми», если недопустима временная задержка, кэширование неприемлемо. Однако если короткая задержка допустима, и за это временное окно кэш можно обновить, кэширование можно применять.

Насколько велик кэш и насколько широко распространены изменения данных?

Эти два вопроса дополняют друг друга. Большой кэш требует больше времени на создание. Практичней обновлять большой кэш только в случае, если есть возможность изолировать область изменений и обновлений. Если кэш невелик, можно позволить себе быструю перестройку всего кэша.

Большой кэш требует больше времени на создание. Практичней обновлять большой кэш только в случае, если есть возможность изолировать область изменений и обновлений. Если кэш невелик, можно позволить себе быструю перестройку всего кэша.

Если обновления нельзя выполнить за приемлемое время, кэширование для такой карты неприменимо.

После решения перечисленных вопросов используйте кэширование в тех случаях, где оно подходит. Повышение производительности, пожалуй, наиболее ценное преимущество, получаемое при создании и обновлении кэша.

Дополнительная информация об обновлении кэша сервера находится в разделе Обновления кэша карты.

Будут ли исходные ГИС-данные доступны после создания пакета листов?

Хотя кэши карты представляют собой изображения данных, вы сможете предоставить доступ к исходным данным картографического сервиса для выполнения задач поиска, идентификации и выполнении запросов. Эти инструменты получают с сервера географические положения объектов и возвращают результаты. Приложение выводит поверх кэшированного изображения результаты в формате исходного графического слоя.

Приложение выводит поверх кэшированного изображения результаты в формате исходного графического слоя.

Как начать кэширование?

Для начала кэширования необходимо опубликовать картографический сервис или сервис изображений. В процессе публикации выполняется настройка свойств в диалоговом окне Редактор сервисов. Здесь можно определить масштабы и экстент кэша. Выполните действия, описанные в разделе Публикация сервиса в ArcGIS Desktop, чтобы узнать, как открыть Редактор сервисов.

Вы можете создать листы при публикации сервиса (что подходит для небольшого кэша) или сформировать кэш самостоятельно после публикации (подходит для большого кэша, когда вы хотите географически ограничить кэш, формируемый для больших масштабов). Если вы создаете кэш самостоятельно, используйте инструмент геообработки Управление листами кэша картографического сервиса из набора инструментов Серверные инструменты.

Компоненты программного обеспечения, необходимые для создания и поддержки кэша карт

Ниже приведен обзор компонентов программного обеспечения, о которых нужно знать при создании и управлении кэшами карт.

Закладка Кэширование

На закладке Кэширование в диалоговом окне Редактор сервиса можно указать, что сервис должен использовать кэш, а затем сконфигурировать необходимые настройки, например, схему листов. Во вложенной закладке Дополнительные настройки можно выбрать дополнительные опции, например, формат изображения и необходимость конфигурирования кэширования по запросу.

Эта закладка доступна в окне Каталог в ArcMap при публикации сервиса или при отображении свойств сервиса.

Рекомендации по использованию закладки Кэширование см. в разделе Доступные свойства кэша карты и изображений.

Инструмент Создать схему листов кэша картографического сервиса

Инструмент Создать схему листов кэша картографического сервиса позволяет создавать схему листов для карты, которая включает масштабы для кэширования, систему координат кэша и другие крайне важные свойства. В итоге инструмент создает файл схемы листов в формате XML. При создании кэша можно указать файл схемы листов, чтобы загрузить эти свойства.

Рекомендуется создавать схему листов с помощью этого инструмента и использовать ее для множества кэшей внутри организации.

Инструмент Управление листами кэша картографического сервера

Средство Управление листами кэша картографического сервера позволяет создавать, изменять и удалять листы в существующем кэше. Открыть этот инструмент можно, щелкнув правой кнопкой мыши на дереве каталога и выбрав Управление кэшем > Управление листами.

Так как Управление листами кэша картографического сервера является инструментом геообработки, его можно использовать в скрипте подобно любому другому инструменту для помощи при обновлении кэша на регулярной основе.

Директория кэша

Директория кэша ArcGIS Server – это папка на диске или в облачном хранилище, в которой хранятся листы кэша.

Можно открыть директорию кэша для проверки листов кэша и файла схемы листов conf.xml. Директория кэша также может содержать статус файловой базы геоданных.gdb, который содержит информацию о том, какие листы были построены.

На рисунке ниже показан полистный формат кэша в Windows Explorer, где каждый лист хранится в отдельном файле. В компактном формате кэша используются большие файлы, называемые пакетами, которые хранят несколько листов.

Более подробно о директории кэша сервера см. Доступные свойства кэша карты и изображений.

Отзыв по этому разделу?

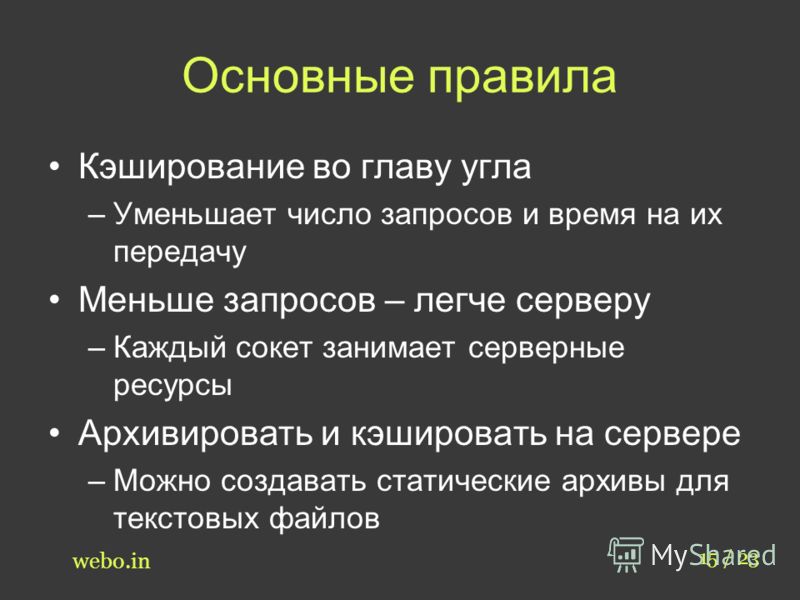

Основные принципы кэширования веб-приложений

Веб-приложения прошли большой путь с самого начала. Традиционный процесс создания веб-приложений проходит через несколько этапов проектирования, разработки и тестирования перед тем, как они будут готовы. Как только ваше приложение будет выпущено, реальные пользователи будут постоянно к нему обращаться. Если ваше приложение станет популярно, оно будет доступно по крайней мере нескольким миллионам пользователей ежедневно. Хотя звучит многообещающе, это повлечет за собой дополнительные расходы.

Помимо цены, некоторое время займет выполнение сложных расчетов и операций чтения и записи. Это значит, что ваш пользователь должен дождаться завершения операции. Если ожидание окажется слишком долгим, это может сказаться на пользовательском опыте.

Это значит, что ваш пользователь должен дождаться завершения операции. Если ожидание окажется слишком долгим, это может сказаться на пользовательском опыте.

Разработчики систем используют несколько стратегий, чтобы устранить эти проблемы. Кэширование — одно из них.

Кэширование в веб-приложениях — что это?

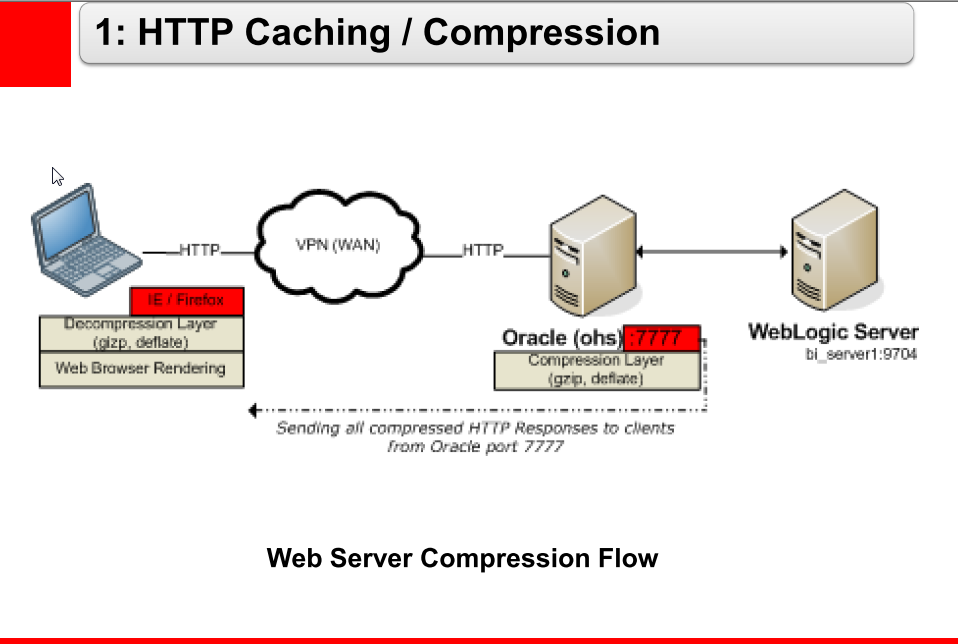

Веб-кэш — это компонент, способный временно хранить HTTP-ответы, которые могут быть использованы для последующих HTTP-запросов при соблюдении определенных условий.

Веб-кэширование — это ключевая дизайнерская особенность HTTP-протокола. Оно предназначено для снижения сетевого трафика во время увеличения предполагаемой ответной реакции в целом. Кэши находятся на каждом этапе перемещения контента — от исходного сервера к браузеру.

Если говорить простым языком, веб-кэширование позволяет повторно использовать HTTP-ответы, которые были сохранены в кэше, с HTTP-запросами аналогичного характера. Давайте рассмотрим простой пример, когда пользователь запрашивает с сервера определенный тип продукта (книги). Можно предположить, что весь этот процесс займет примерно 670 миллисекунд. Если чуть позже в тот же день пользователь выполнит этот же запрос вместо того, чтобы снова повторить те же вычисления и потратить 670 миллисекунд, HTTP –ответ может вернуться к пользователю. Это значительно сократит время отклика. В реальности это может составить менее 50 миллисекунд.

Можно предположить, что весь этот процесс займет примерно 670 миллисекунд. Если чуть позже в тот же день пользователь выполнит этот же запрос вместо того, чтобы снова повторить те же вычисления и потратить 670 миллисекунд, HTTP –ответ может вернуться к пользователю. Это значительно сократит время отклика. В реальности это может составить менее 50 миллисекунд.

Существует несколько преимуществ кэширования с точки зрения потребителя и поставщика.

Снижение затрат на пропускную способность

Как было сказано ранее, содержание может быть кэшировано в различных точках HTTP-запроса от потребителя к серверу. Когда содержание кэшировано ближе к пользователю, запрос пройдет меньшее расстояние, что снизит затраты на пропускную способность.

Улучшенный отклик

Поскольку кэши хранятся ближе к пользователю, необходимость в полном цикле обращения к серверу пропадает. Чем ближе кэш, тем быстрее будет ответ. Это напрямую окажет положительное воздействие на пользовательский опыт.

Повышенная производительность на том же оборудовании

Ввиду того, что кэш обслуживает подобные запросы, ваше серверное оборудование может сосредоточиться на запросах, которым необходима вычислительная мощность. Агрессивное кэширование может еще больше повысить производительность.

Доступность контента даже при сетевых сбояхПри использовании определенных стратегий кэширования в случае сбоя сервера контент будет передан конечным пользователям из кэша за небольшой период времени . Так они смогут выполнить основные задачи без сбоя.

Недостатки кэшированияКэш удаляется во время перезапуска сервера

Каждый раз, когда сервер перезапускается, кэш-данные также удаляются. Это происходит потому, что кэш нестабилен и может исчезнуть при потере источника питания. Однако вы можете придерживаться стратегий, в которых вы регулярно записываете кэш на свой диск, чтобы сохранить кэшированные данные даже во время перезагрузки сервера.

Обслуживание устаревших данных

Одна из основных проблем кэширования — это обслуживание устаревших данных. Устаревшие данные — это необновленные сведения, которые содержат предыдущую версию данных. Если вы кэшировали запрос продуктов, но в то же время, менеджер удалил четыре продукта, пользователи получат списки продуктов, которые не существуют. Такое положение сложно выявить и исправить.

Где можно кэшировать?

Как упоминалось ранее, контент может быть кэширован в различных местах на пути запроса.

Кэш браузера

Веб-браузеры имеют небольшой собственный кэш. Обычно браузер устанавливает политику, которая определяет наиболее важные элементы для кэширования. Это может быть пользовательский контент или контент, который будет ценен для загрузки и, вероятно, будет восстановлен. Чтобы отключить кэширование источника, вы можете установить заголовок ответа, как показано ниже:

Cache-Control: no-store

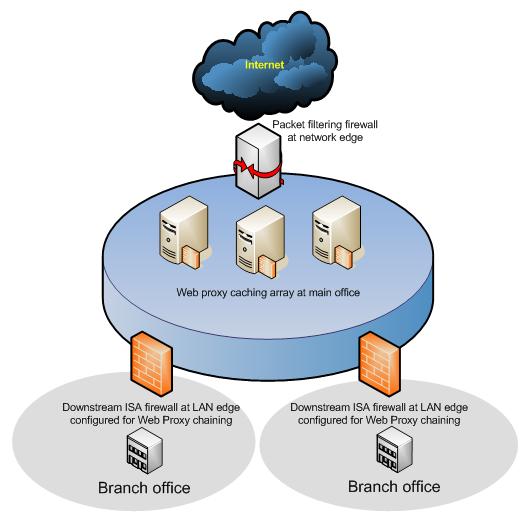

Прокси-серверы для промежуточного кэширования

Любой сервер, расположенный между устройством потребителя и вашей серверной инфраструктурой может кэшировать содержимое по своему желанию. Подобные кэши могут обслуживаться интернет-провайдерами или другими независимыми сторонами.

Подобные кэши могут обслуживаться интернет-провайдерами или другими независимыми сторонами.

Обратный кэш

Вы можете реализовать собственную инфраструктуру кэширования в своих внутренних службах. Для этого вы можете воспользоваться такими платформами, как Redis или Memcache.

Прочитайте более подробно о Cache-Control в этой статье.

Что можно кэшировать?

Все типы контента можно кэшировать, но это не значит, что это всегда необходимо.

Совместимость с кэшем

Ниже изложены типы контента, которые являются наиболее подходящими для кэширования. Они редко меняются и поэтому могут кэшироваться в течение более длительного периода времени:

· Медиаконтент

· Библиотеки JavaScript

· Таблицы стилей

· Изображения, логотипы и иконки

Умеренно совместим с кэшированием

Нижеприведенный контент может быть кэширован, но следует соблюдать особую осторожность, так как этот тип контента может регулярно меняться:

- Часто изменяемые JS и CSS

- HTML-страницы

- Запрос контента с файлами cookie

Никогда не кэшируются

Данные типы контента нельзя кэшировать, иначе у вас могут возникнуть проблемы с безопасностью:

· Конфиденциальный контент, например — банковская информация и т. д.

д.

· Чаще всего пользовательские данные не должны кэшироваться, так как они регулярно обновляются

Зачем нужна стратегия кэширования?

В реальном мире вы не сможете реализовать агрессивное кэширование, так как большую часть времени оно будет возвращать устаревшие данные. Поэтому необходима специальная стратегия кэширования, чтобы сбалансировать использование долгосрочного кэширования и реагирование на требования меняющегося сайта путем реализации подходящих алгоритмов удаления кэша. Поскольку каждая система уникальна и обладает определенным набором требований, необходимо потратить время на создание стратегии кэширования.

Идеальная стратегия кэширования состоит в том, чтобы идти по тонкой грани, которая способствует агрессивному кэшированию, когда это возможно, оставляя отверстия для аннулирования записей в будущем при внесении изменений.

Цель данной статьи — ознакомить вас с базовыми знаниями кэширования для веб-приложений. Мы пропустили такие темы, как заголовки управления, инфраструктура кэширования, руководство по разработке кэш-стратегии и т. д., так как они слишком сложны для этого введения.

д., так как они слишком сложны для этого введения.

Читайте также:

- Создаем собственный блог с помощью Next.js и Strapi

- Создаем приложение React с нуля в 2021 году

- Понятие о горячей замене модулей в Webpack

Читайте нас в Telegram, VK и Яндекс.Дзен

Перевод статьи Mahdhi Rezvi: Fundamentals of Caching Web Applications

Читайте также

Зачем использовать кэширование сайта и как включить его самостоятельно

21133 1

| How-to | – Читать 7 минут |

Прочитать позже

ЧЕК-ЛИСТ: ТЕХНИЧЕСКАЯ ЧАСТЬ — СЕРВЕР

Инструкцию одобрил

Tech Head of SEO в TRINET.Group

Рамазан Миндубаев

Чтобы оптимизировать работу сервера и ускорить сайт, стоит использовать кэширование файлов. Это не только ускорит отображение контента, но и обеспечит бесперебойную работу сайта, поможет удержать пользователей.

Скорость работы сайта — один из основных признаков его успешной работы. Медленная загрузка страниц мешает пользователю получить то, зачем он пришел, и увеличивает показатель отказов. Также этот показатель влияет на положение сайта в поисковой выдаче, его посещаемость и конверсию.

Медленная загрузка страниц мешает пользователю получить то, зачем он пришел, и увеличивает показатель отказов. Также этот показатель влияет на положение сайта в поисковой выдаче, его посещаемость и конверсию.

Что такое кэширование

Когда пользователь заходит на сайт или открывает страницу, компьютер, смартфон или другое устройство отправляет запрос на сервер. Этот запрос обрабатывается, возвращается обратно и браузер отображает страницу на экране. Каждый раз, когда устройство пользователя отправляет запрос, серверу приходится по новой обрабатывать эти данные, чтобы передать все элементы.

Если сервер не справляется с обработкой большого количества данных, файлы могут долго прогружаться, могут возникать 5ХХ ошибки сервера. После чего пользователь просто закрывает страницу, а мы теряем потенциального посетителя или клиента.

Кроме этого, на скорость прогрузки страниц влияет мощность самого устройства и скорости интернет соединения. Производительности некоторых старых компьютеров и мобильных телефонов бывает недостаточно, чтобы быстро загружать контент. Также многое зависит от скорости и качества интернет-соединения.

Производительности некоторых старых компьютеров и мобильных телефонов бывает недостаточно, чтобы быстро загружать контент. Также многое зависит от скорости и качества интернет-соединения.

Кэширование — это процесс запоминания браузером данных, которые были переданы на сервер для обработки и использованы в дальнейшем при прогрузки страницы.

Некоторые элементы сайта имеют одинаковую структуру, например, кнопка «Заказать» или меню навигации. Они могут появляться на нескольких страницах сайта.

С помощью кэширования браузер один раз загружает их, сохраняет в кэш. Каждый последующий раз серверу не придется заново обрабатывать одни и те же данные и отправлять пользователю. Браузер уже «запомнил» нужные элементы, и будет отображать их практически сразу, без использования дополнительного трафика.

Виды кэширования

Кэш сайта может создаваться как со стороны пользователя, так и на самом сервере.

Кэширование в браузере. Устройство пользователя создает и сохраняет копию различных элементов сайта. Это могут быть: скрипты, текст, изображения и т.д. При открытии страницы кэш браузера помогает загрузить все это в разы быстрее.

Устройство пользователя создает и сохраняет копию различных элементов сайта. Это могут быть: скрипты, текст, изображения и т.д. При открытии страницы кэш браузера помогает загрузить все это в разы быстрее.

Кэширование на сервере. Все данные хранятся на сервере. Он сохраняет результаты запросов, что помогает избежать повторной обработки одной и той же информации от пользователя.

Что делать с динамическими элементами страниц

Естественно, сайт периодически обновляется. Может меняться его содержание, изображения и т.п. Кэширование лучше всего подходит для статичных элементов сайта.

Если элемент страницы был кэширован, а потом изменен, то в лучшем случае браузер загрузит неактуальную версию страницы, которая будет работать некорректно. В худшем — пользователь увидит на экране ошибку.

Ему нужно будет очистить кэш браузера, чтобы сервер заново передал уже обновленные данные. Естественно большинство пользователей не умеет этого делать.

Есть сайты, которые обновляются и дополняются новой информацией регулярно. В таком случае и владельцу, и пользователю придется постоянно чистить кэш сайта. Чтобы этого избежать, можно прописать в настройках отдельные элементы для кэширования или, наоборот, исключить ненужные.

Как включить кэширование сайта

Существует множество способов включить и настроить кэширование страниц сайта.

Мы рассмотрим наиболее быстрый и простой из них — кэширование данных с помощью файла .htaccess (используется в случае если сервер работает на Apache). В нем можно прописывать нужный срок кэширования, выбрать отдельные элементы или просто отключить его. Также в нем можно прописать не только кэширование, но и другие функции сайта.

В .htaccess кэширование проще всего прописать в редакторе Notepad++ или в любом другом аналоге. Это поможет избежать ошибок и проблем с кодировкой.

Находим файл .htaccess в корневом каталоге на хостинге. Открываем его с помощью Notepad++.

Открываем его с помощью Notepad++.

Если его нет, то нужно создать его вручную. Для этого открываем программу и прописываем следующие строки:

<IfModule mod_expires.c> ExpiresActive On ExpiresByType application/javascript "access plus 5 days" ExpiresByType text/javascript "access plus 5 days" ExpiresByType text/css "access plus 5 days" ExpiresByType image/gif "access plus 5 days" ExpiresByType image/jpeg "access plus 5 days" ExpiresByType image/png "access plus 5 days" </IfModule>

В Notepad++ код должен выглядеть примерно так:

В нашем случае срок кэширования составляет 5 дней («access plus 5 days»). Вы можете прописать там любое другое число, а вместо дней указать секунды, минуты, часы, недели, месяцы и т.д. Продолжительность следует выбирать в зависимости от интенсивности обновления сайта, особенностей ниши и целей кэширования.

Можно указывать абсолютный срок (кэширование зависит от прошедшего времени) или относительный (кэширование зависит от даты последнего захода пользователя).

Это работает как для всех, так и для отдельно взятых файлов. Также вы можете добавлять новые или убирать ненужные элементы.

Сохраняем файл. Можно сделать это на компьютере, а потом перенести в корневую папку сайта, или сразу сохранить в каталог. Главное — правильно назвать файл (.htaccess — с точкой впереди). Рекомендуем обязательно сохранить резервную копию своего исходного файла.

Если создаете код без использования программы, то просто перенесите текстовый документ в корневую папку.

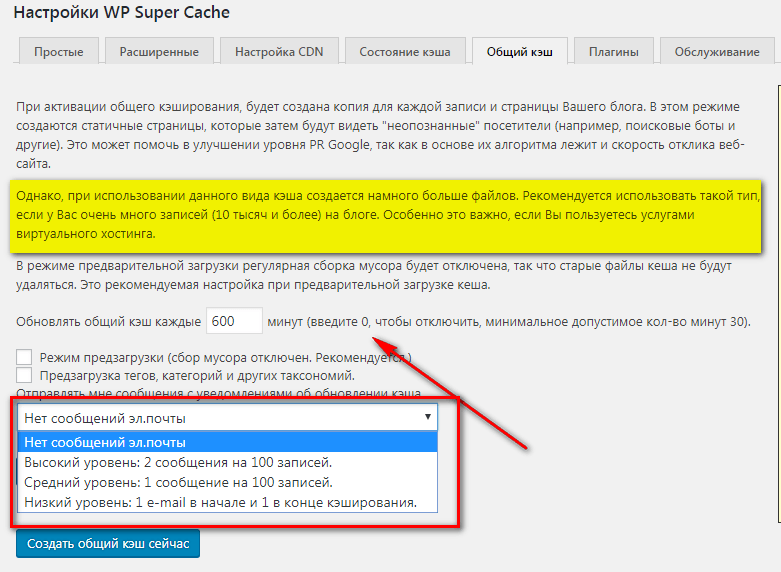

В различных CMS — например, WordPress, — кэширование можно включить с помощью специальных плагинов. Аналогичные решения есть у всех популярных движков.

Заключение

Владельцы сайтов инвестируют большой объем денег в продвижение своего ресурса в ТОП выдачи, вкладывают массу средств в ускорение его работы и совершенствование технической базы сервера.

Кэширование сайта является одним из наиболее эффективных способов ускорения прогрузки страниц. Настроить серверное кэширование или браузерное можно абсолютно бесплатно самостоятельно. На это требуется не так много времени, как кажется.

Настроить серверное кэширование или браузерное можно абсолютно бесплатно самостоятельно. На это требуется не так много времени, как кажется.

» title = «Как включить и настроить кэширование сайта 16261788203376» />

«Список задач» — готовый to-do лист, который поможет вести учет

о выполнении работ по конкретному проекту. Инструмент содержит готовые шаблоны с обширным списком параметров по развитию проекта, к которым также можно добавлять собственные пункты.

| Начать работу со «Списком задач» |

Сэкономьте время на изучении Serpstat

Хотите получить персональную демонстрацию сервиса, тестовый период или эффективные кейсы использования Serpstat?

Оставьте заявку и мы свяжемся с вами 😉

Оцените статью по 5-бальной шкале

4.03 из 5 на основе 29 оценок

Нашли ошибку? Выделите её и нажмите Ctrl + Enter, чтобы сообщить нам.

Рекомендуемые статьи

How-to

Denys Kondak

Как настроить отслеживание звонков

How-to

Анастасия Сотула

Как установить онлайн-консультанта на сайт

How-to

Denys Kondak

Как проанализировать распределение трафика по каналам

Кейсы, лайфхаки, исследования и полезные статьи

Не успеваешь следить за новостями? Не беда! Наш любимый редактор подберет материалы, которые точно помогут в работе. Только полезные статьи, реальные кейсы и новости Serpstat раз в неделю. Присоединяйся к уютному комьюнити 🙂

Только полезные статьи, реальные кейсы и новости Serpstat раз в неделю. Присоединяйся к уютному комьюнити 🙂

Нажимая кнопку, ты соглашаешься с нашей политикой конфиденциальности.

Поделитесь статьей с вашими друзьями

Вы уверены?

Спасибо, мы сохранили ваши новые настройки рассылок.

Сообщить об ошибке

Отменить

Решения AWS для кэширования

Узнайте об Amazon ElastiCache, Amazon CloudFront и Amazon Route 53

Amazon ElastiCache — это веб-служба, упрощающая развертывание, эксплуатацию и масштабирование хранилища данных в памяти и кэширования в облаке. Служба повышает производительность веб-приложений, позволяя извлекать информацию из быстрых управляемых хранилищ данных в памяти вместо того, чтобы полностью полагаться на более медленные базы данных на дисках. Amazon ElastiCache поддерживает два ядра памяти с открытым исходным кодом:

- Redis — быстрое хранилище данных и кеш в памяти с открытым исходным кодом.

Amazon ElastiCache для Redis — это совместимый с Redis сервис в памяти, который обеспечивает простоту использования и мощность Redis, а также доступность, надежность и производительность, подходящие для самых ресурсоемких приложений. Доступны кластеры с одним узлом и до 15 сегментов, что обеспечивает масштабируемость до 3,55 ТиБ данных в памяти. ElastiCache для Redis полностью управляем, масштабируем и безопасен, что делает его идеальным кандидатом для высокопроизводительных сценариев использования, таких как Интернет, мобильные приложения, игры, рекламные технологии и Интернет вещей.

Amazon ElastiCache для Redis — это совместимый с Redis сервис в памяти, который обеспечивает простоту использования и мощность Redis, а также доступность, надежность и производительность, подходящие для самых ресурсоемких приложений. Доступны кластеры с одним узлом и до 15 сегментов, что обеспечивает масштабируемость до 3,55 ТиБ данных в памяти. ElastiCache для Redis полностью управляем, масштабируем и безопасен, что делает его идеальным кандидатом для высокопроизводительных сценариев использования, таких как Интернет, мобильные приложения, игры, рекламные технологии и Интернет вещей. - Memcached — широко распространенная система кэширования объектов памяти. Протокол ElastiCache совместим с Memcached, поэтому популярные инструменты, которые вы используете сегодня с существующими средами Memcached, будут беспрепятственно работать с сервисом.

Amazon ElastiCache автоматически обнаруживает и заменяет отказавшие узлы, сокращая накладные расходы, связанные с самоуправляемыми инфраструктурами, и предоставляет отказоустойчивую систему, снижающую риск перегрузки баз данных, что замедляет загрузку веб-сайтов и приложений. Благодаря интеграции с Amazon CloudWatch Amazon ElastiCache обеспечивает улучшенную видимость ключевых показателей производительности, связанных с вашими узлами Redis или Memcached.

Благодаря интеграции с Amazon CloudWatch Amazon ElastiCache обеспечивает улучшенную видимость ключевых показателей производительности, связанных с вашими узлами Redis или Memcached.

Используя Amazon ElastiCache, вы можете за считанные минуты добавить уровень памяти в свою инфраструктуру с помощью Консоли управления AWS.

Back to Caching Home

Amazon DynamoDB Accelerator (DAX) — это полностью управляемый высокодоступный кэш в памяти для DynamoDB, обеспечивающий 10-кратное повышение производительности — с миллисекунд до микросекунд — даже при обработке миллионов запросов в секунду. . DAX выполняет всю тяжелую работу, необходимую для добавления ускорения в памяти к вашим таблицам DynamoDB, не требуя от разработчиков управления аннулированием кэша, заполнением данных или управлением кластером. Теперь вы можете сосредоточиться на создании отличных приложений для своих клиентов, не беспокоясь о производительности в масштабе. Вам не нужно изменять логику приложения, поскольку DAX совместим с существующими вызовами API DynamoDB. Вы можете включить DAX всего несколькими щелчками мыши в Консоли управления AWS или с помощью AWS SDK. Как и в случае с DynamoDB, вы платите только за предоставленную мощность.

Вам не нужно изменять логику приложения, поскольку DAX совместим с существующими вызовами API DynamoDB. Вы можете включить DAX всего несколькими щелчками мыши в Консоли управления AWS или с помощью AWS SDK. Как и в случае с DynamoDB, вы платите только за предоставленную мощность.

Amazon CloudFront — это служба глобальной сети доставки контента (CDN), которая ускоряет доставку ваших веб-сайтов, API-интерфейсов, видеоконтента или других веб-ресурсов. Он интегрируется с другими продуктами Amazon Web Services, чтобы дать разработчикам и предприятиям простой способ ускорить предоставление контента конечным пользователям без каких-либо минимальных обязательств по использованию.

Amazon CloudFront можно использовать для доставки всего веб-сайта, включая динамическое, статическое, потоковое и интерактивное содержимое, с использованием глобальной сети периферийных местоположений. Запросы на ваш контент автоматически перенаправляются в ближайшее периферийное местоположение, поэтому контент доставляется с максимально возможной производительностью. Amazon CloudFront оптимизирован для работы с другими веб-сервисами Amazon, такими как Amazon Simple Storage Service (Amazon S3), Amazon Elastic Compute Cloud (Amazon EC2), Amazon Elastic Load Balancing и Amazon Route 53. Исходный сервер AWS, на котором хранятся исходные, окончательные версии ваших файлов. Как и в случае с другими продуктами Amazon Web Services, для использования Amazon CloudFront не существует долгосрочных контрактов или обязательств по минимальному ежемесячному использованию — вы платите только за столько контента, сколько фактически доставляете через службу доставки контента.

Запросы на ваш контент автоматически перенаправляются в ближайшее периферийное местоположение, поэтому контент доставляется с максимально возможной производительностью. Amazon CloudFront оптимизирован для работы с другими веб-сервисами Amazon, такими как Amazon Simple Storage Service (Amazon S3), Amazon Elastic Compute Cloud (Amazon EC2), Amazon Elastic Load Balancing и Amazon Route 53. Исходный сервер AWS, на котором хранятся исходные, окончательные версии ваших файлов. Как и в случае с другими продуктами Amazon Web Services, для использования Amazon CloudFront не существует долгосрочных контрактов или обязательств по минимальному ежемесячному использованию — вы платите только за столько контента, сколько фактически доставляете через службу доставки контента.

AWS Greengrass — это программное обеспечение, позволяющее безопасно выполнять локальные вычисления, обмен сообщениями и кэширование данных для подключенных устройств. С помощью AWS Greengrass подключенные устройства могут запускать функции AWS Lambda, синхронизировать данные устройств и безопасно обмениваться данными с другими устройствами, даже если они не подключены к Интернету. Используя AWS Lambda, Greengrass гарантирует, что ваши устройства IoT могут быстро реагировать на локальные события, работать с прерывистыми соединениями и минимизировать затраты на передачу данных IoT в облако.

С помощью AWS Greengrass подключенные устройства могут запускать функции AWS Lambda, синхронизировать данные устройств и безопасно обмениваться данными с другими устройствами, даже если они не подключены к Интернету. Используя AWS Lambda, Greengrass гарантирует, что ваши устройства IoT могут быстро реагировать на локальные события, работать с прерывистыми соединениями и минимизировать затраты на передачу данных IoT в облако.

AWS Greengrass легко расширяет возможности AWS для устройств, чтобы они могли локально обрабатывать данные, которые они генерируют, при этом используя облако для управления, аналитики и надежного хранения. С Greengrass вы можете использовать знакомые языки и модели программирования для создания и тестирования программного обеспечения вашего устройства в облаке, а затем развертывать его на своих устройствах. AWS Greengrass можно запрограммировать на фильтрацию данных устройств и передачу обратно в облако только необходимой информации. AWS Greengrass выполняет аутентификацию и шифрует данные устройств во всех точках подключения, используя возможности безопасности и управления доступом AWS IoT. Таким образом, данные никогда не обмениваются между устройствами, когда они взаимодействуют друг с другом и с облаком без подтвержденной идентификации.

Таким образом, данные никогда не обмениваются между устройствами, когда они взаимодействуют друг с другом и с облаком без подтвержденной идентификации.

Amazon Route 53 — это высокодоступный и масштабируемый веб-сервис облачной системы доменных имен (DNS). Он разработан, чтобы предоставить разработчикам и предприятиям чрезвычайно надежный и экономичный способ маршрутизации конечных пользователей к Интернет-приложениям путем преобразования таких имен, как www.example.com, в числовые IP-адреса, такие как 192.0.2.1, которые компьютеры используют для соединения друг с другом. Amazon Route 53 также полностью совместим с IPv6.

Amazon Route 53 эффективно связывает запросы пользователей с инфраструктурой, работающей в AWS, например с инстансами Amazon EC2, балансировщиками нагрузки Elastic Load Balancing или корзинами Amazon S3, а также может использоваться для маршрутизации пользователей к инфраструктуре за пределами AWS. Вы можете использовать Amazon Route 53 для настройки проверки работоспособности DNS для маршрутизации трафика на работоспособные конечные точки или для независимого мониторинга работоспособности вашего приложения и его конечных точек. Amazon Route 53 Traffic Flow позволяет легко управлять трафиком в глобальном масштабе с помощью различных типов маршрутизации, включая маршрутизацию на основе задержки, географическую DNS и циклический взвешенный алгоритм. отказоустойчивые архитектуры с малой задержкой. Используя простой визуальный редактор Amazon Route 53 Traffic Flow, вы можете легко управлять тем, как ваши конечные пользователи направляются к конечным точкам вашего приложения — будь то в одном регионе AWS или распределены по всему миру. Amazon Route 53 также предлагает регистрацию доменных имен — вы можете приобретать доменные имена, такие как example.com, и управлять ими, а Amazon Route 53 автоматически настроит параметры DNS для ваших доменов.

Вы можете использовать Amazon Route 53 для настройки проверки работоспособности DNS для маршрутизации трафика на работоспособные конечные точки или для независимого мониторинга работоспособности вашего приложения и его конечных точек. Amazon Route 53 Traffic Flow позволяет легко управлять трафиком в глобальном масштабе с помощью различных типов маршрутизации, включая маршрутизацию на основе задержки, географическую DNS и циклический взвешенный алгоритм. отказоустойчивые архитектуры с малой задержкой. Используя простой визуальный редактор Amazon Route 53 Traffic Flow, вы можете легко управлять тем, как ваши конечные пользователи направляются к конечным точкам вашего приложения — будь то в одном регионе AWS или распределены по всему миру. Amazon Route 53 также предлагает регистрацию доменных имен — вы можете приобретать доменные имена, такие как example.com, и управлять ими, а Amazon Route 53 автоматически настроит параметры DNS для ваших доменов.

Начать кэширование в облаке легко с помощью полностью управляемого сервиса, такого как Amazon ElastiCache. Это устраняет сложность настройки, управления и администрирования вашего кэша и позволяет вам сосредоточиться на том, что приносит пользу вашей организации. Зарегистрируйтесь сегодня для Amazon ElastiCache.

Это устраняет сложность настройки, управления и администрирования вашего кэша и позволяет вам сосредоточиться на том, что приносит пользу вашей организации. Зарегистрируйтесь сегодня для Amazon ElastiCache.

Поддержка AWS для Internet Explorer заканчивается 31.07.2022. Поддерживаемые браузеры: Chrome, Firefox, Edge и Safari. Узнать больше »

Что такое кэширование и как оно работает

«Что такое кэширование данных?» и «как работает кэш?» являются общими вопросами в вычислительной технике. Кэширование данных — это процесс, который сохраняет несколько копий данных или файлов во временном хранилище — или кэше — для более быстрого доступа к ним. Он сохраняет данные для программных приложений, серверов и веб-браузеров, что гарантирует, что пользователям не нужно загружать информацию каждый раз, когда они обращаются к веб-сайту или приложению, чтобы ускорить загрузку сайта.

Кэшированные данные обычно включают мультимедиа, такие как изображения, файлы и сценарии, которые автоматически сохраняются на устройстве при первом открытии пользователем приложения или посещении веб-сайта. Это используется для быстрой загрузки информации о приложении или веб-сайте каждый раз, когда пользователь впоследствии открывает или посещает его. Кэширование — хорошее решение для узкого места фон Неймана, которое ищет способы лучше обслуживать более быстрый доступ к памяти.

Это используется для быстрой загрузки информации о приложении или веб-сайте каждый раз, когда пользователь впоследствии открывает или посещает его. Кэширование — хорошее решение для узкого места фон Неймана, которое ищет способы лучше обслуживать более быстрый доступ к памяти.

Система доменных имен (DNS) кэширует записи DNS для более быстрого поиска, сети доставки контента (CDN) используют кэширование для уменьшения задержки, а веб-браузеры кэшируют запрошенные файлы языка гипертекстовой разметки (HTML), изображения и JavaScript для загрузки веб-сайтов Быстрее. Например, когда пользователь впервые посещает веб-сайт, приложение или браузер сохраняет информацию, чтобы помочь ему получить доступ к ней быстрее и эффективнее.

Кэшированные данные работают, сохраняя данные для повторного доступа в памяти устройства. Данные хранятся высоко в памяти компьютера чуть ниже центрального процессора (ЦП). Он хранится в нескольких слоях: первичный уровень кэша встроен в микросхему микропроцессора устройства, а затем еще два вторичных уровня, которые питают первичный уровень. Эти данные хранятся до тех пор, пока не наступит время жизни (TTL), которое указывает, как долго содержимое должно быть кэшировано, истечет срок действия или заполнится кеш диска или жесткого диска устройства.

Эти данные хранятся до тех пор, пока не наступит время жизни (TTL), которое указывает, как долго содержимое должно быть кэшировано, истечет срок действия или заполнится кеш диска или жесткого диска устройства.

Данные обычно кэшируются двумя способами: через браузер или кэширование в памяти или через CDN.

- Браузер и кэширование в памяти: кэши памяти хранят данные локально на компьютере, на котором запущено приложение или браузер. Когда браузер активен, извлекаемые им ресурсы сохраняются в его оперативной памяти (ОЗУ) или на жестком диске. В следующий раз, когда ресурсы потребуются для загрузки веб-страницы, браузер извлечет их из кеша, а не с удаленного сервера, что ускорит извлечение ресурсов и загрузку страницы.

- CDN: кэширование — это одна из задач CDN, которая хранит данные в географически распределенных местах, чтобы сократить время загрузки, обрабатывать большие объемы трафика и защищать от кибератак. Запросы браузера перенаправляются в локальную CDN, что сокращает расстояние, которое проходят данные ответа, и ускоряет передачу ресурсов.

Когда пользователь посещает новый веб-сайт, его браузеру необходимо загрузить данные для загрузки и отображения содержимого на странице. Чтобы ускорить этот процесс для будущих посещений пользователя, браузеры кэшируют содержимое страницы и сохраняют его копию на жестком диске устройства. В результате, когда пользователь в следующий раз зайдет на этот сайт, контент уже будет сохранен на его устройстве, и страница будет загружаться быстрее.

Кэш-память обеспечивает чрезвычайно низкую задержку, что означает быстрый доступ к ней. В результате он ускоряет загрузку во второй раз, когда пользователь обращается к приложению или веб-сайту. Однако кеш не может хранить много памяти, поэтому он хранит только небольшие файлы, такие как изображения и веб-текст.

Данные могут быть кэшированы разными способами, но обычно владелец веб-сайта устанавливает «заголовок», который сообщает устройству, что данные могут кэшироваться и как долго. Это указывает браузеру пользователя, какую информацию загружать и где хранить временные файлы. Затем пользователь может создавать политики и предпочтения в отношении того, какие данные они кэшируют, и даже очищать весь кэш, чтобы уменьшить объем данных, хранящихся на его устройстве.

Затем пользователь может создавать политики и предпочтения в отношении того, какие данные они кэшируют, и даже очищать весь кэш, чтобы уменьшить объем данных, хранящихся на его устройстве.

Кэширование данных важно, поскольку оно помогает повысить производительность приложений и эффективность. Он хранит данные локально, что означает, что браузеры и веб-сайты будут загружаться быстрее, поскольку ранее были загружены элементы доступа, такие как изображения домашней страницы.

Интернет-пользователи, как правило, покидают веб-сайт, который загружается слишком медленно, что делает кэширование жизненно важным для владельцев веб-сайтов, чтобы улучшить взаимодействие с пользователем и побудить людей использовать их сайт. Это также важно для онлайн-инструментов, таких как Google Docs, которые позволяют пользователям получать доступ к своим документам и сохранять их в Интернете.

Однако у кэширования данных есть и недостатки. Кэширование может повысить производительность браузера, но оно также подвергает конфиденциальную или конфиденциальную информацию пользователей риску раскрытия киберпреступниками. Кэширование данных может привести к уязвимости данных аутентификации, истории посещенных страниц или токенов сеанса, особенно если браузер остается открытым или если к нему имеет доступ другой пользователь.

Кэширование данных может привести к уязвимости данных аутентификации, истории посещенных страниц или токенов сеанса, особенно если браузер остается открытым или если к нему имеет доступ другой пользователь.

Кэш можно очистить разными способами в зависимости от используемого устройства. Кэшированные данные можно очистить во всех веб-браузерах с помощью следующих процессов:

- Apple Safari: откройте Safari и выберите параметр «История», затем «Очистить историю», чтобы удалить все данные, сохраненные в браузере. Затем он загрузит раскрывающееся меню, в котором можно выбрать данные за последний час, последний день, последние два дня или всю историю пользователя, что удалит всю его историю просмотров, все их файлы cookie и весь кеш браузера. . Пользователи Safari также могут выбирать отдельные сайты в своей истории, щелкать их правой кнопкой мыши и удалять.

- Google Chrome: откройте Chrome и выберите значок настроек, представленный тремя вертикальными точками в правом верхнем углу браузера.

Выберите опцию «Дополнительные инструменты», затем «Очистить данные браузера». На следующей странице установите флажки для кэшированных изображений и файлов, файлов cookie и данных сайта и плагинов. Затем используйте параметры, чтобы выбрать, сколько данных нужно удалить, начиная с прошлого дня и заканчивая «началом времени». Сделав это, выберите «Очистить данные просмотра». Этот процесс работает для Chrome на компьютерах и на устройствах Android и iOS.

Выберите опцию «Дополнительные инструменты», затем «Очистить данные браузера». На следующей странице установите флажки для кэшированных изображений и файлов, файлов cookie и данных сайта и плагинов. Затем используйте параметры, чтобы выбрать, сколько данных нужно удалить, начиная с прошлого дня и заканчивая «началом времени». Сделав это, выберите «Очистить данные просмотра». Этот процесс работает для Chrome на компьютерах и на устройствах Android и iOS. - Internet Explorer: Откройте Explorer и выберите «Инструменты» на значке шестеренки, затем выберите «Безопасность», а затем «Удалить историю просмотров». Выберите данные, которые необходимо очистить, установив все соответствующие флажки, включая файлы cookie и временные файлы Интернета, а затем выберите «Удалить». Меню истории просмотров также можно открыть, одновременно удерживая Ctrl, Shift и Delete.

- Mozilla Firefox: откройте Firefox и нажмите кнопку «Библиотека», затем выберите «История», а затем «Очистить недавнюю историю».

Выберите временной диапазон кэшированных данных, которые нужно очистить, затем щелкните стрелку рядом с «Подробности», чтобы выбрать информацию, которая будет очищена. Выберите «Очистить сейчас», чтобы очистить кеш.

Выберите временной диапазон кэшированных данных, которые нужно очистить, затем щелкните стрелку рядом с «Подробности», чтобы выбрать информацию, которая будет очищена. Выберите «Очистить сейчас», чтобы очистить кеш.

Кэшированные данные также можно очистить на мобильных устройствах, удалив данные, хранящиеся в приложениях. Мобильные кэшированные данные можно очистить с помощью следующих процессов:

- Устройства Android: пользователи Android могут очистить кэш на своем устройстве, чтобы освободить место для хранения. Откройте меню «Настройки», затем откройте «Приложения» или «Приложения», найдите приложение, для которого требуется очистить кэш или данные, и выберите «Хранилище». Это покажет объем хранилища, используемого приложением, и предоставит возможность очистить данные.

- Устройства Apple iOS. Пользователи Apple также могут очистить кеш на своем устройстве, чтобы удалить данные, занимающие место на диске. Откройте меню «Настройки», затем «Общие».

В нем перейдите в «Хранилище и использование iCloud», затем откройте «Хранилище» и выберите «Управление хранилищем». Выберите приложение в списке, затем перейдите в «Документы и данные». Если приложение использует более 500 МБ места, переустановите его, чтобы освободить место.

В нем перейдите в «Хранилище и использование iCloud», затем откройте «Хранилище» и выберите «Управление хранилищем». Выберите приложение в списке, затем перейдите в «Документы и данные». Если приложение использует более 500 МБ места, переустановите его, чтобы освободить место.

Стоит ли очищать кэш?

При очистке кэшированных данных удаляется информация, хранящаяся в кэше ЦП. Это может быть полезно, если у пользователя заканчивается память на его устройстве или если у него хранится информация для веб-сайтов, которые он больше не использует.

Очистка кеша также может исправить некорректную загрузку страницы, но замедлить время загрузки страниц ранее посещенных веб-сайтов. Это приводит к загрузке каждого веб-сайта, как если бы пользователь никогда не посещал его раньше, и может удалить сохраненные данные, логины веб-сайта и многое другое, поэтому пользователи должны быть осторожны с тем, что они удаляют, прежде чем приступать к очистке кэшированных данных.

Брандмауэр нового поколения FortiGate (NGFW) может помочь выявлять и блокировать атаки, происходящие в сети. Это может быть полезно для защиты кэшированных данных, хранящихся на устройствах пользователей, путем блокировки доступа злоумышленников.

Решения Fortinet NGFW обновляются по мере развития ландшафта угроз, что гарантирует постоянную защиту предприятий от новейших направлений атак и штаммов вредоносных программ. Он также интегрируется с другими решениями Fortinet, такими как FortiGuard и FortiSandbox, которые защищают предприятия от известных угроз и угроз нулевого дня.

Что такое кеш?

Простое определение кэша — это место временного хранения, в котором хранятся данные, файлы и данные для входа в приложения и веб-сайты в памяти устройства.

Что значит очистить кеш?

Очистка кеша — это процесс удаления пользователем данных и файлов, хранящихся в папке кеша.

Можно ли удалить кеш?

Да, частое удаление кэша может помочь пользователям освободить место на устройстве. Однако пользователи должны быть осторожны с данными, которые они удаляют. Очистка кеша может замедлить загрузку страниц и удалить важные данные и необходимые входы на сайт.

Для чего используется кэширование?

Кэш хранит данные в локальной папке на устройстве. Это может повысить производительность и эффективность приложения или веб-сайта за счет ускорения загрузки при следующем открытии или посещении пользователем приложения или сайта.

Что такое кэширование и как оно работает

За последние несколько лет информационные технологии радикально улучшили любой вид бизнеса. Между тем архитектуры программного обеспечения становятся все более сложными, а число их пользователей растет в геометрической прогрессии. Это представляло собой проблему производительности для любого приложения. Низкая производительность может подорвать стратегические цели любой компании, поэтому крайне важно найти разумные способы ее улучшения. Как следствие, необходимо избегать накладных расходов и сокращать время поиска и обработки данных. Именно здесь в игру вступает кэширование, и поэтому ни один разработчик больше не может его игнорировать.

Низкая производительность может подорвать стратегические цели любой компании, поэтому крайне важно найти разумные способы ее улучшения. Как следствие, необходимо избегать накладных расходов и сокращать время поиска и обработки данных. Именно здесь в игру вступает кэширование, и поэтому ни один разработчик больше не может его игнорировать.

Во-первых, мы углубимся в концепцию кэширования, понимая, почему это важно и связанные с этим возможные риски. Затем мы изучим наиболее важные виды кэширования.

Что такое кэширование

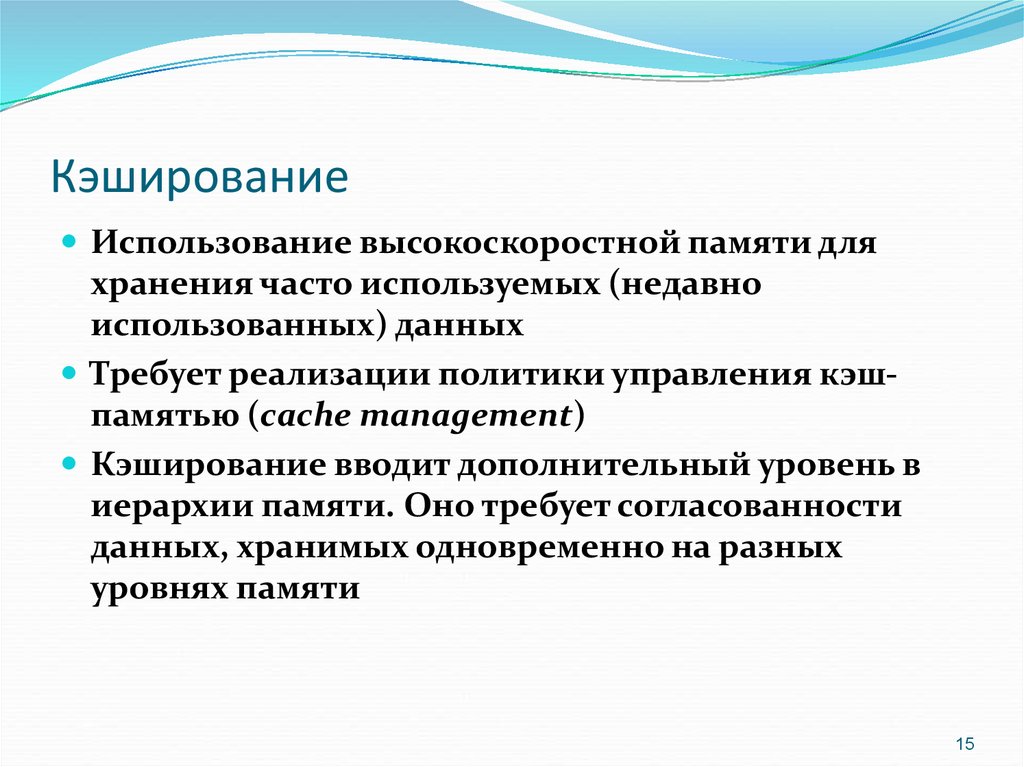

Кэширование — это механизм повышения производительности приложений любого типа. Технически кэширование — это процесс хранения и доступа к данным из кеша. Но подождите, что такое кеш? Кэш — это программный или аппаратный компонент, предназначенный для хранения данных, чтобы будущие запросы на те же данные могли обслуживаться быстрее.

Основная причина появления кэширования заключается в том, что доступ к данным из постоянной памяти занимает значительное время. Таким образом, всякий раз, когда данные извлекаются или обрабатываются, они должны храниться в более эффективной памяти. Мы называем такую память кешем , которую можно рассматривать как высокоскоростной уровень хранения данных, основной целью которого является уменьшение необходимости доступа к более медленным уровням хранения данных. Чтобы быть рентабельными и эффективными, кэш-память должна быть относительно небольшой, особенно по сравнению с традиционной памятью. Вот почему они обычно реализуются с использованием аппаратного обеспечения быстрого доступа, такого как ОЗУ (оперативная память), а также программного компонента.

Таким образом, всякий раз, когда данные извлекаются или обрабатываются, они должны храниться в более эффективной памяти. Мы называем такую память кешем , которую можно рассматривать как высокоскоростной уровень хранения данных, основной целью которого является уменьшение необходимости доступа к более медленным уровням хранения данных. Чтобы быть рентабельными и эффективными, кэш-память должна быть относительно небольшой, особенно по сравнению с традиционной памятью. Вот почему они обычно реализуются с использованием аппаратного обеспечения быстрого доступа, такого как ОЗУ (оперативная память), а также программного компонента.

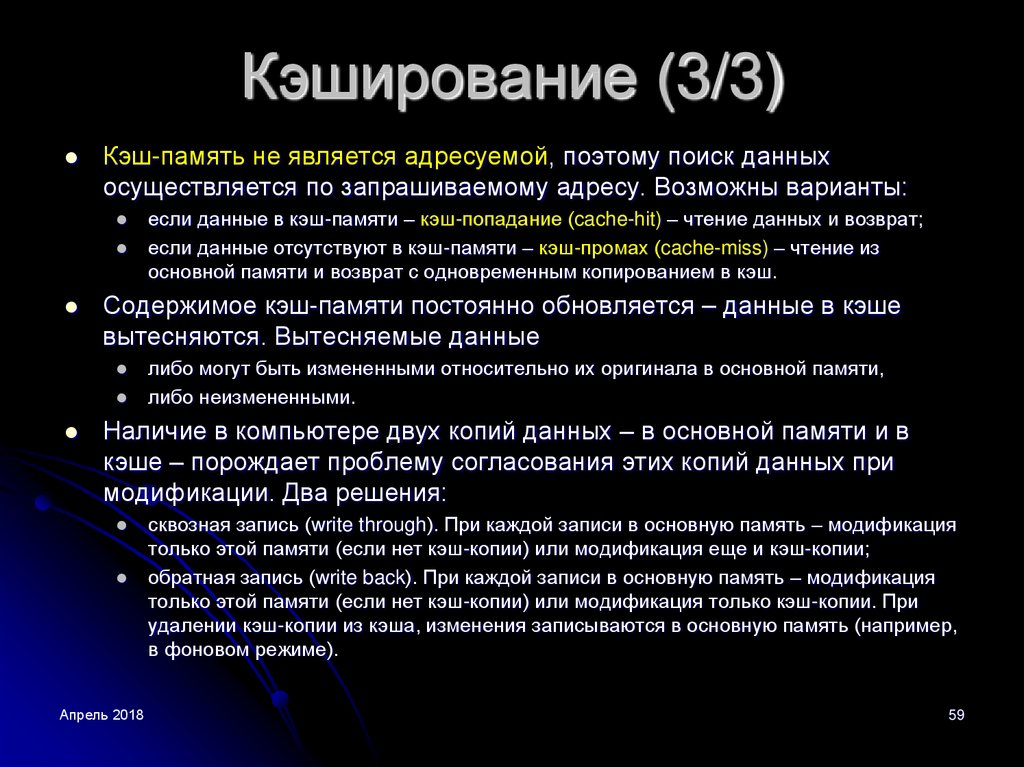

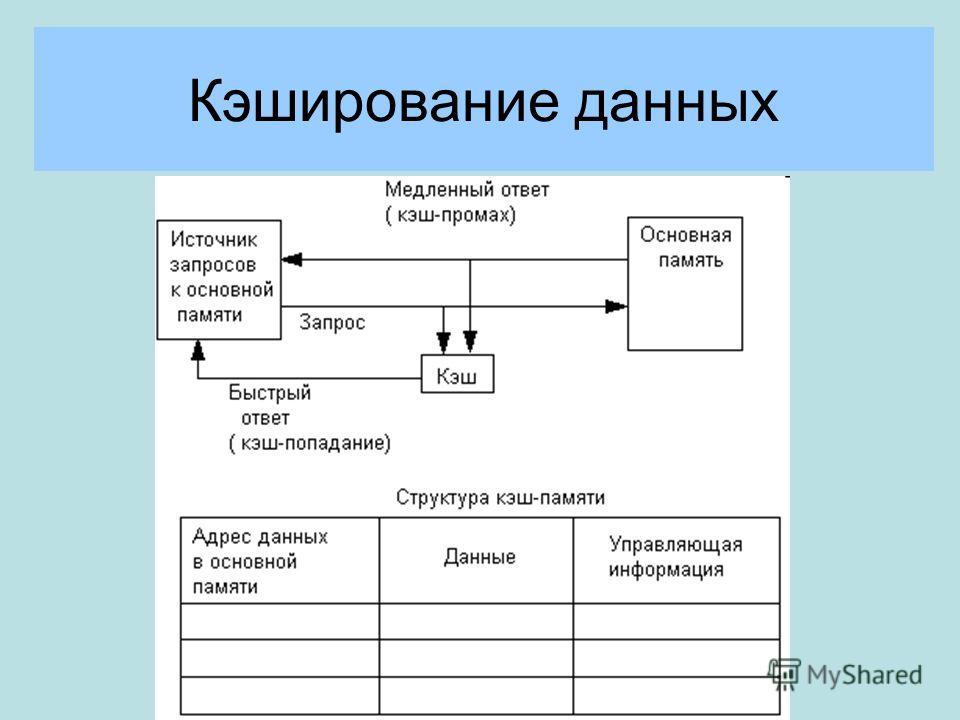

Благодаря кэшам можно реализовать механизм эффективного повторного использования ранее извлеченных или вычисленных данных. Всякий раз, когда поступает новый запрос, запрошенные данные сначала ищутся в кэше. Попадание в кэш происходит, когда запрошенные данные могут быть найдены в кэше. Наоборот, промах кэша происходит, когда это невозможно. Очевидно, предполагается, что чтение требуемых данных из кешей выполняется быстрее, чем повторное вычисление результата или чтение его из исходного хранилища данных. Таким образом, чем больше запросов можно обслужить из кеша, тем быстрее будет работать система.

Очевидно, предполагается, что чтение требуемых данных из кешей выполняется быстрее, чем повторное вычисление результата или чтение его из исходного хранилища данных. Таким образом, чем больше запросов можно обслужить из кеша, тем быстрее будет работать система.

В заключение отметим, что кэширование — довольно простой способ повысить производительность. Это особенно верно по сравнению с оптимизацией алгоритмов, которая обычно является очень сложной и трудоемкой задачей.

Почему кэширование важно

Кэширование чрезвычайно важно, поскольку оно позволяет разработчикам добиться повышения производительности, иногда значительного. Как упоминалось ранее, это жизненно важно.

В частности, ни пользователи, ни разработчики не хотят, чтобы приложения долго обрабатывали запросы. Как разработчики, мы хотели бы развернуть наиболее производительную версию наших приложений. И как пользователи мы готовы ждать всего несколько секунд, а иногда даже миллисекунд. Правда в том, что никто не любит тратить свое время на просмотр загружаемых сообщений.

Кроме того, важность обеспечения высокой производительности настолько важна, что кэширование быстро стало неизбежной концепцией в компьютерных технологиях. Это означает, что его используют все больше и больше сервисов, что делает его практически вездесущим. Как следствие, если мы хотим конкурировать с множеством приложений на рынке, мы должны правильно внедрить системы кэширования. Кроме того, объяснение пользователям, почему наши системы работают медленно, может представлять собой проблему.

Другим важным аспектом кэширования является то, что оно позволяет избежать каждый раз новых запросов или повторной обработки данных. Так что мы можем избежать накладных расходов, таких как сетевые накладные расходы, и уменьшить использование ЦП, особенно если запросы связаны со сложными разработками. Это может продлить срок службы наших машин или серверов. Кроме того, отказ от новых запросов снижает общее количество необходимых запросов, что может снизить стоимость вашей инфраструктуры. На самом деле, при работе с облачными платформами или поставщиками общедоступных API, например, обычно выставляется счет за любое сетевое взаимодействие между их службами. Отличные побочные эффекты, не так ли?

На самом деле, при работе с облачными платформами или поставщиками общедоступных API, например, обычно выставляется счет за любое сетевое взаимодействие между их службами. Отличные побочные эффекты, не так ли?

Проблемы

Кэширование ни в коем случае не является простой практикой, и эта тема неизбежна. Давайте рассмотрим самые коварные из них.

Проблема когерентности