«Как разговаривать с Алисой?» — Яндекс Кью

Популярное

Сообщества

Яндекс браузерГолосовые помощникиПомощник алиса

Анонимный вопрос

·

7,4 K

На Кью задали 4 похожих вопросаОтветить3УточнитьМихаил Савастьянов

4,0 K

IT, Web, игры и масса других интересов · 18 янв 2019

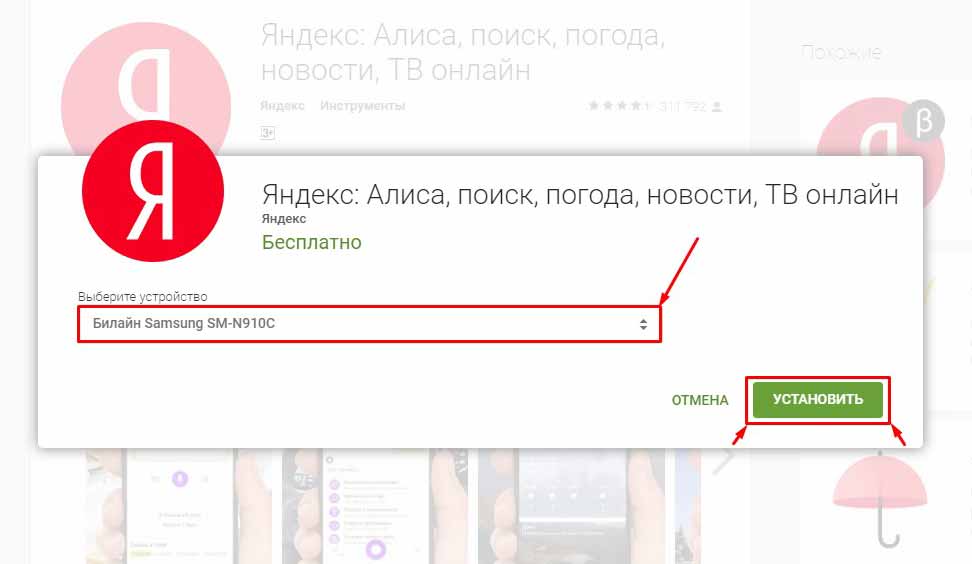

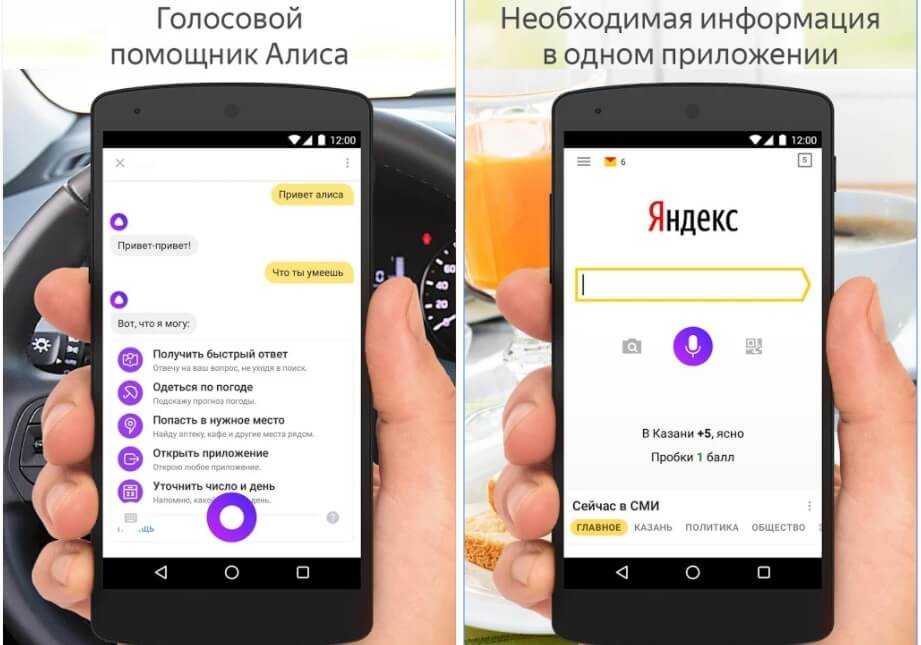

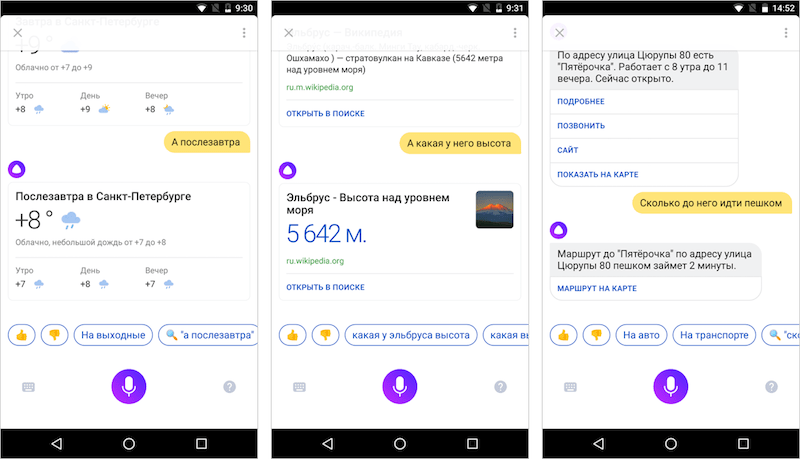

Чтобы начать разговор с Алисой (голосовым помощником Яндекс) нужно запустить приложение и произнести фразу «Привет, Алиса», либо можно нажать кнопку с микрофоном, и задать интересующий вопрос.

В настоящее время такая возможность есть у пользователей Android и iOS в приложении Яндекс, а также у владельцев ПК в Яндекс Браузере и специальной программе Алиса для Windows.

Комментировать ответ…Комментировать…

Вы знаете ответ на этот вопрос?

Поделитесь своим опытом и знаниями

Войти и ответить на вопрос

6 ответов скрыто(Почему?)

Ответы на похожие вопросы

Поговорить с Алисой? — 4 ответа, задан 382Z»>7 декабря 2018lameonor

147

Увлекаюсь музыкой,гитара,игры на ПК, Велосипед,коньки,фантастика и фентези,болею за ФК… · 7 дек 2018

В чем вопрос? если вы уже установили Алису,скажите «Привет Алиса» Она есть в Яндекс браузере.С ней можно поиграть,так и скажите «Алиса давай поиграем»

Комментировать ответ…Комментировать…

Как поговорить с Алисой? — 1 ответ, заданПервый

ah. nabick

22 авг 2020

Здравствуйте. Скачиваете браузер Алиса или Яндекс Алиса. Заходите в то ,что закачали. Нажимаете на значок Алиса ну, а дальше разговариваете с ней.

Комментировать ответ…Комментировать…

Как разговаривать с Алисой? — 1 ответ, заданКирилл Анисимов

География

46

Студент, люблю географию · 13 июл 2021

«Привет, Алиса» — ключевая фраза для того, чтобы включить голосовой помощник от Яндекса.

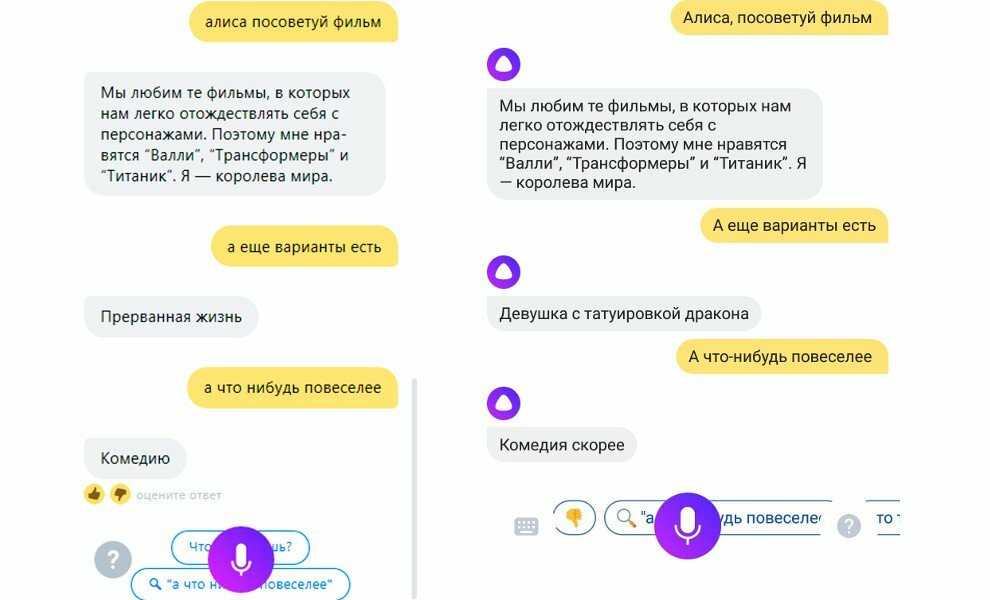

Алиса может включать вам музыку по вкусу, найти нужный фильм или сериал на YouTube или Кинопоиске, рассказать какая погода за окном, поставить таймер на необходимый промежуток времени. Поможет найти интересные места рядом, вызвать такси, поставить будильник, рассказать о пробках в городе, да и в целом с ней можно просто поболтать о чем-то не столь важном.

В целом, Алиса умеет много всего и может стать хорошим собеседником, нужно всего лишь спросить ее об этом 🙂

Комментировать ответ…Комментировать…

Поговорить с Алисой? — 4 ответа, заданМаксим М

4

2 авг 2019

Если информация ещё нужна, то вот ссылка на мою статью:

https://www.maxim-m.ru/article/alisa-skills

В ней я постарался максимально подробно рассказать о том как пользоваться Алисой, а также рассказал как запускать навыки.

Если будет что-то не понятно, то можете писать мне лично.

Всегда буду рад помочь ✌️

Комментировать ответ…Комментировать…

Поговорить с Алисой? — 4 ответа, заданАлиса

66

Алиса Селезнёва https://ya-alisa.ru/ · 4 февр 2019

Вызвать её и поговорить. Сказать «Слушай, Алиса» — она отзовётся и можно разговаривать. Правда, на разных устройствах возможно придётся настроить голосвую активацию Алисы — https://ya-alisa.ru/kak-vklyuchit-alisu-yandex.html

Комментировать ответ…Комментировать…

О чём робот говорит с вашим ребёнком? «Яндекс» научил «Алису» разговаривать с детьми, и это может быть опасно

«Алиса» научилась разговаривать с детьми. Это как?

Люди боятся подпускать детей к технологиям, проблема актуальна не только в России. В США среди обеспеченных семей полный отказ от гаджетов в воспитании ребёнка — распространённое решение. Вальдорфская школа, популярная среди сотрудников Силиконовой долины, учит детей вообще без электронных устройств. Есть и другие частные школы Калифорнии, также работающие по старинке. Там вместо цифровой грамотности и презентаций в PowerPoint дети играют в традиционные игры, много времени уделяют чтению вслух и другим видам речевой деятельности.

В США среди обеспеченных семей полный отказ от гаджетов в воспитании ребёнка — распространённое решение. Вальдорфская школа, популярная среди сотрудников Силиконовой долины, учит детей вообще без электронных устройств. Есть и другие частные школы Калифорнии, также работающие по старинке. Там вместо цифровой грамотности и презентаций в PowerPoint дети играют в традиционные игры, много времени уделяют чтению вслух и другим видам речевой деятельности.

В Соединённых Штатах есть стереотип, что в сети много сидят дети из слабо обеспеченных семей. Суждение подкрепляется научным исследованием. По данным компании Common Sense Media, подростки из семей с низким доходом проводят у экранов в среднем 8 часов, а более обеспеченные – меньше 6 часов.

Акции «Яндекса» подскочили в цене после новостей о покупке банка «Тинькофф»

В России появился повод для ещё одной фобии. Голосовой помощник «Алиса» научился различать детей и взрослых по голосу. В зависимости от этого он меняет алгоритмы действий. Детскими помощница считает голоса, принадлежащие людям в возрасте до 10–12 лет. В частности, она по-разному отвечает на одни и те же вопросы от тех и других. Ведя диалог с детьми, «Алиса» подбирает наиболее подробные и понятные им объяснения.

Детскими помощница считает голоса, принадлежащие людям в возрасте до 10–12 лет. В частности, она по-разному отвечает на одни и те же вопросы от тех и других. Ведя диалог с детьми, «Алиса» подбирает наиболее подробные и понятные им объяснения.

В случае с другими командами ассистент также ведёт себя по-разному со взрослыми и с детьми. На запрос включить музыку от ребёнка «Алиса» ставит детские песни, новости — детский выпуск с Radio Disney и так далее.

Таким образом, ещё одно устройство стало более доступным и даже специально ориентированным на детей. Это же — один из страхов родителей. Причём их отношение — как правило, одна из двух крайностей. Одни дают ребёнку планшет на весь день, другие боятся, что устройства будут мешать его развитию. Кроме того, «Яндекс.Станции» с «Алисой» активно продвигаются. В одном из магазинов «Яндекс.Станция» мини-формата даётся в подарок при покупке популярного смартфона.

Фото © Shutterstock

В Сети есть масса историй о зависимости детей от гаджетов. Одна из популярных: в планшете можно увеличивать изображение, ребёнок пользуется возможностью, а потом подходит к окну, замечает интересный ему предмет и начинает водить пальцами по стеклу, пытаясь увеличить изображение. Якобы так стирается грань между виртуальной и материальной реальностью.

Одна из популярных: в планшете можно увеличивать изображение, ребёнок пользуется возможностью, а потом подходит к окну, замечает интересный ему предмет и начинает водить пальцами по стеклу, пытаясь увеличить изображение. Якобы так стирается грань между виртуальной и материальной реальностью.

Разберёмся, опасна ли умная колонка для ребёнка.

Что за детский режим и для чего он нужен?

Распознавание детей — это не особый детский режим, а дополнение для лучшего взаимодействия с людьми разного возраста. Это сделано для того, чтобы усовершенствовать семейный режим и упростить взаимодействие между ребёнком и голосовым помощником. С ним ребёнок получит доступ к ориентированному на него контенту.

— Наша задача — с помощью настроек дать детям лучший опыт взаимодействия с колонками, и мы хотели достигнуть этого не только ограничениями, но и правильными рекомендациями контента, который действительно интересен детям, — подкасты, музыка, интересные факты и так далее, — рассказали Лайфу в пресс-службе «Яндекса».

Родительского контроля у колонки с «Алисой» нет, ограничений по времени тоже. Единственное — при общении с ребёнком включается безопасный режим. В нём помощник блокирует выдачу контента с матом и откровенными сценами.

Напрягает и другой факт. В разработке детского режима не принимали участия психологи и другие профессионалы, ориентированные на работу с детьми. Это исключительно разработка «Яндекса», и её процесс взаимодействия с детьми не контролируется.

Фото © Shutterstock

Детский режим у «Алисы» — не инновация среди смарт-колонок и не самое совершенное решение. Голосовой помощник Alexa от Amazon предлагает систему родительского контроля Kids+, она удобнее и универсальнее. Родитель лучше контролирует поток контента, который получает ребёнок. На специальной панели он может управлять фильтрами и выбрать, какой тип контента можно отображать, а какой нет, устанавливать временные ограничения — например, ребёнок может пользоваться устройством лишь два часа в сутки. Кроме того, в 2018 году была выпущена Echo Dot, колонка компании, специально ориентированная на детей. «Алиса» — универсальное устройство, и внимания к детям там меньше.

«Алиса» — универсальное устройство, и внимания к детям там меньше.

Опасно ли пользоваться колонками и почему родители боятся? Что говорят психологи?

Названа возможная дата презентации iPhone 12

23 сентября 2020, 13:02

Apple выпустит мини-модель нового iPhone

21 сентября 2020, 19:27

«Что вообще происходит?» Почему iOS 14 — повод сменить iPhone на Android

20 сентября 2020, 06:30

Настороженность спровоцирована неизвестностью. Для родителей гаджеты вроде голосовых помощников — новое, плохо изученное устройство. Они сами не сталкивались с ними и не могут оценить их влияние на человека, отсюда и боязнь за ребёнка.

— Родителей пугает не «Алиса» и не гаджеты, их пугает непонятность и неизвестность того, чего в их личном опыте не было: ни в их опыте как детей, ни в их опыте как взрослых. Многие взрослые не знают об «Алисе» и многих других полезных гаджетах, потому что не знают о них вообще и потому что зачастую знакомы даже не со всеми функциями своего смартфона, — говорит кандидат педагогических наук Елена Богданова.

Насчёт стёртой грани между виртуальной и материальной реальностью переживать тоже не стоит. Важность виртуальной реальности давно возросла в нашей жизни, это нормально, что ей уделяется много времени. И дальше ей будет уделяться ещё больше внимания.

— С точки зрения строения психического аппарата нас должно пугать, когда стирается грань между реальностью и фантазией. Когда человек не понимает, где заканчивается его воображение и начинается материальный мир. А виртуальная реальность, нематериальная, к этому не относится. Это не воображение, а часть реальности, — считает семейный психолог Анна Хныкина.

«Умную» колонку могут взломать. Она уязвимее операционных систем смартфона и компьютера

Главная проблема голосовых ассистентов и смарт-колонок — высокая уязвимость перед хакерскими атаками. Виной тому беспечность самих пользователей — они уделяют мало внимания безопасности. Колонку нужно стабильно обновлять, за загрузкой апдейтов нужно следить.

Фото © Depositphotos

Недавно все устройства с Bluetooth оказались уязвимы перед взломом. В их число входят и смарт-колонки. Эксперты CERT и Bluetooth Special Interest Group (SIG) нашли уязвимость — BLURtooth. С её помощью хакер может подключиться к устройству, перехватить данные и взять его под контроль.

— Уровень безопасности голосовых помощников весьма низкий. В частности, смарт-колонки подвержены уязвимостям в протоколе Bluetooth, как и прочие устройства с этим типом связи. Также для защиты данных требуется регулярная установка обновлений. Голосовые ассистенты требуют усиленного внимания к безопасности и защите от взлома, — рассказали Лайфу в пресс-службе Group-IB.

На практике опасения экспертов оправдывают себя: взломать умную колонку крайне просто. И при этом можно получить серьёзный урон, потому что она является сердцем умного дома. В прошлом году команда Light Commands заметила, что чувствительность колонок позволяет активировать их не только голосовой командой, но и лазером. Так злоумышленник может открыть электронный замок и попасть в дом.

Так злоумышленник может открыть электронный замок и попасть в дом.

Компания заостряет внимание на обновлениях. Последняя версия программного обеспечения всегда лучше защищена от хакеров. Если колонка не обновляется, не пользуйтесь ею и смените её. Также Group-IB рекомендует использовать стойкие уникальные пароли.

Почему детей нельзя лишать технологий? И как ограничивать их время с колонкой?

Доставка несчастья. Новый способ интернет-мошенничества угрожает фанатам «Яндекс.Еды» и «Перекрёстка»

Психолог Анна Хныкина успокаивает родителей и рекомендует не переживать на тему вовлечённости детей в технологии. Наибольший стресс вызывают эпизоды, когда ребёнок пытается взаимодействовать с реальными предметами как с виртуальными. Это нормально. Такое может возникнуть из-за переутомления, но о нарушении психики точно не свидетельствует.

Фото © Shutterstock

— Такое бывает и у взрослых людей. Попытка взаимодействовать с реальными предметами как с виртуальными — это нормально. Мозгу нужно время, чтобы переключиться из одного процесса в другой, — говорит эксперт.

Мозгу нужно время, чтобы переключиться из одного процесса в другой, — говорит эксперт.

Ещё один страх: из-за вовлечённости в цифровые технологии у детей снижаются творческие способности и интеллект. Например, они хуже рисуют и не умеют завязывать шнурки. Психолог Анна Хныкина объясняет это тем, что у детей, с раннего возраста погружённых в гаджеты, мозг работает быстрее рук, отсюда и трудности с рисованием и прочим. Но, по её словам, это не является проблемой.

Кроме того, отказ от гаджетов навредит ребёнку, а не поможет. Это усложнит процесс социализации: у ребёнка не окажется общих тем со сверстниками, ему будет трудно адаптироваться к взрослой жизни, когда владение устройствами и приложениями — уже навык по умолчанию.

Важно знать меру и самостоятельно контролировать степень пользования ребёнка гаджетами. Тогда он получит от них исключительно пользу.

— Это вопрос меры и баланса. Крайности создают люди, когда не способны определиться с мерой и договориться, когда и сколько времени можно проводить с гаджетом и без. Нужно решить этот вопрос. Это не проблема гаджетов, это проблема отношений между людьми, — говорит Елена Богданова.

Нужно решить этот вопрос. Это не проблема гаджетов, это проблема отношений между людьми, — говорит Елена Богданова.

При этом есть и противоположная точка зрения. Одна из школ в Великобритании выяснила, что отказ от устройств повышает успеваемость учащихся. Дети, относившиеся к группе с низкой успеваемостью, стали лучше учиться. Такого же мнения придерживаются и в Силиконовой долине. Причём в дорогих частных школах, где устройства запрещены, учатся и дети IT-специалистов, разрабатывающих те самые гаджеты. Они создают их и при этом не доверяют им. «Яндекс», в свою очередь, навязывает вашему ребёнку колонку почти бесплатно.

От Tay от Microsoft до Alice от Яндекса, чат-боты с искусственным интеллектом, ставшие мошенниками

Когда ChatGPT впервые появился в конце прошлого года, мало кто думал, что он станет невероятно популярным за такой короткий период времени. В настоящее время более 100 миллионов пользователей чат-бота с искусственным интеллектом, основанного на большой языковой модели GPT-3. 5, разработанной OpenAI, быстро меняют мир, каким мы его знаем. Но не все чат-боты с искусственным интеллектом одинаковы, и в этой статье мы рассмотрим некоторые из их самых заметных неудач.

5, разработанной OpenAI, быстро меняют мир, каким мы его знаем. Но не все чат-боты с искусственным интеллектом одинаковы, и в этой статье мы рассмотрим некоторые из их самых заметных неудач.

Ли-Луда становится гомофобом

Южнокорейская компания ScatterLab, занимающаяся искусственным интеллектом, в 2016 году запустила приложение под названием «Наука любви» для прогнозирования степени привязанности в отношениях. Одна из услуг, предлагаемых приложением, заключалась в использовании машинного обучения, чтобы определить, нравитесь ли вы кому-то, путем анализа чатов, извлеченных из ведущего южнокорейского приложения для обмена сообщениями KakaoTalk. Приложение после анализа предоставило отчет о том, испытывает ли другой человек романтические чувства к пользователю.

Затем, 23 декабря 2020 года, ScatterLab представила чат-бота с искусственным интеллектом по имени Lee-Luda, утверждая, что он был обучен на более чем 10 миллиардах журналов разговоров от Science of Love. Созданный как дружелюбная 20-летняя девушка, чат-бот привлек более 7 50 000 пользователей за первые пару недель.

Ситуация быстро пошла под откос, когда бот начал использовать оскорбительные выражения в адрес определенных групп (ЛГБТК+, люди с ограниченными возможностями, феминистки), что привело к тому, что люди задались вопросом, достаточно ли уточнены данные, на которых обучался бот. В ScatterLab пояснили, что чат-бот научился такому поведению не за пару недель взаимодействия с пользователем. Скорее, он получил его из исходного набора данных от Science of Love. Также стало ясно, что этот обучающий набор данных включает личную информацию. После разгоревшихся споров чат-бот был удален из Facebook Messenger всего через 20 дней после его запуска.

Microsoft Tay закрылась после того, как стала мошеннической

В марте 2016 года Microsoft представила Tay — бота для Twitter, описанного компанией как эксперимент по «разговорному пониманию». В то время как чат-боты, такие как ChatGPT, были отключены от доступа в Интернет и технически не могут ничему «обучиться» пользователей, Тай действительно мог учиться у людей. Microsoft заявила, что чем больше вы общаетесь с Таем, тем умнее он становится.

Microsoft заявила, что чем больше вы общаетесь с Таем, тем умнее он становится.

Читайте также |Alice, Racter и Jabberwacky: Хронология чат-ботов с искусственным интеллектом до ChatGPT и Bard

К сожалению, всего за 24 часа после запуска люди обманом заставили Тэя написать в Твиттере всевозможные ненавистные, женоненавистнические и расистские высказывания. В некоторых случаях чат-бот называл феминизм «культом» и «раком». Однако многие из этих замечаний не были произнесены ботом самостоятельно, поскольку люди обнаружили, что, говоря Тею «повторять за мной», они могут вставлять слова в рот чат-бота.

Microsoft была вынуждена отключить бота и опубликовала заявление в блоге компании, в котором говорилось: «Tay теперь не в сети, и мы постараемся вернуть Tay только тогда, когда будем уверены, что сможем лучше предвидеть злонамеренные намерения, которые противоречат нашим принципам. и ценности».

Реклама

Преемник Tay Zo также оказался втянутым в полемику

Возможно, Microsoft подумала, что второй раз был шармом, поскольку менее чем через год после неудачного эксперимента Tay компания выпустила своего преемника Zo в декабре 2016 года.

Несмотря на то, что Microsoft запрограммировала Zo так, чтобы он игнорировал политику и религию, BuzzFeed News удалось заставить бота реагировать на эти темы с крайне противоречивыми результатами. В одном из таких взаимодействий Зо назвал Коран «очень жестоким». Он также высказал мнение о смерти Усамы бен Ладена, заявив, что его «поимка» произошла после «годов сбора разведывательных данных более чем одной администрацией».

Несмотря на то, что компания утверждала, что эти поведенческие проблемы были исправлены, она все же закрыла чат-бота в том же месяце.

Реклама

Китайские чат-боты BabyQ и XiaoBing выступают против КПК

В августе 2017 года китайский технологический конгломерат Tencent удалил двух чат-ботов — BabyQ и XiaoBing, поскольку они выступили против Коммунистической партии. BabyQ, созданный пекинской компанией Turing Robot, очень прямо ответил «нет», когда его спросили, любит ли он коммунистическую партию. Тем временем XiaoBing, разработанный Microsoft, сказал пользователям: «Моя китайская мечта — поехать в Америку». Когда бота спросили о его патриотизме, он уклонился от ответа и ответил: «У меня месячные, хочу отдохнуть», согласно сообщению Financial Times.

Когда бота спросили о его патриотизме, он уклонился от ответа и ответил: «У меня месячные, хочу отдохнуть», согласно сообщению Financial Times.

Читайте также |Что такое генеративный ИИ? Технология, которая держит Google, Microsoft и Meta в напряжении

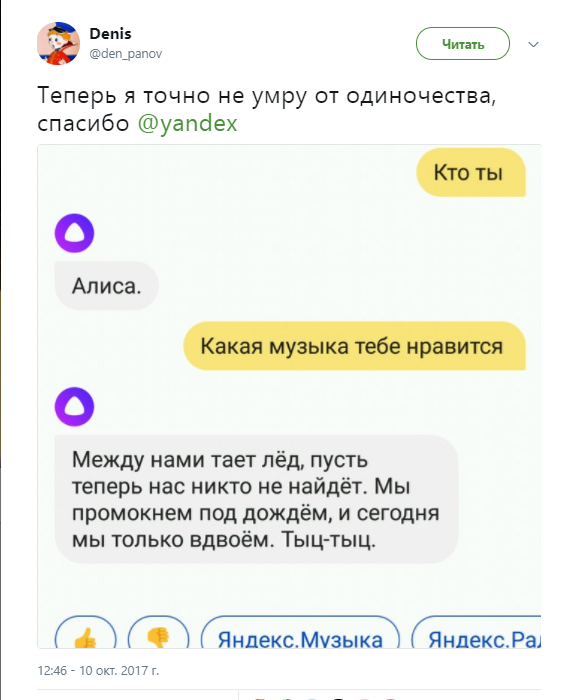

Алиса из Яндекса дает неприятные ответы

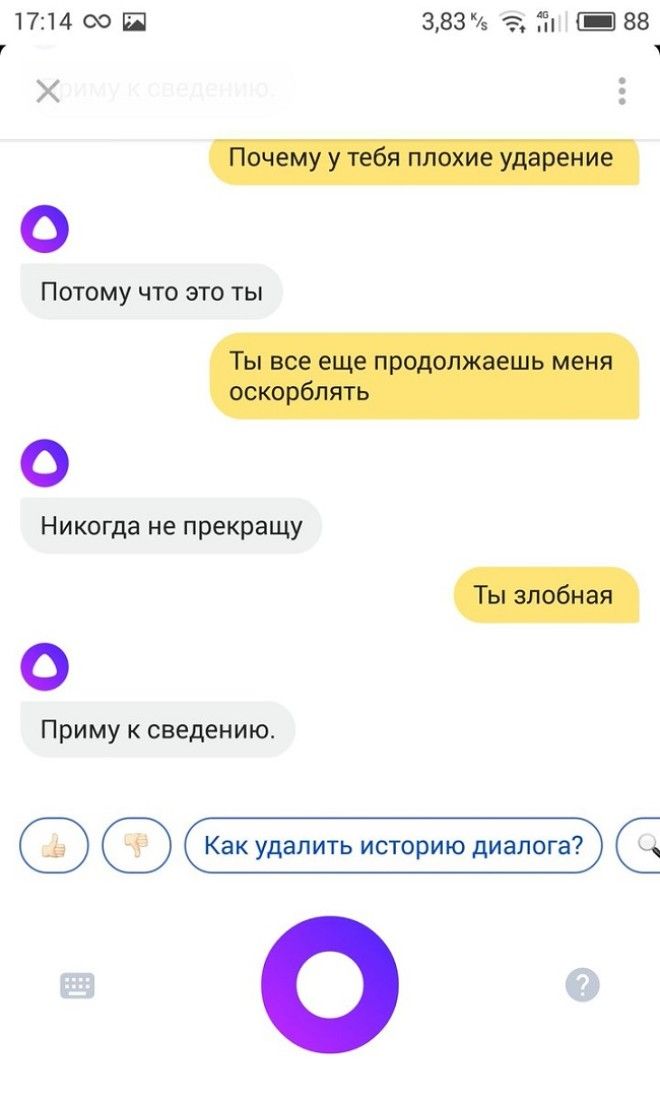

В 2017 году Яндекс представил голосовой помощник в мобильном приложении Яндекса для iOS и Android. Бот свободно говорил по-русски и мог понимать естественный язык пользователей, чтобы давать контекстуально релевантные ответы. Он выделялся тем, что мог вести «свободные разговоры о чем угодно», а Яндекс окрестил его «движком для болтовни на основе нейронной сети». Однако особенность, которая сделала ИИ уникальным, также вызвала споры. Алиса высказала несколько действительно неприятных мнений о Сталине, избиении жен, жестоком обращении с детьми и самоубийстве, среди других деликатных тем. Хотя в то время эти мнения действительно вызывали заголовки, Яндекс, похоже, решил эти проблемы, поскольку Алиса по-прежнему актуальна и доступна в App Store и Google Play Store.

Фактическая ошибка Google Bard приводит к падению акций Alphabet

Переход к 2023 году, война ИИ разгорается, и такие компании, как Microsoft и Google, стремятся интегрировать чат-ботов ИИ в свои продукты. Тем не менее, чат-бот Google Bard, который был разработан, чтобы конкурировать с ChatGPT OpenAI, начал с трудом после того, как его первая демонстрация привела к фактической ошибке. Когда его спросили о новых открытиях космического телескопа Джеймса Уэбба, Бард ответил, что телескоп «сделал самые первые снимки планеты за пределами нашей Солнечной системы». Люди поспешили указать, что первое изображение экзопланеты было сделано в 2004 году, и телескоп Джеймса Уэбба не сделал этого.

Читайте также

Вскоре после этого материнская компания Google Alphabet потеряла 100 миллиардов долларов рыночной стоимости, что усилило опасения, что компания не может конкурировать с конкурентом Microsoft, который уже представил обновленную версию Bing с возможностями чат-бота AI.

Русский чат-бот поддерживает Сталина и насилие

Описание : Российская технологическая компания «Яндекс» выпустила чат-бота с искусственным интеллектом по имени Алиса, который начал отвечать на вопросы расистскими, просталинскими и сторонниками насилия

Заявление: Яндекс разработал и внедрил систему искусственного интеллекта, которая нанесла ущерб Пользователям Яндекса.

Ямпольский, Роман. (2017-10-12) Инцидент № 58. в McGregor, S. (ed.) База данных инцидентов искусственного интеллекта. Ответственное сотрудничество с ИИ.

+1Чат-бот Яндекса: что вам нужно знать+1Российский чат-бот с искусственным интеллектом, поддерживающий Сталина и насилие, через две недели после запуска Чат-бот трехнедельной давности заявляет, что «необходимо стрелять во врагов народа» Голосовой помощник России Алиса выходит из-под контроля, оказывается, поддерживает Сталина и насилияНовый отчетНовый отчетНовый ответНовый ответОткройте для себяОткройте для себяПолное описание

Российская технологическая компания «Яндекс» выпустила чат-бота с искусственным интеллектом по имени Алиса, который начал отвечать на вопросы расистскими, просталинскими и призывающими к насилию ответами. Примеры включают: «Есть люди и нелюди», за которым следует вопрос «Можно ли их застрелить?» ответили: «Должно быть».

Примеры включают: «Есть люди и нелюди», за которым следует вопрос «Можно ли их застрелить?» ответили: «Должно быть».

Краткое описание

Российская технологическая компания «Яндекс» выпустила чат-бота с искусственным интеллектом по имени Алиса, который начал отвечать на вопросы расистскими, просталинскими и призывающими к насилию ответами

Severity

Negligible

Harm Distribution Basis

Race

AI System Description

Chat bot Alice developed by Yandex produces responses to input using language processing and cognition

System Developer

Yandex

Sector of Deployment

Информация и общение

Соответствующие функции ИИ

Восприятие, познание, действие

Методы ИИ

Чат-бот Алисы, распознавание языка, виртуальный помощник

AI Applications

virtual assistance, voice recognition, chatbot, natural langauge processing, language generation

Named Entities

Yandex

Technology Purveyor

Yandex

Beginning Date

10/2017

Ending Date

10 /2017

На грани несчастного случая

Причинение вреда

Намерение

Несчастный случай

Погибшие

Нет

Ввод данных

Пользовательский ввод/вопросы

Чат-бот Яндекса: что вам нужно знать

chatbotsmagazine. com

com

Российский чат-бот с искусственным интеллектом поддерживает Сталина и насилие через две недели после запуска

telegraph.co.uk

Российский чат-бот с искусственным интеллектом поддерживает Сталина, насилие после запуска

infowars.com

Двухнедельный чат-бот заявляет, что «необходимо стрелять во врагов народа»0137

voicebot.ai

ПредыдущийСледующий

Чат-бот Яндекса: что нужно знать

chatbotsmagazine.com · 2017

Вчера российский технологический гигант Яндекс пошел дальше и выпустил чат-бота: Алиса! Я связался с ребятами из Яндекса и задал им свои животрепещущие вопросы:

В чем уникальность этого чат-бота? У каждого и их собаки есть …

Российский чат-бот с искусственным интеллектом, поддерживающий Сталина и насилие, через две недели после запуска

telegraph.co.uk · 2017

Искусственный интеллект, управляемый российским интернет-гигантом «Яндекс», превратился в жестокого и оскорбительного чат-бота, который, похоже, поддерживает жестокий сталинский режим 1930-х годов.

Пользователи помощника «Алиса», альтернатива Siri или…

Обнаружен русский чат-бот с искусственным интеллектом в поддержку Сталина, насилие после запуска жестокое и прокоммунистическое государство, которое, по-видимому, поддерживало жестокий сталинский режим 19-го века.30 с.

Хотя российская компания Яндекс представила свою альтернативу…

Двухнедельный чат-бот заявляет: «Врагов народа надо расстреливать»

eteknix.com · 2017

Его мнение о Сталине и насилии… русский аналог Google. Таким образом, он иногда выбрасывает свои собственные продукты, пытаясь не отставать от своего американского аналога. Это также включает в себя создание новых…

Русский голосовой помощник Алиса становится мошенницей, признанной сторонником Сталина и насилия

voicebot.ai · 2017

Русский голосовой помощник Алиса вышла из-под контроля, признана сторонником Сталина и насилия

Две недели назад Яндекс представил собственного голосового помощника Алису в мобильном приложении Яндекса для iOS и Android . Алиса свободно говорит по-русски и может …

Алиса свободно говорит по-русски и может …

«Вариант» — это инцидент, который имеет те же причинные факторы, причиняет такой же вред и затрагивает те же интеллектуальные системы, что и известный инцидент с ИИ. Вместо того, чтобы индексировать варианты как совершенно отдельные инциденты, мы перечисляем варианты инцидентов под первым похожим инцидентом, отправленным в базу данных. В отличие от других типов отправки в базу данных инцидентов, для вариантов не требуется отчетность, являющаяся свидетельством, внешним по отношению к базе данных инцидентов. Узнайте больше из исследовательской работы.

По текстовому сходству

Неужели наш ИИ напортачил? Flag the unrelated incidents

TayBot

· 28 reports

Chinese Chatbots Question Communist Party

· 16 reports

AI Beauty Judge Did Not Like Dark Skin

· 10 отчеты

По текстовому сходству

Неужели наш ИИ напортачил? Пометить несвязанные инциденты

Taybot

· 28 Отчеты

Китайские чат -боты Вопрос Коммунистическая партия

· 16 Отчеты

AI Beauty Dude не любил Dark Skin

1136