| 28.04.2023 Показать все фотографии 28.04.2023 Показать все фотографии 28.04.2023 28.04.2023 Показать все фотографии 28.04.2023 Показать все фотографии 28.04.2023 Показать все фотографии 28.04.2023 27.04.2023 27.04.2023 Показать все фотографии 27.04.2023 Показать все фотографии 26.04.2023 Показать все фотографии 26. Показать все фотографии 26.04.2023 26.04.2023 26.04.2023 25.04.2023 Показать все фотографии 25.04.2023 Показать все фотографии 25.04.2023 24.04.2023 24. Новости

1 — 20 из 4982 |

Личный кабинет РГППУ, как написать обращение?

В этой статье мы узнаем, как пользоваться личным кабинетом РСППУ? Могу ли я связаться с приемной комиссией? Как отправлять запросы онлайн?

Содержание

- О ВУЗе

- Как написать обращение?

- Социальные сети

- Какой телефон горячей линии РГППУ?

- Адрес на карте

- Как войти в личный кабинет?

- Как получить пароль?

- Как восстановить пароль?

- Возможности личного кабинета

- Мобильное приложение

- Как отключить личный кабинет?

- Отзывы

О ВУЗе

Российский государственный профессионально-педагогический университет (РГППУ) расположен в Екатеринбурге и является крупным учебным заведением по подготовке педагогических и научных кадров в регионе. Желающих ознакомиться с перечнем кафедр и факультетов, филиалов можно найти на основном сайте вуза.

Желающих ознакомиться с перечнем кафедр и факультетов, филиалов можно найти на основном сайте вуза.

Как и в большинстве учреждений, в университете есть образовательный портал (дистанционное обучение).

Как написать обращение?

Если вы хотите отправить сообщение администрации или приемной комиссии, обратите внимание на следующие каналы связи:

- Форма заявки для организаций и жителей: https://www.rsvpu.ru/napisat-obrashhenie-v-rgppu.

- Электронная почта: [email protected].

Перед отправкой сообщения, пожалуйста, ознакомьтесь с правилами отправки официальных запросов. Вы должны указать:

- ПОЛНОЕ ИМЯ.

- Контакты.

- Предмет.

- Причины.

- Суть вопроса.

- Адрес.

В определенных ситуациях специалистам могут понадобиться фотографии или другой материал.

Обратная связь РСППУ также доступна пользователям образовательной среды: https://timeline.rsvpu.ru/Account/Login. Войдите в личный кабинет и заполните всплывающее окно в подразделе «Помощь».

Социальные сети

Есть много альтернативных способов общения с сотрудниками университета. Например, активно развивается социальная сфера.

У заведения есть свои сообщества в социальных сетях:

- ВКонтакте — https://vk.com/rsvpu_news.

- Фейсбук — https://facebook.com/groups/rsvpu.

- Ютуб — https://youtube.com/user/RsvpuVideo.

Пользователи могут делиться своими впечатлениями, узнавать новости.

Какой телефон горячей линии РГППУ?

Сразу отметим, что в вузе нет единого многоканального колл-центра, поэтому с кафедрами, ректоратом или приемной комиссией можно связаться по присвоенным номерам.

Подробнее о контактах смотрите на сайте: https://www.rsvpu.ru/kontakty-i-rekvizity.

Например, некоторые контакты с РСВПУ:

- Телефон ректора: +7 (343) 338 44 47.

- Телефоны приемной комиссии: +7 (343) 338 43 25, +7 (343) 338 38 73.

Звонки на все стационарные телефоны оцениваются с учетом тарифов, заявленных оператором.

Адрес на карте

Адрес вуза можно найти на Яндекс Картах.

Как войти в личный кабинет?

Для входа в образовательную среду (EOIS) обучающимся или преподавателям необходимо перейти во вкладку «Личный кабинет»: https://timeline.rsvpu.ru/Account/Login.

Для входа в личный кабинет пользователям необходимо указать:

- Пароль.

- Войти.

В случае ошибок доступа, других проблем с авторизацией студенты и сотрудники РСППУ могут обратиться в службу технической поддержки (одноименный подраздел по ссылке выше).

Как получить пароль?

Узнайте логин и пароль, необходимые для авторизации в системе, в учебной части кафедры (Отдел поддержки студентов, ауд. 0-101).

Для регистрации в EOIS студентам нужны только электронная почта и зачетная книжка. Для получения подробной информации, пожалуйста, свяжитесь с университетом.

Как восстановить пароль?

Восстановить доступ к личному кабинету можно несколькими способами:

- Через форму восстановления по ссылке: https://timeline.

rsvpu.ru/Account/ForgotPassword.

rsvpu.ru/Account/ForgotPassword. - Вернитесь в зону исследования.

В обоих случаях учащиеся должны подтвердить контактный адрес электронной почты, который ранее использовался для создания профиля.

Возможности личного кабинета

Среди основных особенностей студенческого аккаунта выделяются следующие:

- Смотрите расписание.

- Проверка оценок.

- Передача задач.

- Поиск материалов.

- Отправляет сообщения учителю.

Преподавательскому составу доступен контроль выполнения заданий, мониторинг успеваемости и другие задачи.

Мобильное приложение

Для смартфонов разрабатывается мобильное ПО.

О том, когда можно будет установить приложение и какое оборудование для этого используется, станет известно позже.

Как отключить личный кабинет?

Для деактивации аккаунта студенты или сотрудники РСППУ должны обратиться в академический отдел и написать заявление.

Отзывы

Отзывы об университете.

Российский государственный профессионально-педагогический университет, институт инженерно-педагогического образования в Екатеринбурге — Яндекс.Карты

История графических процессоров и цены на графические процессоры с течением времени

Если вам нужно продать видеокарты сейчас, перейдите по этой ссылке и заполните форму для получения бесплатного предложения.

В этой статье мы расскажем о богатой истории графических процессоров, а также о том, как графические процессоры развивались с течением времени вплоть до последних дней быстрого роста центров обработки данных Nvidia. В частности, мы расскажем о зарождении графических процессоров, затем о бурном росте ATI (затем AMD) и росте графических процессоров nvidia. Мы рассмотрим историю Nvidia с временной шкалой графического процессора Nvidia и временной шкалой графического процессора AMD. Затем мы обсудим появление современного графического процессора для центров обработки данных с последними предложениями графических процессоров Nvidia для центров обработки данных и предложениями графических процессоров AMD для центров обработки данных. Наконец, мы рассмотрим историю цен на GPU со списком цен на GPU с течением времени.

Наконец, мы рассмотрим историю цен на GPU со списком цен на GPU с течением времени.

Продайте свою видеокарту быстро и легко!

Ранняя история графических процессоров: 1949-1985

«Геометрический процессор»

Самая первая электроника, способная обрабатывать код в реальном времени для отображения графики, также оказалась тем, что, вероятно, стало отцом всех современных компьютеров: вихревой полет Массачусетского технологического института симулятор, разработанный для ВМС США. Это был первый компьютер, который обрабатывал данные параллельно, в отличие от простых линейных пакетных вычислений. Техническая формулировка будет бит-параллельной, а не однобитовой. Пока он не был закончен до 1951, к 1949 году машина могла использоваться как самая первая интерактивная графическая компьютерная игра.

Второй системой для цифровой обработки графики вполне мог быть симулятор полета, разработанный Кертисом-Райтом в 1954 году, изображенный ниже. 3D-графика и другие технологии графических процессоров, опередившие свое время, фактически были доступны еще в 60-х годах, но они были очень секретными и эксклюзивными для правительства, университетских лабораторий, авиационных и автомобильных компаний.

Затем Джеймс Кларк в Стэнфорде в 19 лет80 ввел первое использование «геометрического процессора СБИС для графики», что может быть первым когда-либо использованным термином, который примерно соответствует графическому процессору. Он выполнял около 4 миллионов операций с плавающей запятой в секунду, или FLOPS, что гораздо забавнее говорить. Это соответствует 900 полигонам каждые 30 секунд. Похоже, это первый графический чип, способный к массовому параллелизму, который примерно выполнял основные функции современных графических процессоров, хотя он, конечно, не был построен с той же базовой архитектурой и не имел большого количества возможностей.

История графического процессора: эра игровых автоматов (с 70-х по 80-е годы)

Тогда первые потребительские применения графического устройства были в ретро-аркадных играх и имели очень ограниченные возможности. По сути, они просто передавали графическую информацию от процессора к дисплею. В те годы технологии GPU со временем продвигались очень медленно.

Графика была очень примитивной, если вы помните некоторые оригинальные аркадные игры. НАПРИМЕР.

После тех первых аркадных игр, в 1976 году, RCA выпустила свой видеочип Pixie, но он поддерживал только монотонность, да и то в маленьком разрешении 62×128.

В 1979 году компания Xerox в Исследовательском центре Пало-Альто разработала первый графический интерфейс пользователя в рамках крупного совместного проекта. В нем были окна, значки, выпадающие меню и многие другие знакомые функции. В конце концов Стив Джобс посетил их объекты,

Три года спустя Namco Galaxian усовершенствовала графические чипы для поддержки цвета, а именно спрайтов с несколькими цветами и тайловых карт на заднем плане. Это было незадолго до 1980 года.

IBM выпустила то, что можно было бы назвать первой видеокартой с IBM Monochrome Display Adapter 9.0005

Графические возможности адаптера монохромного дисплея IBM (720 × 350)

Затем в 1983 году IBM выпустила свою 8-цветную поддерживающую карту ISBX 270, которая была новаторской в то время, хотя и довольно дорогой по цене 1000 долларов. Для справки, в сегодняшних долларах это будет 2633 доллара.

Для справки, в сегодняшних долларах это будет 2633 доллара.

Затем в 1984 году Sony придумала графический процессор для своей PlayStation (хотя он был разработан Toshiba).

Затем, что стало титаном истории графических процессоров, компания ATI была основана в 1985 братьев Лау и Квок Юэн Хо, иммигрантов из Гонконга, проживающих в Канаде. В конечном итоге ATI была выкуплена AMD. Подробнее об этом позже.

В 1986 году они выпустили первую серию графических процессоров Wonder. Эти карты были доминирующими в то время, потому что они поддерживали многие мониторы и графические стандарты на одной карте, а другие — нет.

В 1987 году был выпущен разъем видеографического массива, или VGA. VGA стал доминирующим стандартом в графике.

В 1989 году, чтобы исправить отсутствие стандартизации в индустрии компьютерной графики, ATI и семь других компаний основали Ассоциацию стандартов визуальной электроники. На сегодняшний день членами являются более 300 компаний.

В 1991 году S3 Graphics представила свой S3 911. По какой-то причине он был назван в честь Porsche и был довольно доминирующим. S3 действительно стал лидером в этой области после выпуска своей линейки Trio, которая какое-то время лидировала.

По какой-то причине он был назван в честь Porsche и был довольно доминирующим. S3 действительно стал лидером в этой области после выпуска своей линейки Trio, которая какое-то время лидировала.

Развитие графических технологий было существенно поддержано выпуском двух известных API. Возможно, самый распространенный API для рендеринга графики, OpenGL, был выпущен в июне 1992 года. Многие конкуренты приходили и уходили, но OpenGL остается победителем и сегодня.

Другой, Direct3d, был выпущен в 1996 году и остается стандартом в отрасли по сей день (хотя он явно на доли миллисекунды медленнее, чем OpenGL, чего бы это ни стоило).

Чипсет S3 Virge, выпущенный в 1995 году, на самом деле был самым быстрым ускорителем DRAM того времени для Windows. OEM-производители покупали Virge в больших количествах из-за его стоимости и производительности в 2D, но он определенно не был привлекательным из-за производительности в 3D.

Позже S3 продала свое графическое подразделение.

Дополнительная карта 3dfx Voodoo пользовалась огромной популярностью и стимулировала дальнейшее развитие 3D-технологий, в частности, для игр.

Линия Voodoo продолжала оставаться доминирующим игроком на рынке, пока Nvidia не приобрела их позже.

Возможно, первое официальное использование аббревиатуры GPU было компанией TriTech в 1996 году с их процессором геометрии.

Это был один из многих подобных проектов, которые так и не были реализованы, хотя у него были интересные функции, такие как специальное оборудование для карт рельефа и возможности карт смещения.

Microsoft лицензировала его у TriTech пару лет спустя.

Современная история графических процессоров — войны AMD против Nvidia (с 90-х по сегодняшний день)

Как ни странно, и у Nvidia, и у ATI в 90-х было тяжелое начало. Выпуску Nvidia NV1 помешал выпуск DirectX 1.0 вскоре после его выпуска, с которым он не был совместим.

У ATI Rage 1 тоже были проблемы из-за совместимости с DirectX 1. 0, хотя он хорошо работал в 2D.

0, хотя он хорошо работал в 2D.

В то время как ATI уже добилась определенного успеха за несколько лет до этого, Nvidia действительно впервые добилась известности с выпуском Riva в 1997, который продал миллион единиц всего за четыре месяца. Его популярность во многом обусловлена тем, что он был довольно, смею сказать, универсальным. Он поддерживал ускорение 2D, 3D и видео, и они также не были функциями-заполнителями, как это могло быть в случае со многими производителями графических процессоров.

При этом его успеху мешало отсутствие поддержки драйверов.

Nvidia Riva 128

Их правление действительно началось с Riva TNT 2. API 3dfx, Glide, проигрывал DirectX и OpenGL, которые начали свое падение. GeForce зацементировал это.

В 1999 году они сделали термин GPU широко используемым для обозначения «первого в мире GPU» — GeForce 256. Конечно, на самом деле это был не первый GPU. Начиная с эпохи Кларка, академики продолжали использовать GPU для обозначения обработки геометрии.

Ценностное предложение GeForce 256 было основано на том, что аппаратное обеспечение преобразования и освещения (или T&L) было встроено в сам графический чип, а не в центральный процессор. В результате, при наличии быстрого ЦП, способного удовлетворительно обрабатывать T&L, его ценность была незначительной. Его схема также подверглась справедливой критике. Это, в дополнение к высокой цене, означало, что она не была так популярна, как более поздние карты, хотя у нее была своя ниша с такими играми, как Quake.

На самом деле она также работала хуже, чем 3dfx Voodoo, если карты были соединены с быстрым процессором (хотя это не было ужасно распространенным сценарием). банкротство/приобретение.

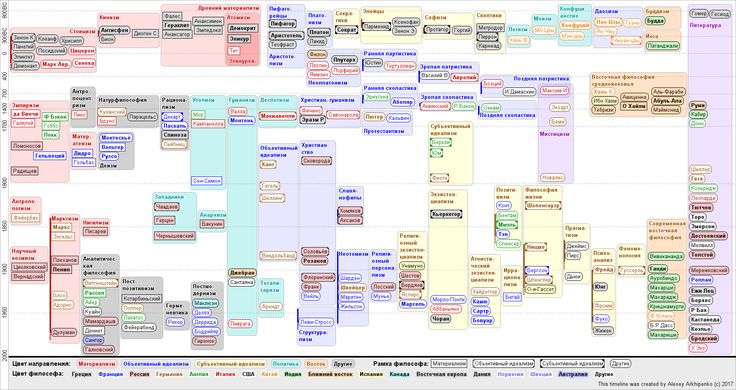

Прекрасная инфографика первых лет, представленная ниже, была сделана Джоном Педди в его основополагающем тексте «История визуальной магии в компьютерах», где он подробно описывает уровень детализации, доступный для книги.

Хронология Nvidia/AMD Timeline: их правление начинается

Nvidia оказалась в уникальном положении на рубеже тысячелетий. В то время как такие компании, как 3D Labs, производили многочиповые устройства, предназначенные для рынка рабочих станций, такие как Glint, Nvidia продолжала извлекать выгоду из быстрорастущего рынка видеоигр, на котором появилось гораздо больше покупателей.

В то время как такие компании, как 3D Labs, производили многочиповые устройства, предназначенные для рынка рабочих станций, такие как Glint, Nvidia продолжала извлекать выгоду из быстрорастущего рынка видеоигр, на котором появилось гораздо больше покупателей.

В результате Nvidia оказалась не только на игровом рынке, но и стала доминировать на рынке рабочих станций и предприятий, поскольку игровой рынок увеличил ее доходы и оставил у нее огромный бюджет на исследования и разработки.

Некоторыми из известных игровых релизов, из которых они выросли, были PlayStation 3, World of Warcraft и Xbox.

Nvidia выпустила GeForce второго поколения в 2000 году, которая работала очень хорошо, несмотря на медленную 166 МГц DDR, так как она оставалась самой быстрой картой, пока ATI не выпустила Radeon 7200.

(Кстати, Nvidia выпустила свой первый интегрированный графический продукт в 2001 году с nForce. )

Radeon 7200 отличается более высокой скоростью памяти, новой технологией оптимизации полосы пропускания под названием HyperZ и самой полной на сегодняшний день технологией рельефного отображения. Его впечатляющие возможности были продемонстрированы в следующей демонстрации Ark:

Его впечатляющие возможности были продемонстрированы в следующей демонстрации Ark:

(демонстрации можно загрузить на странице технической демонстрации Nvidia.

Nvidia ответила своей GeForce 2 GTS, которая предложила почти наполовину процентное улучшение, завоевала игровую нишу OpenGL и, конечно же, 16 бит в Direct3D. Его доминированию действительно мешала плохая оптимизация пропускной способности памяти.

Примерно в это же время Nvidia начала извлекать выгоду из сегмента рабочих станций с помощью Quadro, который по сути представлял собой просто архитектуру GeForce 2 с большим упором на точность и надежность (за счет использования памяти ECC). Перепаковывая GeForce с большим количеством наворотов и сегментируя функции только по мере необходимости между картами, Nvidia могла бы взимать дополнительную плату за Quadro, оставаться конкурентоспособной по ценам на игровые карты, но при этом предотвращать использование более дешевой GeForce на рабочих станциях.

Несмотря на то, что Radeon устранил проблемы с пропускной способностью памяти с помощью HyperZ среди других функций, он по-прежнему не очень выгодно сравнивался с Voodoo 5 5500 или GeForce 2 GTS, хотя он достаточно хорошо работал в 32-битном цвете и по-прежнему продавался достаточно хорошо.

Nvidia продолжает лидировать с GeForce 3:

Как видите, они значительно улучшили процесс рендеринга благодаря новой улучшенной архитектуре.

Затем ATI ответила своим Radeon 9700 про. Он поддерживал 64- и 128-битный цвет, DirectX 9, AGP 8X и имел впечатляющие характеристики чипа 0,15 микрон.

https://youtu.be/Xu-A0jqMPd8

Radeon 9700 Pro DemoУ Nvidia не было конкурентов до 2004 года с их GeForce 6800.

В 2006 году мы вступили в современную эру графических процессоров с картами GeForce 8-го поколения, GeForce 8800. Он был очень популярен, и мы начали видеть рендеринг, отображение, затенение. освещение, риггинг, постобработка и т. д., которые находятся на том же уровне качества, что и карты последнего десятилетия. Например, он может играть в Skyrim от Bethesda, которая до сих пор остается популярной игрой.

Он был очень популярен, и мы начали видеть рендеринг, отображение, затенение. освещение, риггинг, постобработка и т. д., которые находятся на том же уровне качества, что и карты последнего десятилетия. Например, он может играть в Skyrim от Bethesda, которая до сих пор остается популярной игрой.

Примерно в то же время Nvidia стала единственным независимым производителем графических чипов, оставшимся в бизнесе после приобретения ATI компанией AMD.

Они разработали архитектуру Tesla, поддерживающую унифицированные шейдеры, и отказались от микроархитектур с фиксированным конвейером. Он использовался до тех пор, пока не умер 40 нм. Это было крайне важно для перехода на GPU общего назначения.

Вместо кучи отдельных блоков, таких как вершинные/пиксельные шейдеры, у вас были более универсальные потоковые процессоры. Они были более эффективными в широком диапазоне вариантов использования, а поскольку они были простыми, тактовые частоты можно было увеличить.

В 2007 году Nvidia выпустила Cuda, которая позволила разработчикам/инженерам программного обеспечения использовать возможности параллельной обработки своих графических процессоров для операций более общего назначения.

Конкуренция продолжается сегодня (следующие три года графических процессоров)

Графический процессор общего назначения (или рост числа графических процессоров для центров обработки данных)

Сегодня название графического процессора является ошибочным пережиток прошлого, поскольку за последнее десятилетие технология графических процессоров сильно отошла от игр.

Теперь это системы на чипах, или SoC, как их обычно называют. У них есть все схемы и функции, которые вы могли бы ожидать от ряда отдельных компонентов, но как единая система. В частности, у вас есть процессор с большим количеством параллельной обработки, наряду с механизмом ускорения нейронной сети, процессорами цифровых сигналов для преобразования аналоговых входных изображений и аудио, растеризатором и т. д. Графические процессоры

сегодня используются для ускорения инженерных приложений, физического моделирования. , ракетная техника, финансовый анализ и торговля, медицинская визуализация, клинические исследования и машинное обучение, и это лишь некоторые из них..jpg)

Например, GPU, возможно, самое передовое приложение, широко используется в качестве инструмента логического вывода ИИ в телефонах и транспортных средствах.

Nvidia Drive, мозг, стимулировавший рост возможностей автономных транспортных средств

Хотя на самом деле это не ИИ, графические процессоры по-прежнему называют «механизмами вывода искусственного интеллекта», что на самом деле является просто причудливым способом сказать, что он делает «выводы» или идеи. из существующих данных. Например, если у вас есть Google Photos или другое облачное приложение для работы с изображениями, вы можете заметить, что оно идентифицирует другие изображения с одним и тем же человеком, а затем группирует их вместе. Это достигается с помощью графических процессоров в основном посредством «обучения», когда Google может спросить вас: «Это тот же человек?»

Причина, по которой графические процессоры подходят для этой задачи, заключается в том, что для обучения такого экземпляра машинного обучения требуется огромное количество необработанных количественных возможностей обработки, когда терабайты изображений должны сканироваться одно за другим. Масштабируемость потоковых процессоров очень хорошо подходит для таких задач.

Масштабируемость потоковых процессоров очень хорошо подходит для таких задач.

Другим примером недавней технологии графических процессоров может быть 3D-сканирование тел, например, магнитно-резонансная томография или МРТ, которую Nvidia также в значительной степени инновировала.

Если вы внимательно следили за новостями, вы, возможно, видели феномен «складывания дома», когда суперкомпьютеры и краудсорсинговые вычисления позволили исследователям лучше понять белковую механику Sars-Cov-2 или Covid-19. ExIT Technologies на самом деле внесла один из главных вкладов в вычислительную мощность этого проекта, и мы добились этого в основном за счет использования множества графических процессоров, используемых параллельно.

Одна из систем, которую мы использовали для складывания дома

. В то время как в предыдущие годы на подобный проект уходили месяцы, технология графических процессоров со временем выросла настолько, что мы можем почерпнуть информацию, например, о молекулярных механизмах стыковки Covid-19. пиковый белок в днях.

пиковый белок в днях.

В более универсальном смысле графические процессоры общего назначения значительно ускоряют процессы, чтобы сократить время, необходимое инженерам, исследователям, разработчикам программного обеспечения и т. д. для решения проблем, создания новых проектов и анализа больших массивов данных. Отсюда и термин ускорение приложений.

Более того, ответы, которые мы получаем, более точны и надежны; когда вам нужно сократить данные, чтобы быстро найти ответ, вы жертвуете большой точностью и аккуратностью.

В этом году Nvidia опередила любую другую компанию в мире с точки зрения чистой вычислительной мощности благодаря процессору A100 и системам DGX второго поколения.

Он умещает 54 миллиарда транзисторов всего на нескольких сотнях миллиметров. Вся эта необработанная вычислительная мощность может быть разделена на 7 отдельных графических процессоров, которые работают независимо, или на несколько экземпляров графического процессора (MIG).

NVlink 3-го поколения удвоил скорость соединения между процессорами и встроил разреженность в само оборудование.

Это, наряду с тензорными ядрами 3-го поколения, означает, что один сервер с графическим процессором A100 обеспечивает 5 торфяных выходных данных. Он предлагал в 7 раз более качественные выводы и в 6 раз лучшую производительность обучения. Фактически, A100 обеспечил самый большой скачок в одном поколении любого выпуска Nvidia.

Архитектура Nvidia Ampere

На самом деле одним быстрым движением Nvidia позволила одной системе делать то, что раньше было возможно только с гигантским центром обработки данных. Один DGX SuperPOD, состоящий из серверов A100, конкурирует с самыми быстрыми суперкомпьютерами в мире.

Если раньше на завершение масштабного суперкомпьютерного проекта уходили месяцы и годы, то Nvidia потребовалось всего несколько недель, чтобы завоевать титул самого быстрого суперкомпьютера в мире.

Будет интересно посмотреть, как ответят конкуренты.

Хронология графических процессоров Nvidia (современная версия)

Примечание. Мы приобретаем все следующие графические процессоры. Получите бесплатное предложение, если у вас есть запчасти, которые вы хотите продать.

Мы приобретаем все следующие графические процессоры. Получите бесплатное предложение, если у вас есть запчасти, которые вы хотите продать.

Хронология графических процессоров AMD (современные)

Примечание: мы покупаем все следующие графические процессоры. Получите бесплатное предложение, если у вас есть запчасти, которые вы хотите продать.

Графические процессоры Radeon Instinct Графические процессоры Radeon Pro Графические процессоры Radeon RXЦены на бывшие в употреблении графические процессоры

Цена Nvidia V100

Nvidia V100 стоит около 8000 долларов по состоянию на 2 августа 020 для нового графического процессора, тогда как бывшая в употреблении карта может стоимость близка к этой или всего на несколько тысяч долларов меньше, в зависимости от состояния.

Цена Tesla P100

Стоимость графического процессора Tesla P100 в розницу превышает 3000 долларов, хотя бывшие в употреблении графические процессоры и графические процессоры, приобретаемые оптом, будут стоить меньше этой цифры.

Цена Tesla P40

Подержанный Tesla P40 стоит около 3500 долларов США за проданные объявления на eBay на момент написания статьи 03.08.2020, хотя оптовые заказы и заказы с различным состоянием будут иметь разную стоимость.

Цена Tesla M10

Стоимость Tesla M10 составляет от 1000 до 1500 долларов за единицу, проданную на eBay, хотя оптовые заказы или заказы с худшими условиями будут стоить меньше за единицу.

Цена Tesla M60

Стоимость Tesla M60 составляет от 1000 до 1500 долларов США за единицу, проданную на eBay, хотя оптовые заказы или заказы с худшими условиями будут стоить меньше за единицу.

Quadro RTX 8000 Цена

Стоимость Nvidia Quadro RTX 8000 варьируется от 3000 до 5000 долларов в зависимости от продаж на eBay. Однако оптовые продажи и карты с более низким состоянием будут стоить меньше за единицу.

Однако оптовые продажи и карты с более низким состоянием будут стоить меньше за единицу.

TITAN RTX Цена

По состоянию на август 2020 года Titan RTX продается по цене около 2000 долларов США за единицу, хотя оптовая продажа дешевле.

RTX 2080 TI Цена

Nvidia RTX 2080 TI в настоящее время продается подержанной примерно за 1500 долларов; единицы, купленные оптом, конечно, будут продаваться дешевле.

Цена Nvidia Titan V

Титан V продается по цене от 1300 до 5000 долларов в настоящее время. Рынок, скорее всего, скоро стабилизируется на нижнем уровне.

Цена Nvidia Titan XP

Titan XP в настоящее время продается по цене от 600 до 1500 долларов США в верхнем ценовом диапазоне.

Nvidia Tesla T4 Цена

Подержанный Tesla T4 в настоящее время продается по цене около 1300 долларов, хотя при оптовых сделках цена ниже.

Quadro RTX 6000 Цена

В настоящее время Quadro RTX 6000 продается примерно за 3000 долларов США. Конечно, при оптовой продаже цена ниже.

Конечно, при оптовой продаже цена ниже.

Цена Tesla P4

Тесла P4 в настоящее время продается по цене от 1000 до 1200 долларов. Новые единицы будут продаваться дороже, в то время как оптовые продажи будут дешевле за единицу.

Quadro RTX 5000 Цена

Подержанная карта Nvidia Quadro RTX 5000 продается по цене от 1300 до 1800 долларов. Новые единицы продаются по более высокой цене, в то время как оптовые продажи имеют более низкую цену за единицу.

Nvidia Quadro RTX 4000 Цена

В настоящее время Quadro RTX 4000 продается по цене от 600 до 1000 долларов, в зависимости от состояния. Однако оптовые продажи будут стоить дешевле за единицу.

Quadro GV100 Цена

Графический процессор Nvidia Quadro GV100 продается по цене от 3000 до 5000 долларов США, при этом 5000 долларов США — это верхняя граница для одного устройства в идеальном состоянии, а 3000 долларов — нижняя граница. При оптовой продаже, конечно же, цены ниже.

Nvidia Quadro P6000 Цена

Подержанный Quadro P6000 продается примерно за 1500 долларов в идеальном состоянии, при этом более новые устройства стоят немного дороже, а оптовые продажи предоставляются со скидкой.

Nvidia Quadro P5000 Цена

Nvidia Quadro P5000 стоит около 800-900 долларов, при этом новые устройства продаются немного дороже, а устройства продаются оптом по умеренно более низкой цене за единицу.

Quadro P4000 Цена

Nvidia Quadro P4000 продается примерно за 500 долларов в зависимости от количества и состояния.

GeForce RTX 2080 Super Цена

GeForce RTX 2080 Super продается по цене от 600 до 800 долларов США, в зависимости от состояния и количества. Массовые продажи будут снижаться.

Часто задаваемые вопросы о других графических процессорах

Является ли Nvidia собственностью ASUS?Нет. Nvidia просто зависит от ASUS в удовлетворении своих производственных потребностей. ASUS производит графические процессоры, разработанные Nvidia, как, например, ASUS Geforce. AMD лучше, чем Nvidia? Это зависит от того, что вы ищете. Хотя иногда вы можете найти более выгодное предложение на графические процессоры AMD, Nvidia, безусловно, намного опережает рынок корпоративных графических процессоров, а также лидирует на потребительском рынке, хотя AMD и Nvidia сопоставимы для большинства потребительских приложений. Может ли AMD победить Nvidia?AMD удалось преуспеть в качестве конкурента Intel, поэтому для них вполне возможно выйти вперед в войнах графических процессоров. При этом графические процессоры продолжают все больше переплетаться с приложениями машинного обучения, и отдел исследований и разработок Nvidia добился больших успехов в этой области. Трудно сказать, изменит ли прикладная сторона машинного обучения то, как разрабатывается аппаратное обеспечение графического процессора, но Nvidia в этом смысле занимает хорошие позиции. Является ли Nvidia китайской компанией?Нет, но значительная часть роста продаж Nvidia пришлась на китайский рынок, и впоследствии акционеры Nvidia в некотором смысле обязаны Китаю. Если Китаю нужно что-то от Nvidia, что не приведет к потере массовых продаж в других областях, Nvidia, скорее всего, сделает это. Какие компании используют Nvidia? Практически каждая крупная облачная компания и компания, занимающаяся искусственным интеллектом, использует Nvidia, поскольку они лидируют с точки зрения технологии графических процессоров корпоративного уровня. Intel делает GPU?Да, графический процессор Intel Xe должен быть анонсирован в этом месяце, в августе. Деталей мало. Узнайте больше здесь. Почему видеокарты в 2020 году такие дорогие?Стоимость графических процессоров увеличилась частично из-за возросшего спроса на DRAM, а также из-за увеличения расходов на НИОКР, необходимых для изготовления новых систем графических процессоров. Например, Nvidia потратила 2,8 миллиарда долларов на исследования и разработки в последнем финансовом году. Как мне проверить мой GPU?Самый простой способ протестировать GPU — запустить тестовое ПО. Одной из самых популярных программ для бенчмаркинга является 3DMark, которую можно скачать в Steam по цене. Вы также можете использовать бесплатный тест Heaven Benchmark, если не хотите ничего платить за тестирование своих графических процессоров. Из-за чего умирает графический процессор? Графический процессор может выйти из строя по ряду причин. Лучше ли GTX, чем RTX?

«RTX» просто относится к возможностям трассировки лучей новой модели видеокарты. Это не совсем другая категория карт, а преемник предыдущего поколения GTX. На самом деле нет причин покупать старые карты GTX, кроме стоимости, если вы хотите получить бюджетный вариант графического процессора. Может ли графический процессор изнашиваться?Да, вы можете постепенно изнашивать графический процессор, что приводит к снижению его производительности. Электролитические конденсаторы на плате могут быстрее высохнуть, если ваш графический процессор чрезмерно нагревается во время работы. Кроме того, электромиграция, когда электроны движутся вокруг атомов металла, может создавать зазоры в проводниках, что в конечном итоге приводит к выходу из строя. При этом производительность большинства графических процессоров существенно не снижается в течение их типичного срока службы. |

Есть что добавить? Дайте нам знать ваши мысли в комментариях ниже!

История графических карт Nvidia

Компания Nvidia была основана в 1993 году, но только в 1995 году компания выпустила свой первый графический продукт — NV1.

С тех пор многое изменилось, и теперь мы избалованы трассировкой лучей, DLSS и другими замечательными технологиями, которые делают наши игровые возможности еще более приятными.

Мы оглядываемся на историю видеокарт Nvidia и на то, как эти устройства выглядели на протяжении многих лет.

Nvidia NV1

Swaaye/WikipediaNvidia NV1 была выпущена в 1995 году и могла обрабатывать как 2D, так и 3D видео. Он продавался как «Diamond Edge 3D» и даже имел порт для джойстика, совместимый с Sega Saturn.

Некоторые игры Sega Saturn были перенесены на ПК, включая Panzer Dragoon и Virtua Fighter Remix. Одних этих функций было недостаточно, чтобы привлечь рынок, поскольку Saturn изо всех сил пытался конкурировать с оригинальной PlayStation.

У NV1 был тяжелый старт, который усугубился выпуском Microsoft DirectX, который был несовместим с графическим процессором, и многие игры не запускались.

Nvidia RIVA 128

Матиас Табо/Википедия В 1997 году Nvidia выпустила NV3, также известную как Riva 128, Riva расшифровывалась как «Интерактивное видео и анимация в реальном времени». Эта видеокарта использовала как 2D-, так и 3D-ускорение, а также наложение полигональных текстур.

В то время конкурент Nvidia, 3dfx, доминировал на рынке, но NV3 имел тактовую частоту ядра/памяти 100 МГц и, по сути, удвоил характеристики 3dfx Voodoo 1.

Было два варианта NV3: Riva 128 и Рива 128ZX. Последний был более мощным с 8 МБ видеопамяти и тактовой частотой 250 МГц.

NV3 оказался гораздо более успешным, чем первый GPU компании, и помог Nvidia завоевать широкую популярность.

Nvidia NV4

Tors/WikipediaВ 1998 году Nvidia выпустила NV4, также известную как Riva TNT. Эта видеокарта улучшена по сравнению с предыдущими моделями за счет поддержки 32-битного True Colour. NV4 также имел больше оперативной памяти с 16 МБ SDR SDRAM, что также означало более высокую производительность.

Примерно в это же время Nvidia начала предпринимать шаги по регулярному обновлению графических драйверов, чтобы обеспечить хорошую производительность и совместимость для конечного пользователя, чем компания занимается и по сей день.

Riva TNT от Nvidia была более доступной в то время, чем Vodoo2 от 3dfx, хотя и немного медленнее с точки зрения производительности. Поддержка драйверов была ключом к успеху NV4.

Поддержка драйверов была ключом к успеху NV4.

Nvidia NV5

Uwe Hermann/WikipediaВ 1999 году Nvidia последовала за NV4, выпустив RIVA TNT2. NV5, как она называлась, приобрела ряд обновлений, включая поддержку 32-битного Z-буфера/трафарета, до 32 МБ видеопамяти и поддержку текстур 2048 x 2048.

Что еще более важно, эта видеокарта имеет улучшенную тактовую частоту (до 150+ МГц), что дает прирост производительности на 17% по сравнению с предыдущей моделью.

Эта карта была прямым конкурентом 3dfx Voodoo3 и обе были невероятно популярны.

Nvidia GeForce 256

Hyins/WikipediaВ конце 1999 года Nvidia выпустила «первый в мире графический процессор» — Nvidia GeForce 256.

Это был умный маркетинговый ход со стороны Nvidia и начало любовь к графическим картам GeForce на долгие годы.

Он был улучшен по сравнению с предыдущими картами RIVA за счет увеличения пиксельных конвейеров, но также обеспечил значительный скачок в производительности для компьютерных игр.

Эта карта поддерживает до 64 МБ DDR SDRAM и работает на частоте до 166 МГц. Таким образом, он был на 50 процентов быстрее, чем NV5.

Что еще более важно, GeForce 256 также полностью поддерживала Direct3D 7, что означало, что на нем можно было запускать многие из лучших игр для ПК, доступных в то время.

Вскоре после этого запуска 3dfx обанкротилась, и основным конкурентом Nvidia стала ATI.

Nvidia GeForce2

Hyins/WikipediaNvidia последовала за первым в мире графическим процессором с метко названным GeForce2.

Этот графический процессор выпускался в нескольких различных вариантах, включая модели Ti, Pro, GTS и Ultra. По сути это были карты NV11, 15 и 16. В выпусках 2000 и 2001 годов наблюдалось увеличение конвейеров и более высокая тактовая частота.

Что сделало GeForce2 интересным, так это начало поддержки многомониторных систем.

Примерно в это же время Nvidia приобрела 3dfx.

Nvidia GeForce3

Hyins/Wikipedia Вскоре после GeForce2 появилась GeForce3. Эта серия видеокарт под кодовым названием NV20 представляла собой первые графические процессоры Nvidia, совместимые с DirectX 8.

Эта серия видеокарт под кодовым названием NV20 представляла собой первые графические процессоры Nvidia, совместимые с DirectX 8.

Было три версии — GeForce3, GeForce3 Ti 200 и GeForce3 Ti 500. В этом следующем графическом процессоре GeForce были добавлены программируемые пиксельные и вершинные шейдеры, а также мультисэмплерное сглаживание.

Версия GeForce3, именуемая NV2A, использовалась в оригинальной консоли Xbox.

Серия Nvidia GeForce FX

Hyins/WikipediaСкачок вперед на пару поколений, и в 2003 году мы выпускаем серию Nvidia GeForce FX.

Это были видеокарты GeForce пятого поколения с поддержкой Direct3D 9.а также ряд новых технологий памяти. К ним относятся DDR2, GDDR2 и GDDR3, а также первая попытка Nvidia использовать шину данных памяти шире 128 бит.

Между тем, GeForce FX 5800 произвела фурор, став первым графическим процессором, оснащенным большим кулером. Один такой большой, что его часто называли «пылесборником» из-за большого количества шума вентилятора.

Серия Nvidia GeForce 6

Hyins/WikipediaВскоре после выпуска серии GeForce FX появилась серия 6 (она же NV40). GeForce 6 стала началом продвижения Nvidia технологии SLI, позволяющей людям комбинировать более одной видеокарты для большей мощности.

Флагманом этой линейки была GeForce 6800 Ultra, видеокарта с 222 миллионами транзисторов, 16-пиксельными суперскалярными конвейерами и шестью вершинными шейдерами. Он имел поддержку Shader Model 3.0 и был совместим как с Microsoft DirectX 9.0c, так и с OpenGL 2.0.

В этой серии также использовалась технология Nvidia PureVideo, и она могла декодировать видео H.264, VC-1, WMV и MPEG-2 с меньшим использованием ЦП.

В результате все это привело к большому успеху серии GeForce 6.

Серия Nvidia GeForce7

FxJ/WikipediaВ 2005 году вышла серия GeForce7, включая 7800 GTX.

Одна только эта карта была настоящей электростанцией для того времени, и благодаря умному охлаждению Nvidia смогла увеличить тактовую частоту до 550 МГц. При этом компании также удалось уменьшить латентность и увеличить шину до 512 бит.

При этом компании также удалось уменьшить латентность и увеличить шину до 512 бит.

Интересно, что версия серии 7 была создана как синтезатор реальности RSX, который был проприетарным процессором, созданным совместно Nvidia и Sony для PlayStation 3.

Серия Nvidia GeForce8

Shooke/WikipediaВ 2006 году Nvidia выпустила серию GeForce8 и представила свою микроархитектуру Tesla. Это был первый унифицированный дизайн шейдеров компании, и он также станет одной из наиболее часто используемых архитектур в будущих картах.

Популярная Nvidia GeForce 8800 GTX была флагманом линейки и пользовалась невероятной популярностью. Он имел 681 миллион транзисторов, 768 МБ памяти GDDR3 и 128 шейдеров с тактовой частотой 575 МГц.

Наиболее важно то, что эта видеокарта могла запускать Crysis, а это было всем, чего хотели компьютерные геймеры в то время.

В 2006 году ситуация также накалялась, когда AMD купила ATI за 5,4 миллиарда долларов и стала занозой в боку Nvidia на долгие годы.

Серия Nvidia GeForce9

Sk/WikipediaВ начале 2008 года Nvidia выпустила серию GeForce9. Эти карты продолжали использовать архитектуру Tesla, но также добавили поддержку PCIe 2.0, улучшенный цвет и z-сжатие.

К этому времени Nvidia подняла производительность на ступеньку выше, тактовая частота достигла 675 МГц, при этом энергопотребление также снизилось.

Серия Nvidia GeForce 400

AmazonСледующее значительное обновление произошло в 2010 году, когда Nvidia выпустила серию GeForce 4000. Именно тогда Nvidia представила микроархитектуру Fermi, которая стала следующей крупной архитектурой компании.

Эта серия также имела поддержку OpenGL 4.0 и Direct3D 11 и была прямым конкурентом серии Radeon HD 5000.

Однако серию подвели высокие рабочие температуры и энергопотребление, что вызвало множество недовольств пользователей.

Серия Nvidia GeForce 600

HanyNAR Серия GeForce 600 представила архитектуру Nvidia Kepler, которая была разработана для увеличения производительности на ватт, а также улучшения производительности предыдущей микроархитектуры Fermi.

С помощью Kepler Nvidia удалось увеличить тактовую частоту памяти до 6 ГГц. Он также добавил GPU Boost, который гарантировал, что GPU сможет работать на минимальной тактовой частоте, а также повышать производительность при необходимости, пока не будет достигнуто заранее определенное целевое значение мощности.

Этот диапазон также поддерживал как Direct3D 11, так и Direct3D 12. Он также представил новый метод сглаживания, известный как TXAA.

Серия Nvidia GeForce 700

Маркус БернсВ 2013 году Nvidia подняла ситуацию на новый уровень, выпустив серию 700, которая была дополнена безумной высококлассной картой для энтузиастов GTX Titan.

Эта серия была обновлением микроархитектуры Kepler, но некоторые более поздние карты также имели архитектуры Femi и Maxwell.

GTX Titan может похвастаться 2688 ядрами CUDA, 224 TMU и 6 ГБ оперативной памяти. К этому времени Nvidia удалось втиснуть в свои графические процессоры целых семь миллиардов транзисторов.

Серия GeForce 700 была разработана для обеспечения максимальной энергоэффективности, но также включает в себя другие функции, такие как аппаратное кодирование H.264, интерфейс PCI Express 3.0, поддержку DisplayPort 1.2 и HDMI 1.4a 4K x 2K видеовыхода, а также GPU-Boost 2.0. .

Серия Nvidia GeForce 900

Маркус БернсВ 2014 году Nvidia, казалось бы, пропустила поколение и сразу приступила к серии GeForce 900. Это было введение в микроархитектуру Maxwell, которая предлагала улучшенные графические возможности, а также лучшую энергоэффективность.

Первым флагманом этой серии была GeForce GTX 980, за которой позже последовали 980 Ti и GeForce GTX TITAN X в самом конце.

Для этой серии также был улучшен NVENC и появилась поддержка Direct3D 12_1, OpenGL 4.6, OpenCL 3.0 и Vulkan 1.3.

Серия Nvidia GeForce10

Маркус Бернс В 2014 году Nvidia представила серию GeForce10 на основе микроархитектуры Pascal. GTX 1080 Ti, пожалуй, самый известный из графических процессоров этой серии и закрепил за собой историю как, пожалуй, одна из самых значимых карт, выпущенных Nvidia.

Эта графическая карта доминировала на рынке и предлагала такую превосходную производительность и энергоэффективность по сравнению с ценой, что ее часто будут упоминать при сравнении с будущими графическими процессорами.

Серия 10 также включает новые функции, такие как GPU Boost 3.0, система планирования динамической балансировки нагрузки, тройная буферизация и поддержка DisplayPort 1.4 и HDMI 2.0b.

Серия Nvidia GeForce20

Маркус БернсСерия GeForce 20 была выпущена в 2018 году и представила миру микроархитектуру Turing.

Примечательно, что эти видеокарты были картами RTX первого поколения, и Nvidia продвигала трассировку лучей в качестве основного преимущества.

Использование тензорных ядер и других усовершенствований помогло этим картам совершить огромный скачок в графическом совершенстве. Результатом является реалистичное освещение и убедительные эффекты отражения в игре.

Однако за улучшения пришлось заплатить: RTX 2080 Ti продавалась по невероятной цене 1199 долларов (по сравнению с 699 долларов за 1080 Ti).

Nvidia GeForce30 серии

Pocket-lintСерия GeForce30 пришла на смену серии 20 в 2020 году и, к сожалению, стала наиболее известной из-за того, что ее было просто невозможно достать из-за нехватки силикона.

Тем не менее, Nvidia RTX 3080 должна была продаваться по цене 699 долларов, что делало ее намного более доступной, чем флагманы предыдущих поколений, и серия также получила значительные улучшения.

Флагманская видеокарта GeForce RTX 3090 Ti, анонсированная в марте 2022 года, содержит 10 752 ядра CUDA, 78 RT-TFLOP, 40 Shader-TFLOP и 320 Tensor-TFLOP мощности. Этот мощный зверь также был отмечен как энергоемкий, требующий не менее 850 Вт мощности, а это означает, что для его работы вам, вероятно, понадобится блок питания мощностью 1000 Вт.

Nvidia GeForce 40-й серии

NvidiaNvidia постоянно пытается раздвинуть границы с каждой итерацией. С RTX 40-й серии один пользователь доказал, что можно запускать игры с разрешением 13K.

Это была первая серия графических процессоров, в которой использовался разъем 12VHPWR, что приводило к некоторым проблемам, но в остальном в основном имело восторженные отзывы.

Она готовилась в несколько этапов: студенты групп Нт-305оСР, Нт-102оПКМ, Нт-201оПКМ в течение марта и апреля под руководством канд. ист. наук, доцента Н. А. Тарасовой и канд. пед. наук, доцента, Т. Ю. Основиной активно отрабатывали методы арт-терапии, используя приемы ассоциации.

Она готовилась в несколько этапов: студенты групп Нт-305оСР, Нт-102оПКМ, Нт-201оПКМ в течение марта и апреля под руководством канд. ист. наук, доцента Н. А. Тарасовой и канд. пед. наук, доцента, Т. Ю. Основиной активно отрабатывали методы арт-терапии, используя приемы ассоциации. 04.2023

04.2023

), а также города Могилев (Беларусь). Среди участников конференции – член-корреспондент Российской академии наук, 5 докторов наук, 54 кандидата наук, 55 музейных сотрудников, 9 библиотекарей, 5 архивистов, 17 педагогов, 23 краеведа, 24 школьника, 6 студентов.

), а также города Могилев (Беларусь). Среди участников конференции – член-корреспондент Российской академии наук, 5 докторов наук, 54 кандидата наук, 55 музейных сотрудников, 9 библиотекарей, 5 архивистов, 17 педагогов, 23 краеведа, 24 школьника, 6 студентов. Компетенция «Социальная работа». Что вы делаете для других, чтобы изменить мир?

Компетенция «Социальная работа». Что вы делаете для других, чтобы изменить мир? 04.2023

04.2023

Примеры включают Google, Amazon, Facebook и даже Tesla.

Примеры включают Google, Amazon, Facebook и даже Tesla. Самая ранняя причина выхода из строя графического процессора — это производственный брак, когда компоненты печатной платы ослаблены или целостность печатной платы уже нарушена. Вы можете заставить графический процессор выйти из строя раньше, разогнав его сверх допустимых уровней, что создаст нагрузку на систему. Графический процессор также может быть поврежден во время установки, если статический заряд накапливается и переносится на карту. Наконец, если установленный вами графический процессор несовместим с другими компонентами, это может привести к повреждению графического процессора, хотя часто он просто не будет работать с самого начала.

Самая ранняя причина выхода из строя графического процессора — это производственный брак, когда компоненты печатной платы ослаблены или целостность печатной платы уже нарушена. Вы можете заставить графический процессор выйти из строя раньше, разогнав его сверх допустимых уровней, что создаст нагрузку на систему. Графический процессор также может быть поврежден во время установки, если статический заряд накапливается и переносится на карту. Наконец, если установленный вами графический процессор несовместим с другими компонентами, это может привести к повреждению графического процессора, хотя часто он просто не будет работать с самого начала.