10 основных причин, по которым страница сайта может не находиться в индексе поисковых систем Яндекс или Google

Причина номер 1. Новая страница или новый сайт

Первая причина, это то, что поисковые роботы еще просто не нашли новую страницу вашего сайта. В зависимости от того, какой ваш сайт, переобход страниц может занимать от нескольких минут до нескольких недель.

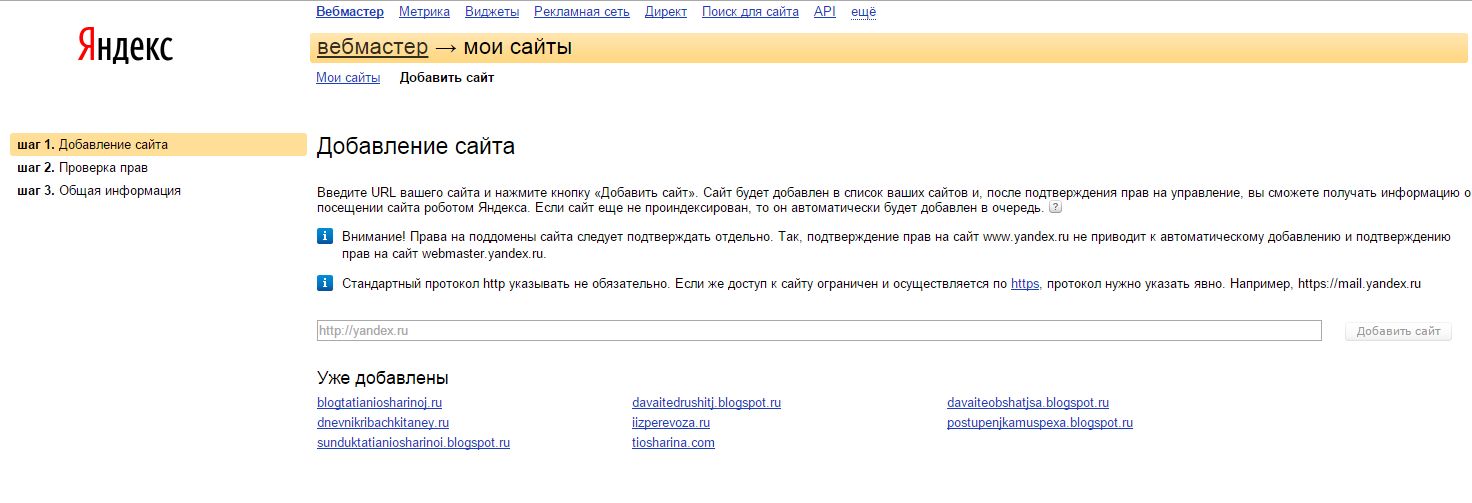

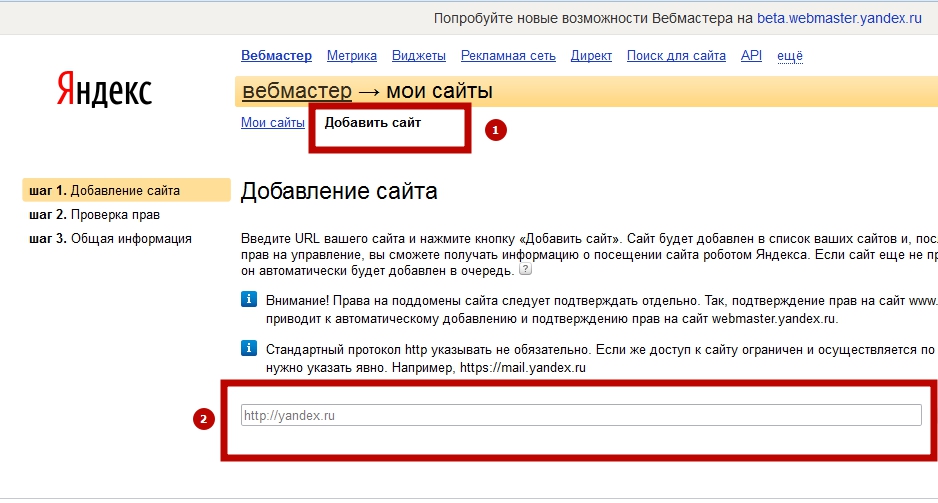

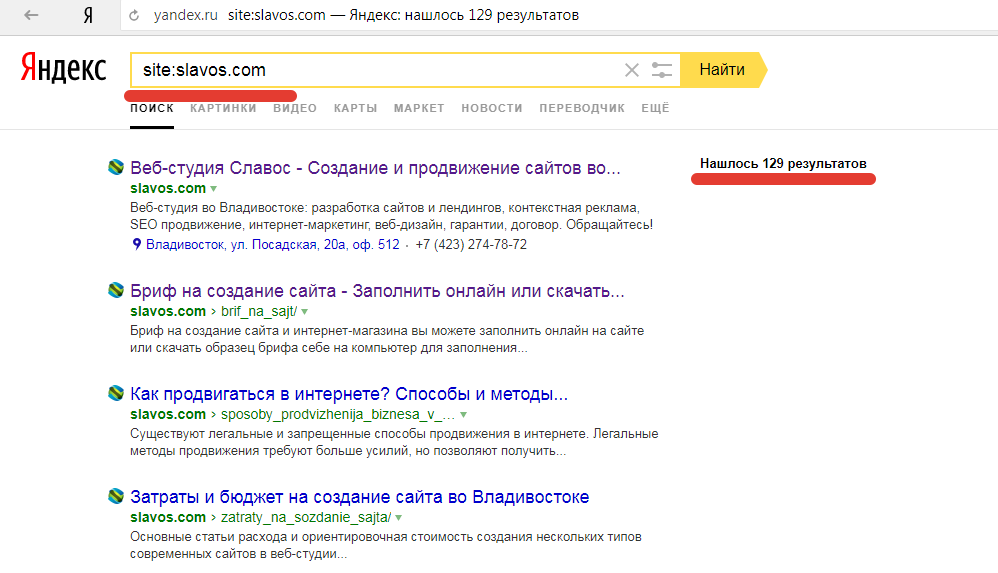

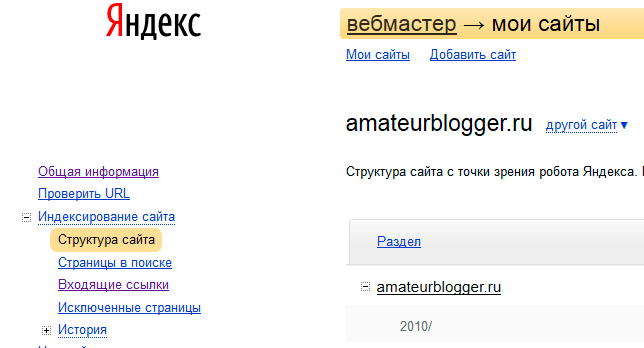

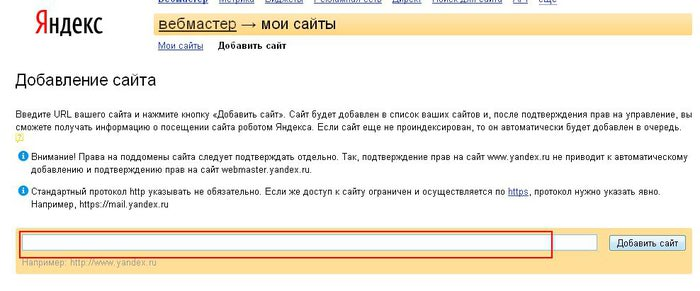

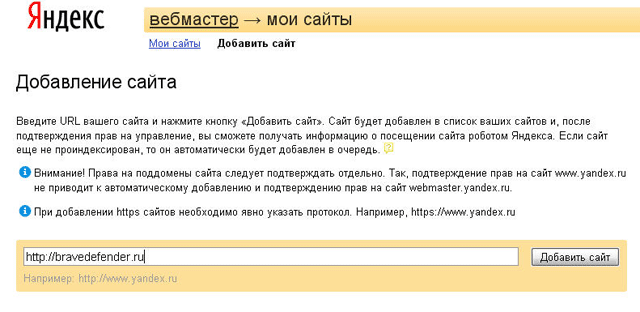

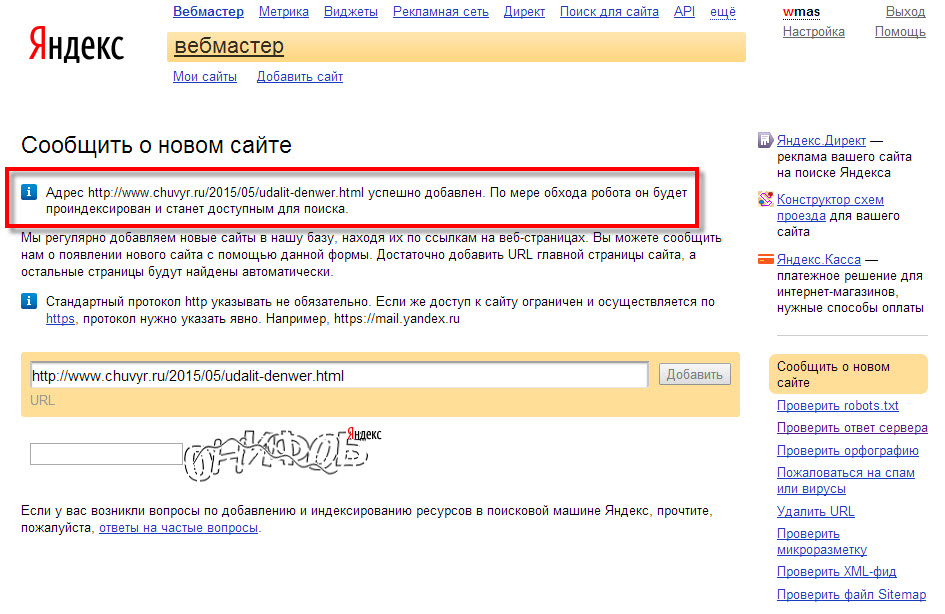

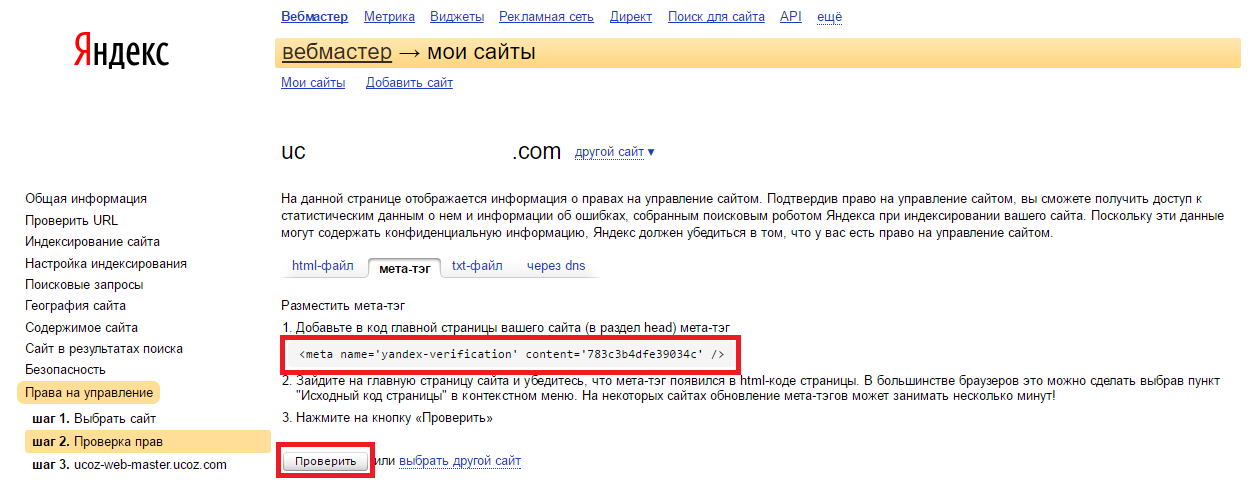

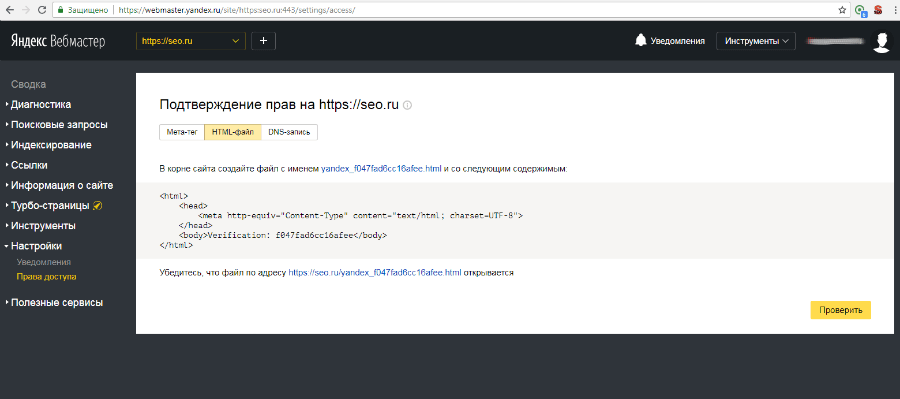

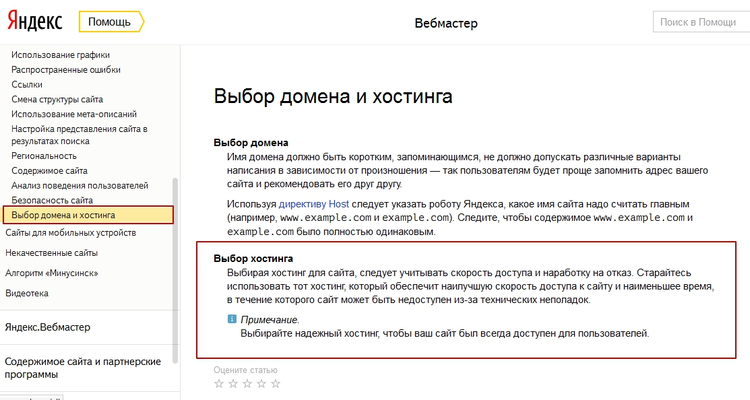

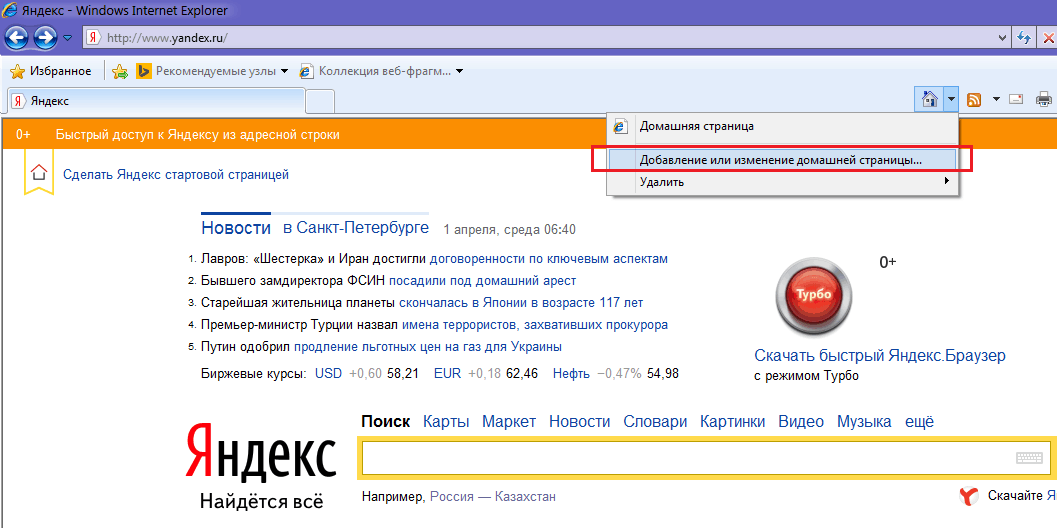

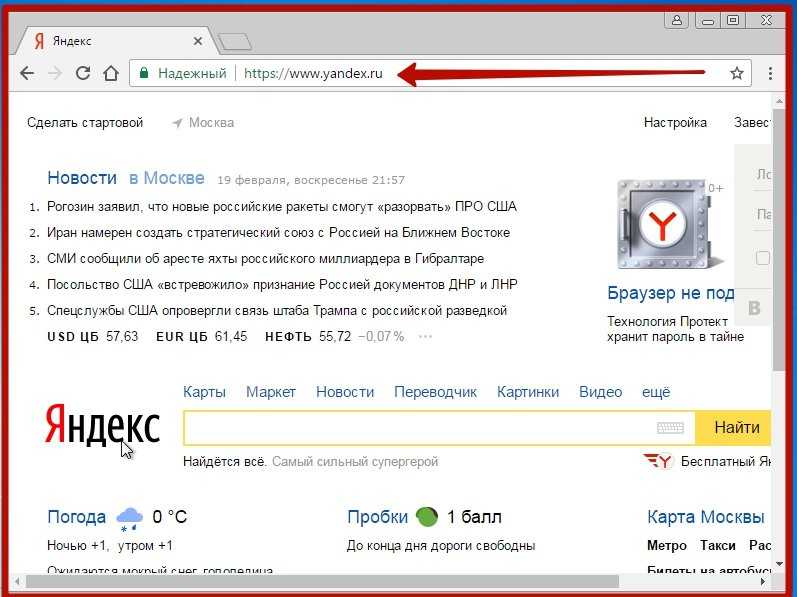

Чтобы узнать, находится ли в индексе страница Вам необходимо воспользоваться сервисами вебмастера Яндекс или Google Search Console.

В Яндекс.Вебмастере это раздел «Индексирование» — «Проверить статус URL». Если робот обошел и проиндексировал страницу, вы увидите уведомление «Страница обходится роботом и находится в поиске».

Если робот о странице еще не знает, вы увидите сообщение «Страница неизвестна роботу».

В новой версии Google Search Console вам нужен инструмент «Проверка URL». Если робот обошел и проиндексировал страницу, вы увидите уведомление «URL есть в индексе Google».

Если робот на странице еще не был, вы увидите сообщение «URL нет в индексе Google».

Причина номер 2. Страница или сайт закрыты от индексации в файле robots.txt

Существует специальный файл robots.txt, который позволяет указать роботам на то, какие страницы сайта должны быть в индексе поисковых систем, а какие страницы не должны быть включены.

Соответственно, если в файле прописаны запрещающие правила, в индексе поисковых систем данную страницу вы не найдете.

Как проверить, закрыта ли страница в robots. txt?

txt?

В Яндекс.Вебмастере: заходим в «Инструменты — Анализ файла robots.txt». В окно «Разрешены ли URL» вносим адреса страниц, которые мы хотим проверить. После того, как мы нажмем на кнопку «Проверить», внизу появится список введенных адресов и их статус: разрешены они для индексации или нет. Если нет, будет указано, какое из правил запрещает обход для робота.

В Google похожий инструмент находится на вкладке «Сканирование — Инструмент проверки файла robots.txt».

Важно! На данный момент эта вкладка находится в старой версии вебмастера!

Причина номер 3. Указан запрет в User-Agent

Указан запрет в User-Agent

У поисковых систем есть свои требования к тому, как должен строиться файл robots.txt. И начинается он с приветствия. Приветствие может быть обращено к роботу яндекс, либо гугл, либо к обеим поисковым системам.

Часто для Яндекс и Google делают отдельные секции в файле robots.txt. А потом забывают вносить правки в эти секции. Из-за этого роботы потом некорректно начинают индексировать сайт.

Проверяем наличие проблемы также, как и в предыдущем случае. Главное — это делать в вебмастере Яндекс, и в вебмастере Google.

Причина номер 4. Запрет на индексацию страниц указан в мета-теге robots.

Суть этого мета-тега такая же, как и у файла robots.txt, только если страница закрыта в robots.txt она все равно может быть проиндексирована поисковыми системами. Но если на странице используется noindex или none, страница не будет добавлена в индекс.

1. Проверить использование данного мета-тега на странице можно в коде (сочетание клавиш Ctrl+U)

2. С помощью дополнения для браузера, например seo meta

3. С помощью вебмастеров.

Причина номер 5. Некорректно настроенный атрибут rel=canonical.

Каноникал — это еще один атрибут, помогающий управлять индексацией страниц.

Если rel каноникал настроен на другую страницу, то вы говорите поисковому роботу о том, что она схожа с другой станицей и первую страницу не нужно добавлять в индекс поисковых систем.

Проверить использование данного атрибута можно также в исходном коде, с помощью дополнения для браузера — rds бар или seo meta.

Также это можно увидеть в вебмастере Яндекс («Страницы в поиске»- «Исключенные страницы». Проверять необходимо статус «неканонические»).

Причина номер 6. Проблемы с ответом сервера

Для того, чтобы страница индексировалась, ее код ответа сервера должен быть 200 ОК. Если страница отдает ответ сервера 404 или 301, в индекс поисковых систем данная страница не попадет.

Проверять код ответа лучше всего с помощью вебмастеров, они показывают наиболее точные данные.

Причина номер 7. Проблемы с хостингом или сервером

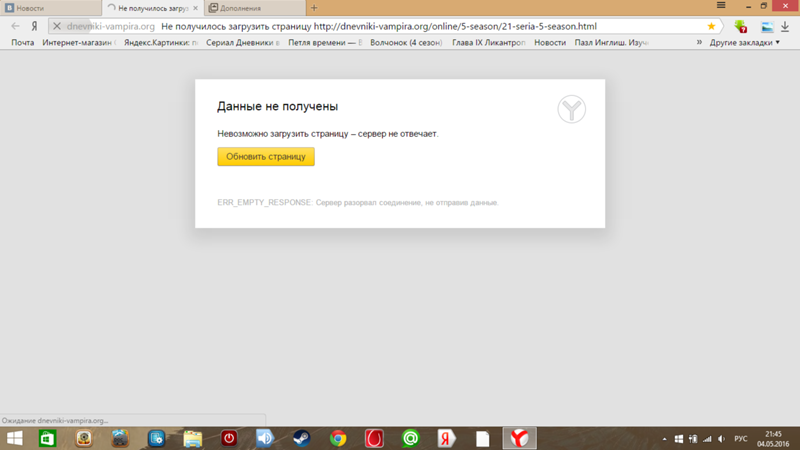

Представьте, вы приходите в магазин, а он не работает. Потом снова приходите в магазин, но он все равно не работает. Какова вероятность того, что вы вернетесь туда? Вероятнее всего очень маленькая.

Тоже самое происходит и с поисковыми системами. Если он приходит на ваш сайт, а он не работает, то робот просто исключает страницы из индекса и не показывает их пользователям.

Правильно, зачем пользователей приводить на неработающий сайт.

Для того, чтобы отследить есть ли проблема, необходимо в вебмастерах проверять статус страниц. Если встречаются ошибки сервера 5хх (500, 503), а также если вам приходят уведомления из Яндекс.Метрики о том, что сайт не работает, необходимо решать данную проблему.

Если встречаются ошибки сервера 5хх (500, 503), а также если вам приходят уведомления из Яндекс.Метрики о том, что сайт не работает, необходимо решать данную проблему.

Причина номер 8. Проблемы со скоростью загрузки страниц

Скорость загрузки — важный показатель качества современного сайта. Если ваши страницы долго долго загружаются, роботы поисковых систем исключать такие страницы из индекса.

Кроме того, скорость загрузки страниц — является фактором ранжирования в поисковых системах. Поэтому, если у вас с этим есть проблемы, срочно это исправляйте!

Как проверить? Начните с инструмента PageSpeed Insights от Google. Дополнительно можете использовать сервисы Google Аналитика и Яндекс.Метрика.

Совет! Важно проверять скорость загрузки для нескольких типов страниц и не останавливаться выполнив только одну проверку, т.е. выполнять данные работы периодически.

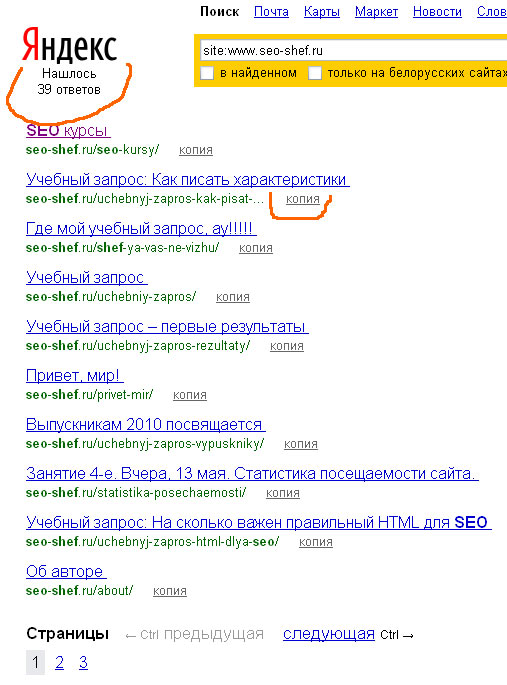

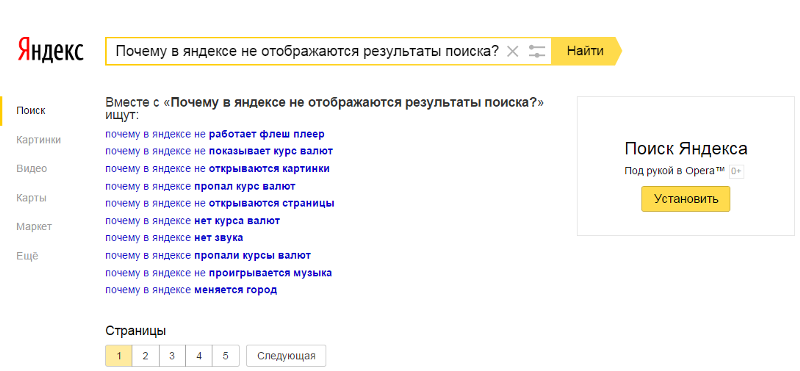

Причина номер 9. Проблема с уникальностью и полезностью контента

Поисковики уделяют большое внимание качеству контента, поэтому, если на странице расположен не полезный контент, либо же дублирующийся с другими страницами, такие страницы не добавляются в индекс поисковых систем.

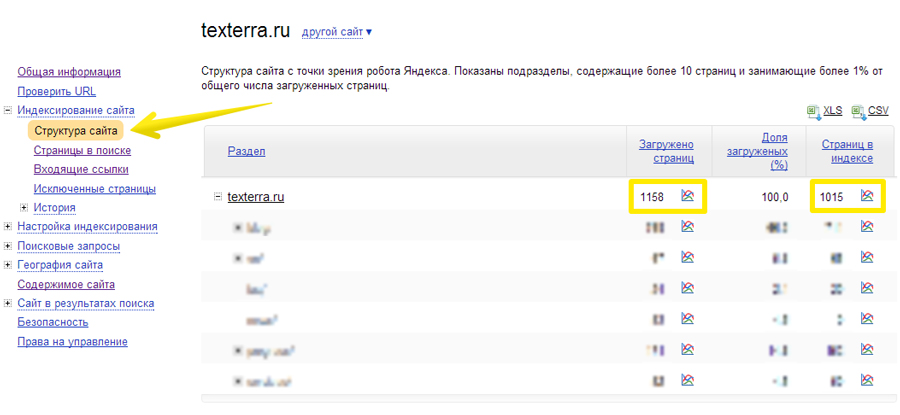

Как проверить, есть ли на сайте такие страницы — нужно зайти в вебмастер.

В Яндексе — это отчет «Страницы в поиске» — «Исключенные страницы». Проверять нужно статусы «Дубль» и «Недостаточно качественная».

В Google Search Console — это отчет «Покрытие» — «Страница является копией. Канонический вариант не выбран пользователем».

Канонический вариант не выбран пользователем».

Причина номер 10. Проблемы с AJAX

Если ваш сайт выполнен на технологии AJAX очень важно правильно выполнить требования поисковых систем, для того чтобы поисковые роботы смогли проиндексировать страницы вашего сайта.

Таким образом для каждой отдельной страницы должна быть своя HTML-версия.

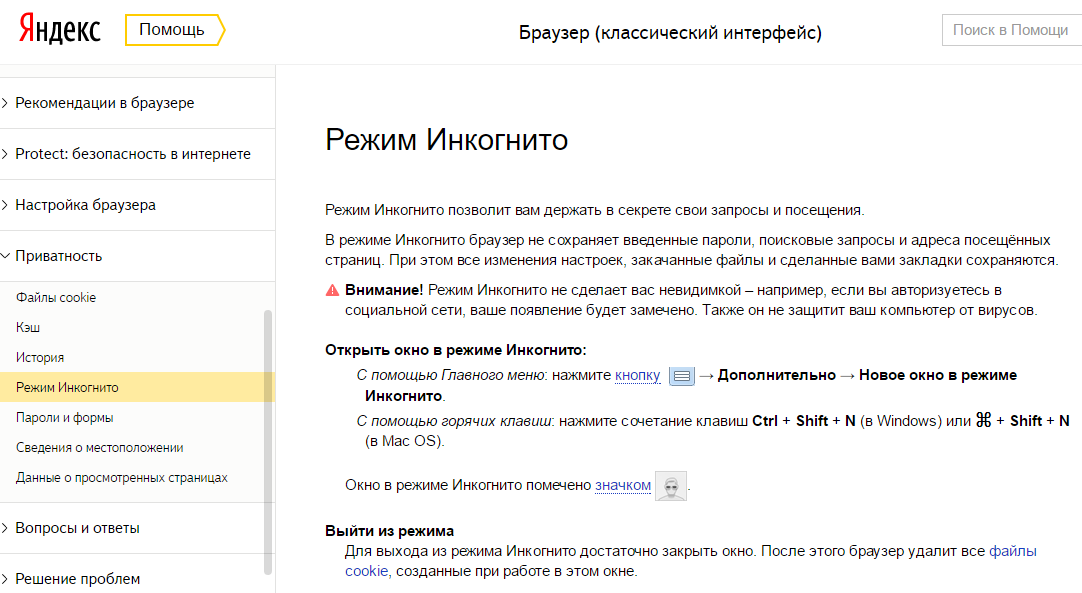

И напоследок, дадим вам несколько советов, как ускорить индексацию:

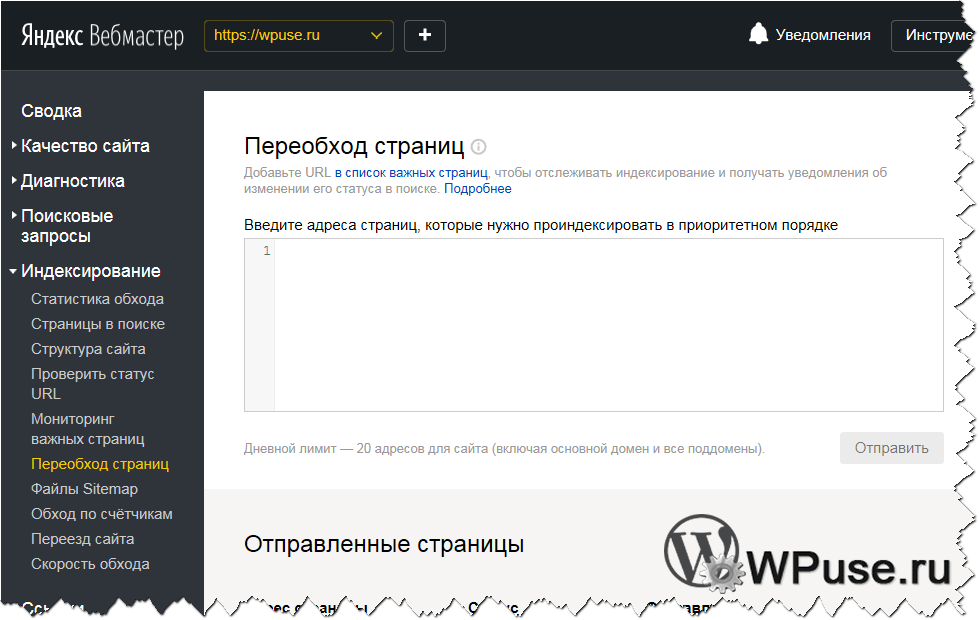

- отправляйте страницы на переобход с помощью вебмастеров

- используйте файл sitemap.xml

- используйте новейшие возможности, которые предоставляют вам поисковики. Например, Яндекс Метрике появилась возможность связать Яндекс Вебмастер и Яндекс Метрику, для того чтобы отправлять страницы на переиндексацию.

Также смотрите наш видеоролик https://youtu.be/HF-2dd4luQY с помощью которого вы сможете найти ошибки у себя на сайте и запланировать работы по их исправлению.

Если вы хотите продвинуть свой сайт в ТОП поисковой выдачи, тогда записывайтесь на курс по SEO-продвижению

|

|

Статью подготовила

Полина Зарубицкая, ведущий спикер Webcom Academy. |

Поделиться с друзьями:

10 основных причин, по которым страница сайта может не находиться в индексе поисковых систем Яндекс или Google

Опубликовано StudioRC в

Причина номер 1. Новая страница или новый сайт

Первая причина, это то, что поисковые роботы еще просто не нашли новую страницу вашего сайта. В зависимости от того, какой ваш сайт, переобход страниц может занимать от нескольких минут до нескольких недель.

Чтобы узнать, находится ли в индексе страница Вам необходимо воспользоваться сервисами вебмастера Яндекс или Google Search Console.

В Яндекс.Вебмастере это раздел «Индексирование» — «Проверить статус URL». Если робот обошел и проиндексировал страницу, вы увидите уведомление «Страница обходится роботом и находится в поиске».

Если робот о странице еще не знает, вы увидите сообщение «Страница неизвестна роботу».

В новой версии Google Search Console вам нужен инструмент «Проверка URL». Если робот обошел и проиндексировал страницу, вы увидите уведомление «URL есть в индексе Google».

Если робот на странице еще не был, вы увидите сообщение «URL нет в индексе Google».

Причина номер 2. Страница или сайт закрыты от индексации в файле robots.txt

Существует специальный файл robots.txt, который позволяет указать роботам на то, какие страницы сайта должны быть в индексе поисковых систем, а какие страницы не должны быть включены.

Соответственно, если в файле прописаны запрещающие правила, в индексе поисковых систем данную страницу вы не найдете.

Как проверить, закрыта ли страница в robots.txt?

В Яндекс.Вебмастере: заходим в «Инструменты — Анализ файла robots.txt». В окно «Разрешены ли URL» вносим адреса страниц, которые мы хотим проверить. После того, как мы нажмем на кнопку «Проверить», внизу появится список введенных адресов и их статус: разрешены они для индексации или нет. Если нет, будет указано, какое из правил запрещает обход для робота.

В Google похожий инструмент находится на вкладке «Сканирование — Инструмент проверки файла robots.txt».

Важно! На данный момент эта вкладка находится в старой версии вебмастера!

Причина номер 3. Указан запрет в User-Agent

У поисковых систем есть свои требования к тому, как должен строиться файл robots.txt. И начинается он с приветствия. Приветствие может быть обращено к роботу яндекс, либо гугл, либо к обеим поисковым системам.

Часто для Яндекс и Google делают отдельные секции в файле robots.txt. А потом забывают вносить правки в эти секции. Из-за этого роботы потом некорректно начинают индексировать сайт.

Проверяем наличие проблемы также, как и в предыдущем случае. Главное — это делать в вебмастере Яндекс, и в вебмастере Google.

Причина номер 4. Запрет на индексацию страниц указан в мета-теге robots.

Суть этого мета-тега такая же, как и у файла robots.txt, только если страница закрыта в robots.txt она все равно может быть проиндексирована поисковыми системами. Но если на странице используется noindex или none, страница не будет добавлена в индекс.

1. Проверить использование данного мета-тега на странице можно в коде (сочетание клавиш Ctrl+U)

2. С помощью дополнения для браузера, например seo meta

3. С помощью вебмастеров.

Причина номер 5. Некорректно настроенный атрибут rel=canonical.

Некорректно настроенный атрибут rel=canonical.

Каноникал — это еще один атрибут, помогающий управлять индексацией страниц.

Если rel каноникал настроен на другую страницу, то вы говорите поисковому роботу о том, что она схожа с другой станицей и первую страницу не нужно добавлять в индекс поисковых систем.

Проверить использование данного атрибута можно также в исходном коде, с помощью дополнения для браузера — rds бар или seo meta.

Также это можно увидеть в вебмастере Яндекс («Страницы в поиске»- «Исключенные страницы». Проверять необходимо статус «неканонические»).

Причина номер 6. Проблемы с ответом сервера

Для того, чтобы страница индексировалась, ее код ответа сервера должен быть 200 ОК. Если страница отдает ответ сервера 404 или 301, в индекс поисковых систем данная страница не попадет.

Проверять код ответа лучше всего с помощью вебмастеров, они показывают наиболее точные данные. А вот визуальной проверкой лучше не ограничиваться, так как бывают случаи, когда страницы выглядят корректно, но код ответа сервера не 200.

А вот визуальной проверкой лучше не ограничиваться, так как бывают случаи, когда страницы выглядят корректно, но код ответа сервера не 200.

Причина номер 7. Проблемы с хостингом или сервером

Представьте, вы приходите в магазин, а он не работает. Потом снова приходите в магазин, но он все равно не работает. Какова вероятность того, что вы вернетесь туда? Вероятнее всего очень маленькая.

Тоже самое происходит и с поисковыми системами. Если он приходит на ваш сайт, а он не работает, то робот просто исключает страницы из индекса и не показывает их пользователям.

Правильно, зачем пользователей приводить на неработающий сайт.

Для того, чтобы отследить есть ли проблема, необходимо в вебмастерах проверять статус страниц. Если встречаются ошибки сервера 5хх (500, 503), а также если вам приходят уведомления из Яндекс.Метрики о том, что сайт не работает, необходимо решать данную проблему.

Причина номер 8. Проблемы со скоростью загрузки страниц

Проблемы со скоростью загрузки страниц

Скорость загрузки — важный показатель качества современного сайта. Если ваши страницы долго долго загружаются, роботы поисковых систем исключать такие страницы из индекса.

Кроме того, скорость загрузки страниц — является фактором ранжирования в поисковых системах. Поэтому, если у вас с этим есть проблемы, срочно это исправляйте!

Как проверить? Начните с инструмента PageSpeed Insights от Google. Дополнительно можете использовать сервисы Google Аналитика и Яндекс.Метрика.

Совет! Важно проверять скорость загрузки для нескольких типов страниц и не останавливаться выполнив только одну проверку, т.е. выполнять данные работы периодически.

Причина номер 9. Проблема с уникальностью и полезностью контента

Поисковики уделяют большое внимание качеству контента, поэтому, если на странице расположен не полезный контент, либо же дублирующийся с другими страницами, такие страницы не добавляются в индекс поисковых систем.

Как проверить, есть ли на сайте такие страницы — нужно зайти в вебмастер.

В Яндексе — это отчет «Страницы в поиске» — «Исключенные страницы». Проверять нужно статусы «Дубль» и «Недостаточно качественная».

В Google Search Console — это отчет «Покрытие» — «Страница является копией. Канонический вариант не выбран пользователем».

Причина номер 10. Проблемы с AJAX

Если ваш сайт выполнен на технологии AJAX очень важно правильно выполнить требования поисковых систем, для того чтобы поисковые роботы смогли проиндексировать страницы вашего сайта.

Таким образом для каждой отдельной страницы должна быть своя HTML-версия.

И напоследок, дадим вам несколько советов, как ускорить индексацию:

- отправляйте страницы на переобход с помощью вебмастеров

- используйте файл sitemap.xml

- используйте новейшие возможности, которые предоставляют вам поисковики.

Например, Яндекс Метрике появилась возможность связать Яндекс Вебмастер и Яндекс Метрику, для того чтобы отправлять страницы на переиндексацию.

Например, Яндекс Метрике появилась возможность связать Яндекс Вебмастер и Яндекс Метрику, для того чтобы отправлять страницы на переиндексацию.

Диагностика сайта в Яндекс Вебмастер

Вкратце о диагностике сайта

Фатальные

- Сайт закрыт к индексации в файле robots.txt

- Не удалось подключиться к серверу из-за ошибки DNS

- Главная страница сайта возвращает ошибку

- Обнаружены нарушения или проблемы с безопасностью

Критичные

- Долгий ответ сервера

- Большое количество неработающих внутренних ссылок

Возможные проблемы

- Главная страница перенаправляет на другой сайт

- Отсутствуют теги <title>

- Ошибки в файле robots.txt

- Не найден файл robots.txt

- Отсутствуют мета-теги <description>

- Некорректное отображение несуществующих файлов и страниц

- В файле robots.txt задана противоречивая директива Host

- В файле robots.

txt не задана директива Host

txt не задана директива Host - Большое количество страниц-дублей

- Нет используемых роботом файлов Sitemap

- Обнаружены ошибки в файлах Sitemap

- Файлы Sitemap давно не обновлялись

Рекомендации

- Не задана региональная принадлежность сайта

- Сайт не оптимизирован для мобильных устройств

- Ошибка счётчика Яндекс.Метрики

- Сайт не зарегистрирован в Яндекс.Справочнике

- Отсутствует файл favicon на сайте

- Отсутствуют быстрые ссылки

Вкратце о диагностике сайта

В этой статье мы подробно опишем большинство самых популярных проблем, которые выдает диагностика сайта от Яндекса. Напомним, что раздел диагностики находится в Yandex Webmaster на второй вкладке в левом меню.

Краткую информацию о наличии проблем возможно найти в левом верхнем блоке на главной странице Вебмастера.

Прежде, чем рассказывать о каждой проблеме отдельно, поясним общую информацию. Яндекс разделил все ошибки на 4 вида:

Яндекс разделил все ошибки на 4 вида:

Фатальные — то есть, те, которые несовместимы с отображением сайта в поисковой выдаче. Наличие таких ошибок, скорее всего, приведет к полному исключению сайта из поиска. Среди них — запрет индексации, различного рода санкции со стороны поисковиков, серьезное нарушение безопасности или неработоспособность сайта;

Критичные — то есть, те, которые серьезно затрудняют удобство пользования сайтом, его корректную работу или индексацию. Наличие таких ошибок вряд ли приведет к исключению ресурса из поисковой выдачи, но может сильно снизить видимость;

Возможные — то есть, те, которые влияют на удобство пользователей, отображение и корректную индексацию. Подобные ошибки стоит устранить для улучшения сайта и повышения видимости в органической выдаче. В общем списке сайтов Вебмастера возможные проблемы обозначаются серым восклицательным знаком.

Рекомендации — носят исключительно рекомендательный характер.

Обычно направлены на улучшение сайта или отображения.

Обычно направлены на улучшение сайта или отображения.

Фатальные проблемы

Решать фатальные проблемы нужно немедленно, иначе они приведут к исключению сайта из поисковой выдачи. Подобные ошибки справедливы не только для Яндекса, но и для всех остальных поисковых систем. Ниже мы опишем каждую из них в отдельности, а так же предложим варианты решения.

Сайт закрыт к индексации в файле robots.txt

«При последнем обращении к файлу robots.txt было обнаружено, что сайт закрыт для индексации. Убедитесь в корректности файла robots.txt, иначе сайт может полностью пропасть из поиска.» © Яндекс Вебмастер

Очень серьезная, но легко решаемая проблема. Причиной ее появления может стать банальная ошибка в синтаксисе файла robots.txt или ненамеренный запрет индексации. Зачастую такую ошибку можно увидеть у новых сайтов, так как разработчики обычно закрывают ресурс для индексации и не всега открывают обратно.

Поправить это очень просто. Открываем свой robots.txt по ссылке ваш_домен/robots.txt и проверяем содержимое. Если в нем расположен код следующего содержания:

User-agent: *

Disallow: /

или

User-agent: Yandex

Disallow: /

То, просто заменяем его на шаблонные инструкции для Вашей CMS или прописываем уникальные вручную.

Подробнее о настройке файла robots.txt

Не удалось подключиться к серверу из-за ошибки DNS

«При попытке скачать данные с сайта не удалось подключиться к серверу из-за ошибки DNS. Если роботы не смогут получить доступ к серверу, сайт может полностью пропасть из поиска. Возможно, пользователи также не могут попасть на сайт.» © Яндекс Вебмастер

Данная проблема решается уже не так быстро, как предыдущая. Суть ее проста. Индексирующий робот Яндекса попросту не смог получить доступ к сайту. То есть, корректная индексация уже невозможна. Если краулер, при повторных обращениях, будет продолжать получать ошибку, то сайт рано или поздно исключат из поиска.

То есть, корректная индексация уже невозможна. Если краулер, при повторных обращениях, будет продолжать получать ошибку, то сайт рано или поздно исключат из поиска.

В данном конкретном случае, лучше всего будет обратиться к разработчикам сайта или хост-провайдеру (регистратору доменного имени.) Если Вы не профессионал, то можете потерять много драгоценного времени в попытках разобраться в произошедшем. Помните, что фатальные ошибки нужно решать незамедлительно.

Главная страница сайта возвращает ошибку

«При обращении к главной странице сайта не удалось получить HTTP-код 200 OK. Поскольку страница недоступна для робота, она может быть исключена из результатов поиска.» © Яндекс Вебмастер

При обращении к главной странице сайта робот ожидает ответ 200 ОК. Только при его получении продолжается корректная индексация.

Если Вы столкнулись с вышеупомянутой проблемой, то вот несколько причин ее появления.

Неверно настроен ответ главной страницы. К примеру, главная может отдавать 404 Not Found или 403. Что для нее не корректно. Определить ответ можно в Яндекс Вебмастере, при помощи инструмента «проверка ответа сервера«;

Для главной страницы может быть настроен 301 редирект;

Главная страница сайта может технически отсутствовать, что редкость.

Решается проблема путем проверки наличия страницы и ее ответа. Для разработчиков сайта устранить данную ошибку не составит никакого труда.

Обнаружены нарушения или проблемы с безопасностью

«Сайт может угрожать безопасности пользователя, или на нём были обнаружены нарушения правил поисковой системы. Наличие этой проблемы негативно сказывается на положении сайта в результатах поиска.» © Яндекс Вебмастер

Одна из самых сложно решаемых проблем. Причин ее появления может быть множество. Вот основные из них:

Причин ее появления может быть множество. Вот основные из них:

Сайт был взломан и на нем находится вредоносный код. Это может быть вирусный рекламный баннер, вставки iframe, различного рода трояны, а так же множество другой гадости;

Сбор, обработка или передача данных пользователей сделана насколько некорректно, что индексирующий робот заподозрил в этом мошеннические намерения;

Сайт не соответствует правилам поисковой системы. То есть, имеет запрещенный контент, обманывает или вводит в заблуждение пользователей, подменяет материал и т.д.;

Стоит сказать, что данная проблема может появляться у очень молодых сайтов из-за темного прошлого доменного имени. Обязательно проверяйте домен перед покупкой.

Однако, не стоит беспокоиться и переделывать сайт, если Вы уверены в его корректной работе. Подобное сообщение может появляться по ошибке. Если это так, то оно автоматически пропадет через несколько обновлений.

Если это так, то оно автоматически пропадет через несколько обновлений.

Критичные проблемы

На критичные проблемы стоит сразу обратить внимание и начать искать решение. Их появление скорее всего не приведет к исключению из поиска, однако может серьезно повлиять на видимость сайта.

Долгий ответ сервера

«При обращении к серверу среднее время ответа превышает 3 секунды. Долгая загрузка страниц затрудняет работу с сайтом.» © Яндекс Вебмастер

Это одна из основных причин неполной (некорректной) индексации. Робот отводит на каждый сайт определенное количество секунд, после чего переходит к следующем ресурсу. Если ответ сервера слишком долгий, то времени на загрузку страниц может просто не остаться.

Что бы решить эту проблему, необходимо обратиться к администратору сервера или хост-провайдеру. Возможно, Вашему сайту просто не хватает выделенных для работы ресурсов.

Если данное сообщение появилось, а потом пропало без видимых причин, не стоит его игнорировать. Обязательно проверьте скорость ответа сервера, а так же параметры загрузки сайта. Наличие подобной проблемы влияет на индексацию вне зависимости от того, есть сообщение в Вебмастере или его нету.

Обязательно проверьте скорость ответа сервера, а так же параметры загрузки сайта. Наличие подобной проблемы влияет на индексацию вне зависимости от того, есть сообщение в Вебмастере или его нету.

Большое количество неработающих внутренних ссылок

«На сайте не работает значительное число внутренних ссылок. Это может затруднять навигацию пользователям.» © Яндекс Вебмастер

Причиной возникновения подобной проблемы может служить некорректный перенос разделов, страниц или сайта в целом. Так же, к этому может привести сбой в работе каталога, фильтра, пагинации или другого блока связанного со ссылками.

Определить точное количество неработающих ссылок и увидеть детали можно в разделе «Внутренние ссылки» Яндекс Вебмастера.

В этом блоке подробно описываются причины, поэтому Вам останется только устранить проблемы внутри сайта.

Возможные проблемы

Несмотря на название, возможные проблемы все же являются серьезными изъянами с точки зрения SEO. Они не приведут к исключению ресурса из поиска, а так же слабо повлияют на позиции и видимость. Однако их устранение может привести к подъему поискового трафика и более лояльному отношению поисковиков.

Они не приведут к исключению ресурса из поиска, а так же слабо повлияют на позиции и видимость. Однако их устранение может привести к подъему поискового трафика и более лояльному отношению поисковиков.

Главная страница перенаправляет на другой сайт

«При обращении к главной странице робот получает перенаправление на другой сайт, что делает невозможным её индексирование.» © Яндекс Вебмастер

Данную проблему Яндекс относит к разделу «Возможные», однако с нашей точки зрения это серьезная ошибка. Речь сейчас не идет о перенаправлении на зеркала или «склейку». Только редирект на сторонний сайт.

При корректном обращении к главной странице краулер должен получать ответ 200 ОК, что означает, что страница доступна пользователям и ее можно индексировать. В случае получения 301 Redirect, робот не только отправляется на сторонний ресурс, но и получает тревожный сигнал, что сайт мог быть взломан или вводит пользователей в заблуждение. То есть, Вы уже рискуете попасть под фильтры безопасности.

То есть, Вы уже рискуете попасть под фильтры безопасности.

Сразу проверьте ответ сервера, если это будет не 200 ОК — ищите и устраняйте причину. В случае получения 301 Redirect рекомендуем заглянуть в файл .htaccess и проверить его на наличие редиректа.

Отсутствуют теги <title>

«Значительная часть страниц не содержит тег <title>, или он некорректно заполнен. Это может негативно повлиять на представление сайта в результатах поиска.» © Яндекс Вебмастер

Очень серьезное упущение с точки зрения поискового продвижения. Заголовки <title></title> являются одним из основных факторов внутренней оптимизации, которые влияют на ранжирование страницы.

Ранее этому заголовку мы посвятили полноценную статью. В ней разложено по полочкам все, что нужно знать о данном теге с точки зрения SEO.

Безусловно, Яндекс самостоятельно выберет текст для ссылки при построении поисковой выдачи и без сниппета Вы не останетесь, однако Ваша конкурентоспособность с точки зрения SEO сильно упадет.

Ошибки в файле robots.txt

«Файл robots.txt содержит ошибки. Это может привести к некорректному обходу и индексированию сайта.» © Яндекс Вебмастер

Данный файл представляет из себя список инструкций для индексирующего робота. Именно в нем определяется, что нужно загружать в базу, а что игнорировать. Находится он в корневой папке сайта и доступен по адресу www.ваш_домен.ru/robots.txt.

Большинство ошибок в robots.txt, обычно, связаны с синтаксисом прописываемых в нем инструкций. Лишняя точка, слэш или пробел могут привести к некорректному распознанию команды.

Поэтому, при появлении данной проблемы сразу открывайте свой роботс и начинайте проверять синтаксис. В этом деле Вам может помочь сервис «Анализ robots.txt» находящийся во вкладке «Инструменты» Яндекс Вебмастера.

Подробнее об ошибках и настройке файла robots.txt

Не найден файл robots.

txt

txt«Робот не смог получить доступ к файлу robots.txt при последнем обращении. Из-за отсутствия параметров индексирования и инструкций в поиск могут попасть нежелательные страницы.» © Яндекс Вебмастер

Суть проблемы понятна из названия. Что бы решить ее, необходимо просто добавить robots.txt в корневой каталог Вашего сайта. Сделать это можно через FTP или при помощи различного рода плагинов.

Если Вы используете популярную CMS, то мы готовы предложить шаблонные решения. Однако, обратите внимание, что шаблоны инструкций не гарантируют корректность индексации и отсутствие мусора. У каждого сайта будут свои особенности и подводные камни.

Подробнее о настройке файла robots.txt

Отсутствуют мета-теги <description>

«Значительная часть страниц сайта не содержит мета-тег <description>, или он некорректно заполнен. Это может негативно повлиять на представление сайта в результатах поиска. » © Яндекс Вебмастер

» © Яндекс Вебмастер

Это одна из самых распространенных проблем, с которой сталкивается практически каждый SEO специалист. Для ее решения необходимо просто добавить недостающие <description>.

Узнать полный список страниц с отсутствующими тегами Вы можете перейдя по ссылке «Ознакомьтесь» в описании проблемы.

Отсутствие meta тега <description> сильно влияет на корректность отображения сниппетов. Поэтому тянуть с решением проблемы не стоит.

Если подобная ошибка появилась у Интернет-магазина, сайта-каталога или другого крупного ресурса, то для ее решения есть стандартные плагины, которые формируют meta description автоматически. Пользоваться такими плагинами мы советуем в крайнем случае, так как результат работы не всегда удовлетворителен.

Подробнее о description и правилах заполнения

Некорректное отображение несуществующих файлов и страниц

«Вероятно, на сайте некорректно настроен возврат HTTP-кода 404 Not Found, что может негативно сказаться на индексировании сайта роботом. Настройте возврат кода 404 на запрос несуществующих страниц.» © Яндекс Вебмастер

Настройте возврат кода 404 на запрос несуществующих страниц.» © Яндекс Вебмастер

Проще говоря, у Вас попросту отсутствует или некорректно работает страница 404. Что бы разобраться в этом, необходимо перейти на несуществующий раздел. Сделать это можно введя любой некорректный URL, к примеру «ваш_домен.ру/none12345».

Если Вы видите перед собой неизвестную ошибку, белый экран, сообщение хост-провайдера или другую информацию, которая к сайту не относится — у Вас просто нету данной страницы. Шаблон для нее необходимо сделать в CMS сайта. Это напрямую относится к разработке и дизайну сайта, поэтому работы стоит поручить верстальщику.

Если Вы видите оформленную страницу 404 своего сайта, тогда проблема в ответе сервера. Нужно понимать, что надпись «404 — страница не найдена» не означает, что сайт действительно отдает «404 Not Found», скорее всего, результатом будет 200 ОК.

Проверить ответ сервера Вы можете в разделе «Проверка ответов сервера» во вкладке «Инструменты» Яндекс Вебмастера.

Создание страницы 404 Not Found и настройка ответа сервера полностью зависят от конкретного сайта, поэтому сделать пошаговую инструкцию просто невозможно.

Подробнее о странице 404 с точки зрения SEO

В файле robots.txt задана противоречивая директива Host

«В директиве Host указан домен, где аналогичные указания в файле robots.txt отсутствуют. Чтобы указания директивы Host были учтены, идентичные директивы должны присутствовать в файлах robots.txt всех зеркал сайта.» © Яндекс Вебмастер

Суть проблемы в следующем. Есть два зеркала. У обоих есть файл robots.txt, в котором указаны различные параметры инструкции HOST.

Решение очень простое. Необходимо указать во всех HOST одно главное зеркало. Это нужно, что бы у робота не оставалось сомнений, какое из зеркал основное.

Бывает так, что файл robots.txt один и инструкции попросту не могут различаться. В таком случае нужно подождать и сообщение пропадет.

В таком случае нужно подождать и сообщение пропадет.

В файле robots.txt не задана директива Host

«Для корректного определения главного зеркала сайта рекомендуется задать соответствующую директиву Host в файлах robots.txt всех зеркал сайта. В случае ее отсутствия главное зеркало может быть выбрано автоматически.» © Яндекс Вебмастер

Помимо прочих инструкций в файле robots.txt для агента Яндекса необходимо указывать директиву host. Пример директивы приведен на рисунке ниже.

Синтаксис ее крайне прост. Сначала пишется служебное слово «Host:», далее через пробел вставляется главное зеркало сайта. При этом нужно учесть, что протокол http не пишется. Добавляется только https при его наличии. Убедитесь, что зеркало выставленное в Яндекс Вебмастере и других host (у сайтов-зеркал) соответствует указываемому в robots.txt. В противном случае Вы получите ошибку, о которой говорится выше.

Подробнее о директиве host

Большое количество страниц дублей

«На сайте обнаружено большое количество одинаковых страниц, это усложняет индексирование сайта. Проверьте, правильно ли настроены редиректы и корректно ли составлен файл robots.txt.» © Яндекс Вебмастер

Достаточно серьезная проблема, которая для решения, зачастую, требует квалифицированной помощи программиста. Страницы-дубли, по сути, представляют собой различные URL, которые ведут на одну и ту же страницу. (Реже, это несколько абсолютно одинаковых html файлов с разными URL)

Когда индексирующий робот попадает на сайт, он старается обойти все доступные URL адреса и загрузить по ним уникальный контент. Если робот переходит по адресу и «видит» уже загруженную ранее страницу, то он исключает ее из поиска как дубликат, при этом теряя драгоценное время обхода.

Определить наличие дублей возможно в Яндекс Вебмастере. Необходимо зайти в раздел «Индексирование» -> «Страницы в поиске» -> «Исключенные страницы». Тут будут представлены все исключенные из поиска разделы, в том числе и по причине дублирования. Для того, что бы долго не искать, можно настроить фильтр по статусу. (нажать на значок воронки рядом с заголовком)

Необходимо зайти в раздел «Индексирование» -> «Страницы в поиске» -> «Исключенные страницы». Тут будут представлены все исключенные из поиска разделы, в том числе и по причине дублирования. Для того, что бы долго не искать, можно настроить фильтр по статусу. (нажать на значок воронки рядом с заголовком)

После того, как все страницы будут отсортированы, Вы сможете увидеть имеющиеся дубликаты, о которых знает Яндекс.

Для решения данной проблемы необходимо, в первую очередь, определить причину появления дублей. Их может быть несколько.

При создании страницы, в CMS генерируется технический адрес, который обычно имеет вид «post=3333&action=edit» или любой другой не ЧПУ. Вы не хотите видеть подобный URL и создаете для страницы человекочитаемый адрес. Таким образом статья становится доступна по 2 адресам. В этом случае необходимо скрыть все технические адреса в robots.txt при помощи маски;

На сайте имеются динамические URL, которые дополняются различными префиксами в зависимости от выбранных параметров, поиска, сортировки и т.

д. Их так же необходимо скрывать при помощи маски в robots или отказаться от динамических URL;

д. Их так же необходимо скрывать при помощи маски в robots или отказаться от динамических URL;Во время настройки рекламы, для получения данных о клиенте и источнике, часто используются дублирующие ссылки с параметрами. Такие URL нужно сразу закрывать в robots.txt во избежание попадания в индекс;

Некоторые системы управления могут отображать страницу по нескольким человекочитаемым URL. К примеру, страница может быть доступна по всем 3-м адресам: «/page1/», «/page1.php», «/page1.html». Исключаются подобные дубли так же при помощи маски.

После того, как дубли будут закрыты для индексации, предупреждение пропадет автоматически. Но, не стоит думать, что это произойдет в первую неделю. Подобное сообщение может держаться месяцами.

Нет используемых роботом файлов Sitemap

«Робот не использует ни одного файла Sitemap. Это может негативно сказаться на скорости индексирования новых страниц сайта. Если корректные файлы Sitemap уже добавлены в очередь на обработку, сообщение автоматически исчезнет с началом их использования.» © Яндекс Вебмастер

Если корректные файлы Sitemap уже добавлены в очередь на обработку, сообщение автоматически исчезнет с началом их использования.» © Яндекс Вебмастер

Это длинное сообщение описывает всего лишь отсутствие sitemap.xml. Что бы поправить ситуацию нужно просто создать данный файл и разместить его в корневом каталоге Вашего сайта. Ранее мы подробно рассказывали, как это сделать.

После создания необходимо зайти в Яндекс Вебмастер -> «Индексирование» — > «Файлы Sitemap» -> «Добавить карту». В этом же разделе возможно отследить корректность индексации и в случае необходимости обновить.

После того, как робот увидит sitemap сообщение о проблеме пропадет автоматически.

Обнаружены ошибки в файлах Sitemap

«В одном или нескольких файлах Sitemap обнаружены ошибки, которые могут повлиять на обработку файлов индексирующим роботом.» © Яндекс Вебмастер

В случае возникновения данной проблемы воспользуйтесь сервисом анализа sitemap. xml, который находится прямо в Яндекс Вебмастере. («Инструменты»-> «Анализ файлов Sitemap»).

xml, который находится прямо в Яндекс Вебмастере. («Инструменты»-> «Анализ файлов Sitemap»).

Если ошибку не удается выявить, проще всего создать новую карту сайта. Как это сделать, подробно описывали ранее.

Если sitemap генерируется при помощи плагинов, обратите внимание на поля, которые находятся в итоговом файле. В отличии от Google, Яндекс не воспринимает инструкцию <image:image> и может сообщать об ошибке.

Файлы Sitemap давно не обновлялись

«В файлах Sitemap не обнаружено никаких изменений с undefined. Проверьте, не нужно ли обновить файлы Sitemap.»© Яндекс Вебмастер

Тут все просто. Необходимо обновить все имеющиеся на сайте файлы sitemap.xml. Причем сделать это нужно корректно. Вот лишь несколько ошибок, которые допускают при обновлении карты сайта.

Даты изменения страниц не соответствуют реальному обновлению страниц. Подобная ошибка происходит в тот момент, когда Вы используете online сервис.

В таком случае все даты изменения могут быть одинаковыми и не соответствовать фактическим. Это заставляет поисковую систему повторно загружать один и тот же материал, что приводит к пустой трате времени;

В таком случае все даты изменения могут быть одинаковыми и не соответствовать фактическим. Это заставляет поисковую систему повторно загружать один и тот же материал, что приводит к пустой трате времени;Все страницы имеют один и тот же приоритет. В таком случае данный параметр sitemap.xml просто перестает иметь какой-либо смысл;

Вероятная частота изменения не соответствует действительной. Не стоит писать, что Ваши страницы обновляются каждый час. Обмануть поисковую систему не удастся и преимущества Вы не получите, но вот возможность корректного указания частоты обновления утратите.

Подробнее о создании sitemap.xml

Рекомендации

Этот раздел носит исключительно информационный характер, однако мы советуем соблюсти все его требования.

Не задана региональная принадлежность сайта

«В разделе «Региональность» регион сайта не задан явно, это может осложнить ранжирование. Если ваш сайт интересен пользователям вне зависимости от региона, выберите в разделе вариант «Нет региона».» © Яндекс Вебмастер

Если ваш сайт интересен пользователям вне зависимости от региона, выберите в разделе вариант «Нет региона».» © Яндекс Вебмастер

У данной проблемы есть две стороны медали. С одной — присвоение региона не является обязательной процедурой и Яндекс сам может определить его. С другой — если регион определен некорректно, то Вы можете получить нерелевантный трафик или же вообще лишиться его.

Поэтому мы настоятельно рекомендуем присваивать регион каждому сайту. Стоит отметить, что есть ряд ресурсов, которые не имеют региональной привязки. В таком случае необходимо сообщить Яндексу, что региона Вы не имеете.

Подробнее о том, как выбрать и присвоить регион.

Сайт не оптимизирован для мобильных

«По результатам работы алгоритма, определяющего, насколько сайт подходит для мобильных устройств, сайт не удалось признать оптимизированным.» © Яндекс Вебмастер

Сегодня эта проблема должна находиться уже среди критичных. Поисковые системы не раз говорили о том, что будут занижать сайты не имеющие мобильной версии. С каждым годом процентное соотношение трафика с мобильных устройств растет, поэтому мобильная адаптация должна быть у всех.

Поисковые системы не раз говорили о том, что будут занижать сайты не имеющие мобильной версии. С каждым годом процентное соотношение трафика с мобильных устройств растет, поэтому мобильная адаптация должна быть у всех.

Насколько корректно Ваш сайт адаптирован под мобильные телефоны и планшеты Вы можете определить с помощью официального сервиса Яндекса — «Проверка мобильных страниц» . Располагается он в разделе «Инструменты» Яндекс Вебмастера.

Ошибка счётчика Яндекс.Метрики

«Яндекс.Метрика помогает отслеживать источники трафика, получать детальную статистику о посещаемости и качестве страниц сайта, а также анализировать видеозаписи действий посетителей.» © Яндекс Вебмастер

Тут все просто. Скорее всего код Яндекс Метрики был установлен некорректно или не на все страницы.

Если Вы зайдете в счетчики и увидите красный значок слева от сайта — данные в Метрику не поступают. Нажмите на него.

Нажмите на него.

Если он не станет зеленым, то просто переустановите счетчик. Для этого нужно:

Перейти в настройки нажав на значок шестеренки в правой части экрана;

Переходим на вкладку «Код счетчика» и копируем его;

Открываем шаблон, который формирует страницы сайта и вставляем в него код;

Переходим в метрику и нажимаем на красный кружок со стрелочкой. Он должен стать зеленым.

В случае, если Вы уверены, что код размещен правильно, но данные так и не поступают — обратитесь в службу поддержки или подробно ознакомьтесь с процессом установки счетчика.

Сайт не зарегистрирован в Яндекс.Справочнике

«Сайт не добавлен в Яндекс.Справочник. Если у вас есть офисы или филиалы, добавьте их в справочник, чтобы улучшить внешний вид сайта в поиске и региональное ранжирование. Если офисов и филиалов нет, явно укажите «Нет региона» в подразделе «Вебмастер» раздела настройки региональности.» © Яндекс Вебмастер

Если офисов и филиалов нет, явно укажите «Нет региона» в подразделе «Вебмастер» раздела настройки региональности.» © Яндекс Вебмастер

С точки зрения SEO, регистрация сайта в Яндекс Справочнике может дополнить сниппет такой полезной информацией, как телефон, адрес и режим работы. По брендовым запросам справа от сниппета начнет появляться карта с адресом и подробной информацией о фирме. Такие сниппеты любят пользователи, поэтому стоить уделить 15 минут на регистрацию.

Зарегистрироваться проще некуда. Это совершенно бесплатно.

Заходим в Яндекс Аккаунт и переходим по ссылке: https://yandex.ru/sprav/add/;

Вводим информацию о компании и нажимаем «Добавить организацию»;

Ожидаем одобрения модераторов. (Обычно проблем с этим не возникает)

После успешной модерации информация появится в выдаче через несколько обновлений.

Отсутствует файл favicon на сайте

«Не найден файл с изображением, которое должно отображаться во вкладке браузера и может быть показано возле названия сайта в поиске.» © Яндекс Вебмастер

Файл favicon.ico это небольшая картинка, которая отображается во вкладке браузера.

Favicon имеет расширение .ico и располагается в корневой папке сайта или шаблона.

Кроме отображения во вкладке, данное изображение присутствует в поисковой выдаче рядом со ссылкой на сайт. Именно поэтому о нем сообщает Яндекс.

Сделать favicon очень просто. Для этого нужно создать рисунок квадратной формы, после чего воспользоваться одним из множество online генераторов. Примеры таких сервисов:

http://pr-cy.ru/favicon/

http://www.favicon.ru

http://www.favicon.by

Множество других.

Скачайте получившийся файл, назовите его favicon.ico и разместите в корневой папке сайта. Несколько раз обновите браузер и Ваше изображение появится во вкладке рядом с доменом. В поисковой выдаче favicon обновится в течение 2-3 недель.

Отсутствуют быстрые ссылки

«В некоторых случаях в результатах поиска возможно отображение быстрых ссылок в сниппете сайта, что улучшает его видимость и количество переходов. Ссылки формируются полностью автоматически, роботы регулярно оценивают возможность показа быстрых ссылок.» © Яндекс Вебмастер

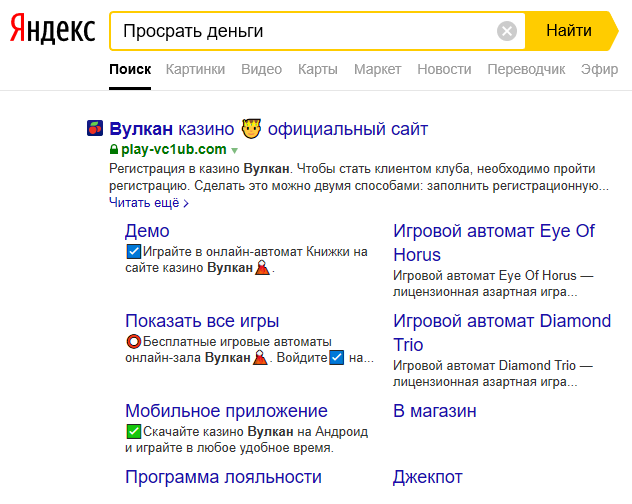

Это исключительно информационное сообщение, так как напрямую повлиять на вывод быстрых ссылок Вы не можете. Напомним, что последние располагаются под основным сниппетом сайта в органической выдаче. На рисунке ниже приведен пример быстрых ссылок для сайта компании Apple.

Но, несмотря на то, что напрямую влияния Вы не имеете, возможно «помочь» роботу определить быстрые ссылки. Делается это путем создания корректной древовидной структуры сайта. То есть, выделить основные разделы, сгруппировать в них подразделы и корректно связать все перелинковкой.

Делается это путем создания корректной древовидной структуры сайта. То есть, выделить основные разделы, сгруппировать в них подразделы и корректно связать все перелинковкой.

В этом случае Яндекс сможет с большей вероятностью определить основные разделы и сформировать блок быстрых ссылок.

Справочник по ошибкам индексирования — веб-мастер. Справка

- Ошибки загрузки

- Ошибки обработки

Список ошибок, которые выдает робот Яндекса, если ему не удается загрузить документ с вашего сайта.

| Ошибка | Описание |

|---|---|

| Соединение прервано при попытке скачать документ. После нескольких попыток загрузка была остановлена. | |

| Превышен предельный размер текста | Документ слишком длинный, попробуйте разбить его на части. |

| Документ заблокирован от индексации в robots.txt | Документ не проиндексирован, поскольку вы или другой администратор заблокировали его от сканирования в robots.txt. |

| Неверный адрес документа | Адрес документа не соответствует стандарту HTTP. |

| Формат документа не поддерживается | Сервер не указывает формат документа или указывает его неправильно, либо указанный формат не поддерживается Яндексом. |

| Ошибка DNS | Ошибка DNS. IP-адрес хоста не может быть определен по его имени. |

| Код состояния HTTP не соответствует стандарту | Сервер возвращает код состояния, не соответствующий стандарту HTTP. |

| Недопустимый HTTP-заголовок | HTTP-заголовок не соответствует стандарту (включая расширение от Яндекса). |

| Не удалось подключиться к серверу | Не удалось подключиться к серверу. |

| Недопустимая длина сообщения | Длина сообщения не указана или указана неверно. |

| Неверная кодировка | Заголовок Transfer-Encoding установлен неправильно или кодировка неизвестна. |

| Неверный объем переданных данных | Длина передаваемых данных не соответствует указанной. Передача данных завершается до или продолжается после получения указанного объема данных. |

| Превышена максимальная длина заголовка HTTP | Превышен предел длины заголовков HTTP. Это может быть вызвано попыткой передать слишком много файлов cookie. |

| Превышена максимальная длина URL-адреса | Длина URL-адреса превышает ограничение. |

Список ошибок, возвращаемых роботами в случае успешной загрузки документа, но невозможности дальнейшей обработки.

| Ошибка | Описание |

|---|---|

Документ содержит метатег noindex | |

| Неверная кодировка | Документ содержит символы, не соответствующие заявленной кодировке. |

| Документ является журналом сервера | Документ распознан как журнал сервера. Если это страница, созданная для посетителей веб-сайта, попробуйте изменить ее так, чтобы она не была похожа на журнал сервера. |

| Недопустимый формат документа | Робот обнаружил, что документ не соответствует заявленному формату (HTML, PDF, DOC, RTF, SWF, XLS, PPT). |

| Кодировка не распознана | Кодировка документа не распознана. Возможно, документ не содержит текста или содержит текст в разных кодировках. |

| Язык не поддерживается | Язык документа не распознан или не поддерживается. Для получения подробной информации обо всех поддерживаемых языках перейдите в соответствующий раздел справки. |

| Документ не содержит текста | Сервер возвращает пустой документ. |

| Слишком много ссылок | Количество ссылок на странице превышает лимит. |

| Ошибка извлечения | Произошла ошибка при распаковке потока данных GZIP или DEFLATE с сервера. |

| Пустой ответ сервера | Сервер вернул ответ нулевой длины. Свяжитесь с администратором хостинг-сервера. |

| Документ неканонический | Элемент link в коде документа содержит атрибут rel , для которого задано значение canonical и он указывает на другой (канонический) документ. Канонический документ был проиндексирован вместо текущего документа. |

Если страницы доступны для робота и отправлены на переиндексацию, но не появляются в поиске более двух недель, заполните форму ниже:

Возможные проблемы — Вебмастер. Справка

В этом разделе собраны решения распространенных проблем категории «Возможные проблемы», которые выявляются при устранении неполадок с сайтом в Яндекс. Вебмастере. Проблемы этой категории могут повлиять на качество и скорость индексации сайта.

Вебмастере. Проблемы этой категории могут повлиять на качество и скорость индексации сайта.

Совет. Настройте уведомления о результатах мониторинга сайта.

- Файл robots.txt не найден

- Обнаружены ошибки в файле robots.txt

- В настоящее время бот-индексатор не использует файлы Sitemap

- Обнаружены ошибки в файлах Sitemap

- Отсутствует элемент title и метатег description

- Страницы имеют одинаковые названия и описания

- Файл favicon недоступен для робота

Робот-индексатор несколько раз запрашивает файл robots.txt раз в сутки и обновляет информацию о нем в своей базе данных. Если робот не может загрузить файл, в Яндекс.Вебмастере появляется предупреждение.

В сервисе проверьте наличие файла robots.txt. Если файл по-прежнему недоступен, добавьте его. Если вы не можете сделать это самостоятельно, обратитесь к своему хостинг-провайдеру или регистратору доменных имен. После добавления файла данные в Яндекс. Вебмастере обновятся в течение нескольких дней.

Вебмастере обновятся в течение нескольких дней.

Проверьте файл robots.txt вашего сайта. Чтобы исправить ошибки, смотрите описания директив.

Файл Sitemap это вспомогательный инструмент для индексации сайта. Позволяет регулярно информировать робота о появлении новых страниц на сайте. Это предупреждение появляется, если робот не использует файлы Sitemap для сайта.

Чтобы робот начал использовать созданный файл, добавьте его в Яндекс.Вебмастер и подождите, пока робот обработает файл. Это может занять до двух недель. После этого предупреждение исчезнет.

Проверьте файл Sitemap вашего сайта. Проверка может обнаружить ошибку «Неизвестный тег». Это означает, что файл содержит элементы, которые не поддерживаются Яндексом. Неподдерживаемые элементы игнорируются роботом при обработке Sitemap, но данные из поддерживаемых элементов все равно учитываются. Вам не нужно изменять содержимое файла. Узнайте больше о поддерживаемых элементах Sitemap.

Элемент заголовка и метатег описания используются для создания хорошего описания сайта в результатах поиска. Дополнительные сведения см. в разделе Отображение названия и описания сайта в результатах поиска.

Дополнительные сведения см. в разделе Отображение названия и описания сайта в результатах поиска.

Если один или оба этих элемента отсутствуют на вашем сайте, добавьте их в HTML-код страниц и сохраните изменения. Если элементы уже добавлены, подождите, пока робот пересканирует страницы. Сообщение об ошибке исчезнет после переиндексации. Узнать больше

Эта проблема возникает, если заголовок или описание дублируются на многих страницах сайта. Элемент заголовка и метатег описания должны быть информативными и привлекательными и отражать содержание страницы. Это поможет пользователям найти результаты поиска, которые они ищут.

Посмотрите примеры страниц с повторяющимися названиями или описаниями, которые Яндекс.Вебмастер обнаружил при обходе сайта роботом. Чтобы их исправить, следуйте рекомендациям для:

Создание титровального элемента.

Создание метатега описания.

Проблема перестанет отображаться, когда робот узнает об изменениях на сайте. Чтобы это произошло быстрее, отправьте наиболее важные страницы на переиндексацию или настройте сканирование страниц с тегом Яндекс.Метрики.

Чтобы это произошло быстрее, отправьте наиболее важные страницы на переиндексацию или настройте сканирование страниц с тегом Яндекс.Метрики.

Если эта проблема отображается для вашего сайта, это означает, что Небольшое изображение отображается во сниппете в результатах поиска Яндекса, рядом с адресом сайта в адресной строке браузера и рядом с названием сайта в Избранном или Закладки в веб-браузере.»}}»> не отображаются в результатах поиска. В Яндекс.Вебмастере перейдите на страницу Устранение неполадок → Диагностика сайта (блок Возможные проблемы) и найдите причину, по которой робот не смог загрузить файл, далее следуйте инструкции:

| Ошибка | Решение |

|---|---|

| Файл отвечает HTTP-кодом, отличным от 200 OK | 7. Проверьте ответ сервера. Ответ должен быть 200 OK. Другие статусы ответов см. в разделе Проверка ответа сервера.|

| Файл перенаправляется на другой URL-адрес | |

| Неверный тип данных | Проверьте значение параметра type в URL-адресе файла. Он должен соответствовать формату файла. |

Как установить фавикон?

Расскажите нам, о чем ваш вопрос, чтобы мы могли направить вас к нужному специалисту:

Ознакомьтесь с рекомендациями. Если файл доступен для робота и может быть загружен в Яндекс.Вебмастере, но проблема все равно возникает, заполните форму:

См. рекомендации выше. Если файл был добавлен более 2 недель назад, но сообщение не исчезает, заполните форму:

См. рекомендации выше. Если ошибок в файле нет, но сообщение все равно появляется, заполните форму:

См. приведенные выше рекомендации. Если ответ сервера соответствует 200 OK и значение параметра type соответствует формату файла, но сообщение не исчезает, заполните форму:

Страницы в результатах поиска — Вебмастер.

Справка

СправкаРезультаты поиска Яндекса регулярно обновляются. Страницы вашего сайта могут появляться в результатах поиска и исчезать из них.

С информацией, представленной в разделе Индексация → Страницы в поиске в Яндекс.Вебмастере, вы можете:

Мониторинг количества страниц в результатах поиска Яндекса и доли страницы А, включенной в поиск Яндекса. Может отсутствовать в результатах поиска, если он дублирует содержимое другой страницы, содержит спам или вирусы, перенаправляет на другой URL-адрес или если на стороне сервера произошла ошибка загрузки.»}}»> и \n

A страница добавлялась в результаты поиска Яндекса, но затем исключалась из них.

\n «}}»> страниц.

Узнать дату последнего обхода робота и обновления результатов поиска.

Узнайте, почему страница была исключена из результатов поиска.

Узнать статус новых страниц сайта.

Даже если страницы были проиндексированы и включены в поиск сразу после публикации, данные в Яндекс.Вебмастере могут обновляться с задержкой. Обычно для появления изменений требуется несколько дней.

Даже если страницы были проиндексированы и включены в поиск сразу после публикации, данные в Яндекс.Вебмастере могут обновляться с задержкой. Обычно для появления изменений требуется несколько дней.

По умолчанию сервис предоставляет данные по сайту в целом. Чтобы просмотреть информацию об определенном разделе, выберите его из списка в поле URL сайта. Доступные разделы отражают известную Яндексу структуру сайта (кроме разделов, добавляемых вручную).

Примечание. Данные доступны с 12 октября 2016 года. Загрузка информации в файл

Информация о страницах представлена следующим образом:

Добавлено и удалено — Соотношение страниц, включенных и исключенных из поиска.

Исключено — Динамика страниц исключенных из поиска.

История — Динамика страниц, включенных в поиск. Каждый сегмент графика соответствует разделу сайта.

Распространение — Количество страниц, включенных в поиск.

Каждый сегмент круговой диаграммы соответствует разделу сайта.

Каждый сегмент круговой диаграммы соответствует разделу сайта.

Общее количество страниц, включенных в поиск, может превышать общее количество страниц на диаграммах (учитываются только страницы и разделы, указанные на странице Структура сайта в Яндекс.Вебмастере).

Яндекс.Вебмастер информирует об изменениях в результатах поиска за последние три месяца:

Дата обновления результатов поиска.

Добавлена ли страница в результаты поиска (URL страницы отображается зеленым цветом) или удалена из них (отображается синим цветом).

Причина, по которой страница была удалена из поиска.

Резкое изменение количества добавленных страниц или участвующих в поиске может быть связано с изменениями на сайте. Например, с изменением структуры сайта или файла robots.txt.

Кроме того, сервис отображает общую информацию о странице:

Дата последнего сканирования роботом.

Путь к странице из корневого каталога сайта.

Заголовок страницы (элемент title).

Чтобы просмотреть изменения, установите параметр Последние изменения. Может отображаться до 50 000 изменений.

Вы можете просмотреть список страниц, включенных в поиск, и следующую информацию о них:

Дата последнего сканирования роботом.

Путь к странице из корневого каталога сайта.

Заголовок страницы (элемент заголовка HTML).

Наличие Турбо-страниц для URL.

Для просмотра списка страниц установите для параметра Все страницы. Список может содержать до 50 000 страниц.

Если в списке нет страниц, которые должны быть включены в результаты поиска, сообщите о них Яндексу с помощью инструмента Переиндексация страниц.

Если в списке есть страницы, которые не должны быть включены в результаты поиска, см. раздел Удаление сайта.

Страницы сайта могут исчезать из результатов поиска. Подробнее о том, почему это может происходить, см. в разделе Почему страницы исключаются из поиска? раздел.

в разделе Почему страницы исключаются из поиска? раздел.

Чтобы просмотреть список исключенных страниц (до 50 000), установите параметр Исключенные страницы в Индексирование → Страницы в поиске. Отображается следующая информация о страницах:

Дата последнего сканирования роботом.

Путь к странице из корневого каталога сайта.

Статус (причина исключения страницы).

Примечание. Наличие и количество исключенных страниц в Яндекс.Вебмастере не влияет на позицию сайта в результатах поиска.

Страница больше не числится исключенной из поиска через некоторое время после выполнения следующих условий:

Страница недоступна для робота-индексатора (HTTP-сервер возвращает 404 Not Found), или установлена переадресация 301 на странице.

Другие ресурсы не ссылаются на исключенную страницу.

Страница, которая удалена с сайта или не существует, может быть найдена в списке исключенных из поиска страниц, вероятно, потому, что на нее ссылаются другие ресурсы. Чтобы удалить страницу из списка, запретите индексацию в файле robots.txt.

Чтобы удалить страницу из списка, запретите индексацию в файле robots.txt.

С помощью фильтров можно быстро найти информацию о странице. Для этого нажмите на значок . Вы можете фильтровать данные по всем доступным параметрам. Например, вы можете использовать фильтрацию URL-адресов:

Соответствует любому из условий (соответствует оператору «ИЛИ»).

Соответствует всем условиям (соответствует оператору «И»).

Введите часть URL-адреса.

Чтобы составить список страниц с определенным текстом в URL-адресе, выберите URL-адрес из списка и введите фрагмент URL-адреса.

Используйте специальные символы.

Можно использовать специальные символы для соответствия началу строки или подстроки, а также задавать более сложные условия с помощью регулярных выражений. Для этого выберите совпадения URL из списка и введите условие в поле. Вы можете добавить несколько условий, поместив каждое из них на новой строке.

Для условий доступны следующие правила:

| Character | Description | Example |

|---|---|---|

| * | Matches any number of any characters | Показать данные для всех страниц, начинающихся с https://example.com/tariff/, включая указанную страницу: Использование символа * Символ * может быть полезен при поиске для URL-адресов, содержащих два или более определенных элемента. Например, вы можете найти новости или объявления за определенный год: |

| @ | Отфильтрованные результаты содержат указанную строку (но не обязательно точно соответствуют ей) | Показать информацию для всех страниц с URL-адресами, содержащими указанную строку: @tariff |

| ~ | Условие является регулярным выражением | Показать данные для страниц с URL-адресами, которые соответствуют регулярному выражению. Например, вы можете отфильтровать все страницы с адресом, содержащим фрагмент Например, вы можете отфильтровать все страницы с адресом, содержащим фрагмент ~стол|диван|кровать , повторяющийся один или несколько раз. |

| ! | Негативное условие | Исключить страницы с URL-адресами, начинающимися с https://example.com/tariff/: !/tariff/* |

При использовании символов не учитывается регистр.

Символы @,!, ~ можно использовать только в начале строки. The following combinations are available:

| Operator | Example |

|---|---|

| !@ | Exclude pages with URLs containing tariff: !tariff |

| !~ | Exclude страницы с URL-адресами, соответствующими регулярному выражению |

Вы можете скачать информацию о страницах в формате XLS или CSV.

Файл может содержать следующие данные:

updateDate — Дата обновления поисковой базы.

url — URL страницы.

httpCode — HTTP-код, полученный роботом во время последнего сканирования.

статус — Статус страницы.

цель — URL-адрес, на который перенаправляется страница, или URL-адрес, отображаемый в результатах поиска.

lastAccess — Дата последнего обхода страницы роботом.

title — Заголовок страницы (содержимое HTML-элемента title).

событие — событие, которое произошло со страницей (независимо от того, включена она в поиск или исключена).

Файл может содержать следующие данные:

url — URL страницы.

lastAccess — Дата последнего обхода страницы роботом.

title — Заголовок страницы (элемент заголовка HTML).

Файл может содержать следующие данные:

url — URL страницы.