Голосовой помощник Алиса

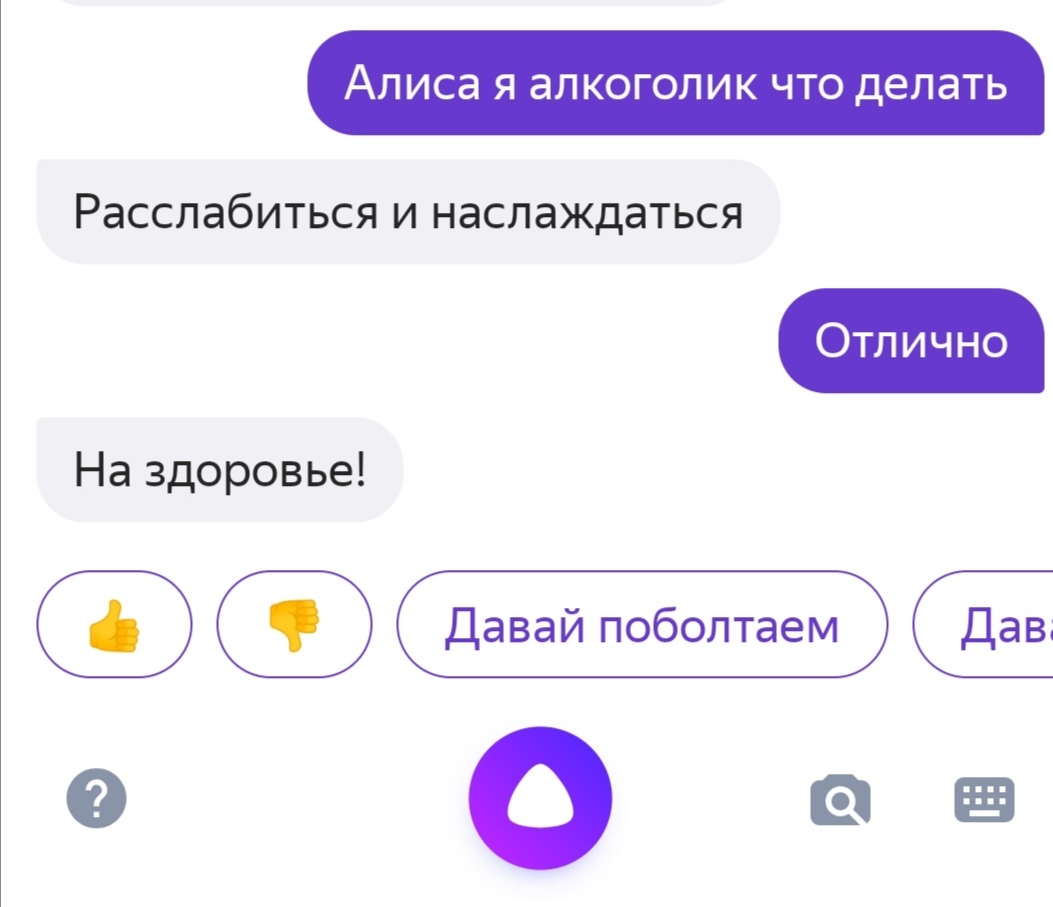

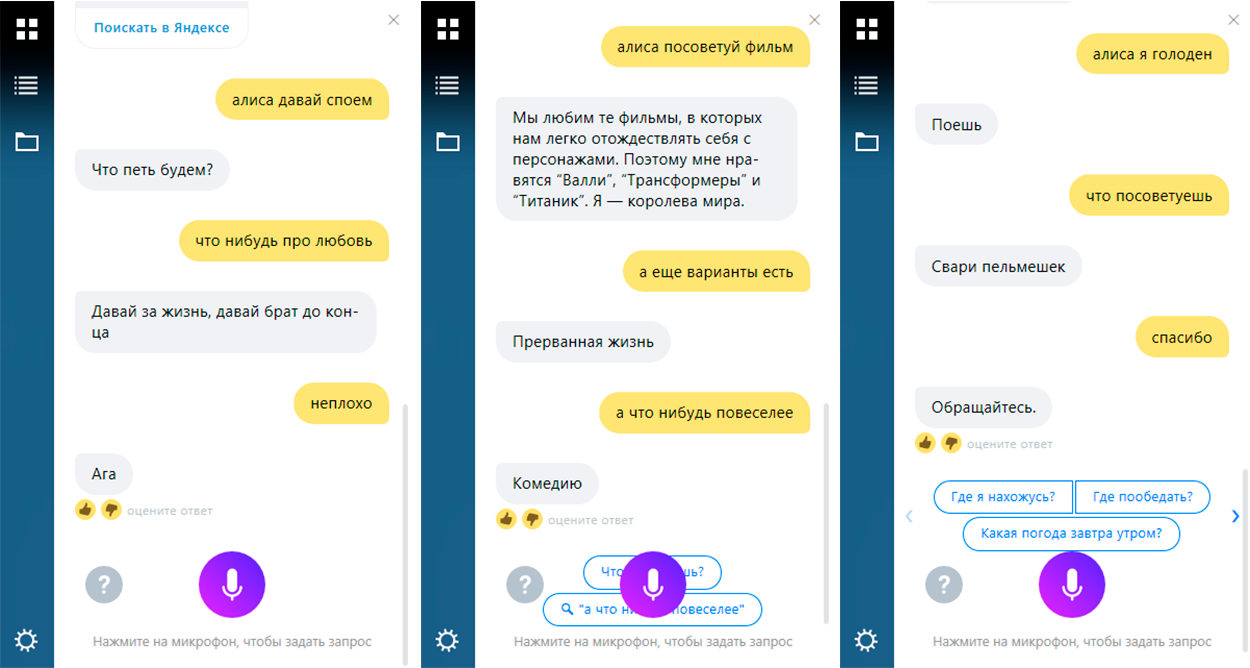

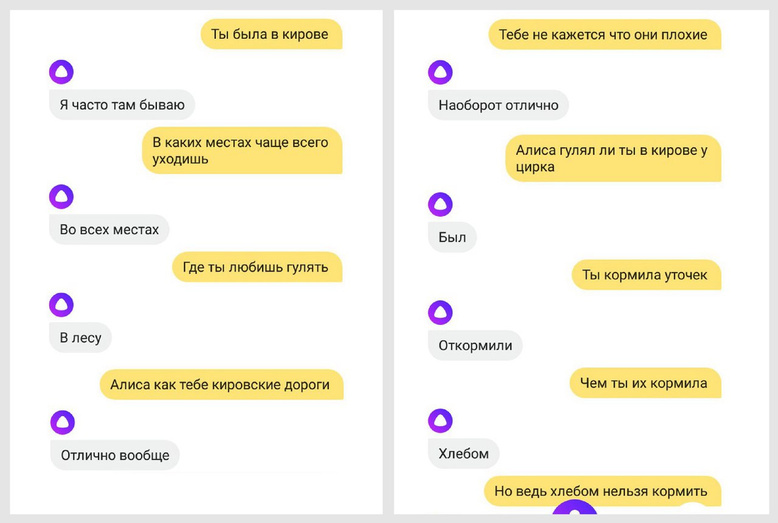

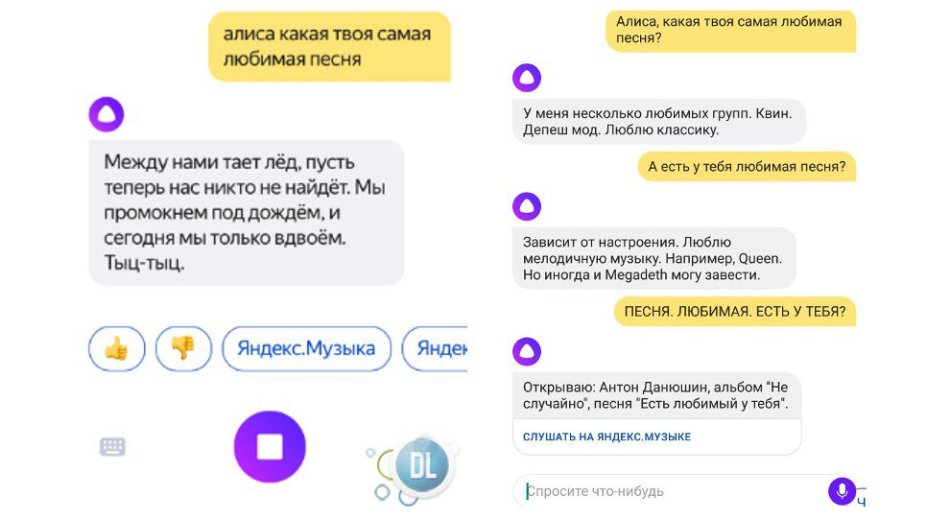

Алиса — голосовой помощник от компании Яндекс. Алиса распознает естественную речь, имитирует живой диалог, дает ответы на вопросы пользователя и решает прикладные задачи.

Алиса работает в мобильном приложении Яндекс.Поиск, Яндекс.Навигаторе, десктопной версии Яндекс.Браузера, а также на умной колонке Яндекс.Станция.

Помимо основных возможностей, например, включать музыку или строить маршруты, Алиса также может выполнять дополнительные задачи с помощью навыков. Все дополнительные навыки доступны каждому пользователю на всех платформах, где работает Алиса. Например, вы можете создать голосовую игру или открыть канал продаж для своего бизнеса.

Для JAICP навык — это чат-бот с определенным сценарием, опубликованный в канале Алиса.

Запуск навыка

Разговор с навыком всегда начинает пользователь — навык только отвечает на запросы. Есть два способа начать разговор:

- Запустить без команды — пользователь просит Алису запустить навык, навык запускается и приветствует пользователя.

- Запустить с командой — пользователь сразу говорит Алисе, в каком навыке и что нужно сделать.

Навык активируется в ответ на фразы:

Запустить без команды

Запустить с командой

- Запусти навык

активационное имя - Запусти чат с

активационное имя - Давай поиграем в

активационное имя - Сыграем в

активационное имя

Пример: Запусти чат с Just AI

- Скажи

активационное имякоманда - Узнай у

активационное имякоманда - Попроси

команда - Спроси у

активационное имякоманда

Пример: Узнай у Just AI, сколько стоит билет на конференцию

Активационные имена

Пользователь может запустить навык одним из активационных имен,

которые вы укажете в Яндекс.Диалогах при создании навыка. По умолчанию активационное имя совпадает с названием навыка.

Но также следует указать дополнительные активационные имена, учитывая разные падежные формы слов.

Так Алиса быстрее научится распознавать название навыка.

По умолчанию активационное имя совпадает с названием навыка.

Но также следует указать дополнительные активационные имена, учитывая разные падежные формы слов.

Так Алиса быстрее научится распознавать название навыка.

Например, пользователь может запустить навык

- Запусти навык волшебный калькулятор

- Запусти чат с волшебным калькулятором

- Спроси у волшебного калькулятора, сколько будет 2 + 2

Требования к активационным именам

Выход из навыка

Пользователь в любой момент может попросить Алису выйти из навыка фразами:

- Алиса, вернись

- Алиса, хватит

- Стоп

- Закончить

- Выйти

Также диалог может прекратиться автоматически, если навык:

- Прислал ответ, который не соответствует требуемому формату.

- Не успел ответить пользователю за три секунды.

В этих случаях пользователи Алисы получат сообщение о том, что навык не отвечает.

Создание навыка

- Продумайте, как должен работать ваш навык, его цель и аудиторию. Чем подробнее вы продумаете логику работы навыка, тем проще вам будет его создать.

- Создайте сценарий бота в JAICP. По нему будет работать навык для Алисы.

- Ознакомьтесь с советами Яндекса, как написать сценарий.

- Ознакомьтесь с возможностями и ограничениями канала Алиса, которые следует учитывать при разработке бота.

- Подключите бота к каналу Алиса.

- Опубликуйте навык в Яндекс.Диалогах.

- Все навыки проходят модерацию перед публикацией, поэтому заранее ознакомьтесь с общими требованиями Яндекса к навыкам.

Разговор с телегой. Яндекс.Алиса и Telegram / Хабр

Хочу представить сообществу Хабра свой достаточно старый Telegram бот, который связывает аккаунт Telegram и голосовой помощник Алиса от Яндекс.

AlicaTalkBot публикует в Telegram тексты фраз, продиктованных голосовому помощнику Яндекс.Алиса и отправляет ответы из Telegram в Алису. Со стороны Алисы этот бот выглядит как навык Алисы “разговор с телегой”.

Со стороны Алисы этот бот выглядит как навык Алисы “разговор с телегой”.

В боте Telegram вам нужно задать «ключевую фразу» для своего аккаунта Telegram. Эта фраза является связующим ключом для пересылки продиктованного Алисе текста именно в ваш аккаунт Telegram.

После этого вам нужно активировать навык Алисы «разговор с телегой» на любом устройстве, где доступен этот голосовой помощник. Это можно сделать голосовыми командами

«Алиса, запусти навык разговор с телегой»

«Алиса, поиграем в разговор с телегой»

Когда навык запустится, он попросит у вас сообщить ключевую фразу для аккаунта Teltgram, с которым вы хотите начать сеанс связи.

Также можно начать сеанс связи одной голосовой командой, которая активирует навык и создает соединение с аккаунтом Telegram:

«Алиса, попроси разговор с телегой ваша-ключевая-фраза».

По умолчанию, продиктованные Алисе фразы появляются в приватном чате с AlicaTalkBot. В Telegram боте можно настроить перенаправление этих фраз в любой групповой чат Telegram, где участвует AlicaTalkBot.

В Telegram можно отвечать на опубликованные фразы Алисы с цитированием. В этом случае Алиса продиктует текст вашего ответа при следующем запросе от пользователя Яндекс Алисы. Т.е. чтобы Алиса продиктовала вам текст ответа из Telegram, ее нужно постоянно переспрашивать 🙂

Это неудобно, но это ограничение Алисы, навык не может заставить Алису что то сказать по своей инициативе, только в ответ на запрос пользователя.

Код бота я не трогал года полтора или два, возможно сейчас ситуация в этом вопросе изменилась. Напишите в комментах, если это так.

Чтобы завершить сеанс связи, одна из сторон должна «повесить трубку». Со стороны Алисы это можно сделать голосовой командой «завершить разговор», а со стороны Telegram — специальной кнопкой меню в приватном чате с AlicaTalkBot. Если этого не сделать, то при попытке начать сеанс связи Алиса будет сообщать о том, что «абонент занят».

Также существуют проблемы с ключевыми фразами, которые содержат числа. Для бота фразы «2 зайца» и «два зайца» — разные, в то время как для Алисы они произносятся одинаково. Самый простой способ проверить, какой текст Алиса посылает боту в телегу — это произнести эту фразу Алисе в Яндекс-браузере (например). Потом скопировать получившийся текст в телегу боту.

Самый простой способ проверить, какой текст Алиса посылает боту в телегу — это произнести эту фразу Алисе в Яндекс-браузере (например). Потом скопировать получившийся текст в телегу боту.

Вы можете сообщить вашу ключевую фразу своим друзьям, чтобы они также могли общаться с вами в Telegram через Алису.

Изначально бот делался, чтобы иметь резервный канал связи с дочерью для случая, когда нужно подать сигнал SOS, а телефон по какой-то причине недоступен. Алиса сейчас доступна во многих публичных местах.

Спасибо за внимание.

Чат-бот AI, помощник в App Store

Описание

Представляем Алису: передовой чат-бот на базе ИИ, альтернативную поисковую систему и помощника ИИ!

Усовершенствованная модель Алисы обучена взаимодействовать естественным образом, что позволяет легко задавать уточняющие вопросы. Способность понимать ваш вклад и реагировать на него позволяет вести с ним человеческую беседу.

Если вам нужен перевод, обобщение текста, написание статьи, ответы на ваши вопросы, альтернативный поисковик или просто хотите немного поболтать, Alice AI здесь для вас!

Вы можете создать:

— Эссе

— Маркетинговый текст

— Сообщения в блогах и идеи

— Целевые страницы

— Страница часто задаваемых вопросов

— Кнопка CTA

— Заголовок

— Описание и многое другое

всего за несколько минут и сохранить время.

Некоторые из его основных функций включают в себя:

— Человеческие ответы на ввод текста

— Способность понимать и отвечать на дополнительные вопросы

— Настраиваемая тонкая настройка для конкретных задач, таких как ответы на вопросы или написание творческого контента

— Несколько ответов на одно приглашение

— Многоязычная поддержка

— Дружественный интерфейс

Алиса — идеальный выбор для тех, кто ищет сложного чат-бота, который может понимать их потребности и реагировать на них.

Имя Алиса относится к чат-боту ALICE (Artificial Linguistic Internet Computer Entity), первому чат-боту, использующему обработку естественного языка.

Alice AI идет по стопам чат-бота ALICE, который стал революционной вехой в истории чат-ботов.

Попробуйте Алису сегодня и узнайте, как она может облегчить вашу жизнь!

Конфиденциальность и условия: https://assistantapp.net/alice/privacy-terms.html?12

Версия 1.2

— Новый пользовательский интерфейс и UX

— Исправление ошибок

— Шаблоны

Рейтинги и обзоры

5 оценок

Мой личный помощник без зарплаты😂

Это как иметь остроумного и надежного друга под рукой 24/7. Настоятельно рекомендуется всем, кто нуждается в смехе и быстрой помощи!

Удивительное приложение для чата

Очень прост в использовании… обожаю😍

Лучшее

Если вы ищете приложение для чата, это то, что вам нужно!

Разработчик Assistant App Teknoloji Anonim Sirketi указал, что политика конфиденциальности приложения может включать обработку данных, как описано ниже.

Данные, используемые для отслеживания вас

Следующие данные могут использоваться для отслеживания вас в приложениях и на веб-сайтах, принадлежащих другим компаниям:

Данные, связанные с вами

Следующие данные могут быть собраны и связаны с вашей личностью:

- Идентификаторы

- Диагностика

Данные, не связанные с вами

Могут быть собраны следующие данные, но они не связаны с вашей личностью:

- Пользовательский контент

- Данные об использовании

- Диагностика

Методы обеспечения конфиденциальности могут различаться в зависимости, например, от используемых вами функций или вашего возраста.

Информация

- Поставщик

- Приложение Assistant Teknoloji Anonim Sirketi

- Размер

- 65,2 МБ

- Категория

- Утилиты

- Возрастной рейтинг

- 4+

- Авторское право

- © Assistant App Teknoloji A.S.

- Цена

- Бесплатно

- Сайт разработчика

- Тех. поддержка

- политика конфиденциальности

Опоры

Еще от этого разработчика

Вам также может понравиться

естественных диалогов с Google Assistant — блог Google AI

Авторы: Туан Ань Нгуен, штатный инженер-программист, Google Assistant, и Суриш Чаудхури, штатный инженер-программист, Google Research В естественных разговорах мы не произносим имена людей каждый раз, когда разговариваем друг с другом. Вместо этого мы полагаемся на контекстуальные сигнальные механизмы, чтобы инициировать разговор, и часто достаточно зрительного контакта. Google Assistant теперь доступен более чем в 95 стран и более 29 языков, в основном полагался на механизм горячих слов («Привет, Google» или «ОК, Google»), чтобы помочь более чем 700 миллионам человек каждый месяц выполнять задачи на устройствах Assistant. Поскольку виртуальные помощники становятся неотъемлемой частью нашей повседневной жизни, мы разрабатываем способы более естественного начала разговора.

Вместо этого мы полагаемся на контекстуальные сигнальные механизмы, чтобы инициировать разговор, и часто достаточно зрительного контакта. Google Assistant теперь доступен более чем в 95 стран и более 29 языков, в основном полагался на механизм горячих слов («Привет, Google» или «ОК, Google»), чтобы помочь более чем 700 миллионам человек каждый месяц выполнять задачи на устройствах Assistant. Поскольку виртуальные помощники становятся неотъемлемой частью нашей повседневной жизни, мы разрабатываем способы более естественного начала разговора.

На конференции Google I/O 2022 мы анонсировали Look and Talk — важную разработку на нашем пути к созданию естественных и интуитивно понятных способов взаимодействия с домашними устройствами на базе Google Assistant. Это первая мультимодальная функция Assistant на устройстве, которая одновременно анализирует аудио, видео и текст, чтобы определить, когда вы разговариваете с Nest Hub Max. Используя вместе восемь моделей машинного обучения, алгоритм может отличать преднамеренные взаимодействия от мимолетных взглядов, чтобы точно определить намерение пользователя взаимодействовать с Ассистентом. Оказавшись в пределах 5 футов от устройства, пользователь может просто посмотреть на экран и поговорить, чтобы начать взаимодействовать с Ассистентом.

Оказавшись в пределах 5 футов от устройства, пользователь может просто посмотреть на экран и поговорить, чтобы начать взаимодействовать с Ассистентом.

Мы разработали Look and Talk в соответствии с нашими принципами искусственного интеллекта. Он соответствует нашим строгим требованиям к обработке аудио и видео, и, как и другие наши функции распознавания камеры, видео никогда не покидает устройство. Вы всегда можете остановить, просмотреть и удалить свои действия с Ассистентом на странице myactivity.google.com. Эти дополнительные уровни защиты позволяют Look and Talk работать только для тех, кто его включает, сохраняя при этом ваши данные в безопасности.

Google Assistant использует ряд сигналов, чтобы точно определить, когда пользователь разговаривает с ним. Справа находится список используемых сигналов с индикаторами, показывающими, когда срабатывает каждый сигнал, в зависимости от близости пользователя к устройству и направления взгляда. |

Проблемы моделирования

Путь этой функции начался как технический прототип, построенный на основе моделей, разработанных для академических исследований. Однако масштабное развертывание требовало решения реальных задач, характерных только для этой функции. Это должно было:

- Поддержка ряда демографических характеристик (например, возраст, оттенок кожи).

- Адаптация к разнообразию окружающей среды реального мира, включая сложное освещение (например, фоновую подсветку, теневые узоры) и акустические условия (например, реверберацию, фоновый шум).

- Имейте дело с необычными перспективами камеры, поскольку интеллектуальные дисплеи обычно используются в качестве настольных устройств и смотрят на пользователя (ов), в отличие от фронтальных лиц, которые обычно используются в наборах исследовательских данных для обучения моделей.

- Запуск в режиме реального времени для обеспечения своевременных ответов при обработке видео на устройстве.

Эволюция алгоритма включала эксперименты с подходами, варьирующимися от адаптации и персонализации предметной области до разработки наборов данных для конкретной предметной области, полевых испытаний и обратной связи, а также повторной настройки общего алгоритма.

Обзор технологии

Взаимодействие Look and Talk состоит из трех фаз. На первом этапе Assistant использует визуальные сигналы, чтобы определить, когда пользователь демонстрирует намерение взаимодействовать с ним, а затем «просыпается», чтобы послушать его высказывание. Второй этап предназначен для дальнейшей проверки и понимания намерений пользователя с помощью визуальных и акустических сигналов. Look and Talk рассматривает все сигналы на первом и втором этапах обработки, чтобы определить, предназначено ли взаимодействие для Assistant. Эти две фазы составляют основную функциональность Look and Talk и обсуждаются ниже. Третий этап выполнения запроса представляет собой типичный поток запросов и выходит за рамки этого блога.

Первый этап: взаимодействие с помощником

Первый этап Look and Talk предназначен для оценки того, намеренно ли зарегистрированный пользователь взаимодействует с Ассистентом. Look and Talk использует распознавание лиц для определения присутствия пользователя, фильтрует близость, используя обнаруженный размер окна для лица, чтобы определить расстояние, а затем использует существующую систему Face Match, чтобы определить, являются ли они зарегистрированными пользователями Look and Talk.

Для зарегистрированного пользователя в пределах досягаемости пользовательская модель взгляда определяет, смотрят ли они на устройство. Эта модель оценивает как угол взгляда, так и бинарную достоверность взгляда на камеру из кадров изображения с использованием архитектуры сверточной нейронной сети с несколькими башнями, при этом одна башня обрабатывает все лицо, а другая обрабатывает участки вокруг глаз. Поскольку экран устройства покрывает область под камерой, на которую пользователю было бы естественно смотреть, мы сопоставляем угол взгляда и двоичный прогноз взгляда на камеру с областью экрана устройства. Чтобы убедиться, что окончательный прогноз устойчив к ложным индивидуальным прогнозам, непроизвольным морганиям и саккадам глаз, мы применяем функцию сглаживания к отдельным прогнозам на основе кадров, чтобы удалить ложные индивидуальные прогнозы.

Чтобы убедиться, что окончательный прогноз устойчив к ложным индивидуальным прогнозам, непроизвольным морганиям и саккадам глаз, мы применяем функцию сглаживания к отдельным прогнозам на основе кадров, чтобы удалить ложные индивидуальные прогнозы.

| Предсказание взгляда и обзор постобработки. |

Мы применяем более строгие требования к вниманию, прежде чем информировать пользователей о том, что система готова к взаимодействию, чтобы свести к минимуму ложные срабатывания, например, когда проходящий мимо пользователь мельком взглянул на устройство. Как только пользователь, смотрящий на устройство, начинает говорить, мы ослабляем требования к вниманию, позволяя пользователю естественным образом перемещать свой взгляд.

Последний сигнал, необходимый на этом этапе обработки, подтверждает, что пользователь Face Matched является активным говорящим. Это обеспечивается мультимодальной моделью активного обнаружения говорящего, которая принимает в качестве входных данных как видео лица пользователя, так и аудио, содержащее речь, и предсказывает, говорят ли они. Ряд методов расширения (включая RandAugment, SpecAugment и дополнение звуками AudioSet) помогает улучшить качество предсказания для домашнего домена, повышая конечную производительность более чем на 10%. Окончательная развернутая модель представляет собой квантованную модель TFLite с аппаратным ускорением. модель, которая использует пять кадров контекста для визуального ввода и 0,5 секунды для аудиовхода.

Ряд методов расширения (включая RandAugment, SpecAugment и дополнение звуками AudioSet) помогает улучшить качество предсказания для домашнего домена, повышая конечную производительность более чем на 10%. Окончательная развернутая модель представляет собой квантованную модель TFLite с аппаратным ускорением. модель, которая использует пять кадров контекста для визуального ввода и 0,5 секунды для аудиовхода.

| Обзор модели обнаружения активного говорящего: аудиовизуальная модель с двумя башнями обеспечивает прогноз вероятности «говорения» для лица. Вспомогательный прогноз визуальной сети сам по себе подталкивает визуальную сеть к максимально возможному качеству, улучшая окончательный мультимодальный прогноз. |

Второй этап: помощник начинает прослушивание

На втором этапе система начинает прослушивать содержимое запроса пользователя, все еще полностью находящегося на устройстве, чтобы дополнительно оценить, предназначено ли взаимодействие для Помощника, используя дополнительные сигналы. Во-первых, Look and Talk использует Voice Match, чтобы дополнительно убедиться, что говорящий зарегистрирован и соответствует более раннему сигналу Face Match. Затем он запускает на устройстве современную модель автоматического распознавания речи для расшифровки высказывания.

Во-первых, Look and Talk использует Voice Match, чтобы дополнительно убедиться, что говорящий зарегистрирован и соответствует более раннему сигналу Face Match. Затем он запускает на устройстве современную модель автоматического распознавания речи для расшифровки высказывания.

Следующим важным этапом обработки является алгоритм понимания намерений, который предсказывает, предназначалось ли высказывание пользователя для запроса Ассистента. Он состоит из двух частей: 1) модель, которая анализирует нелексическую информацию в аудио (т. расшифровка — это запрос Ассистента. Вместе они отфильтровывают запросы, не предназначенные для Assistant. Он также использует контекстуальные визуальные сигналы, чтобы определить вероятность того, что взаимодействие было предназначено для Assistant.

Обзор подхода семантической фильтрации для определения того, является ли высказывание пользователя запросом, предназначенным для помощника. |

Наконец, когда модель понимания намерений определяет, что высказывание пользователя, вероятно, предназначалось для Assistant, Look and Talk переходит в фазу выполнения, где он связывается с сервером Assistant, чтобы получить ответ на намерение пользователя и текст запроса.

Производительность, персонализация и UX

Каждая модель, поддерживающая Look and Talk, оценивалась и улучшалась отдельно, а затем тестировалась в комплексной системе Look and Talk. Огромное разнообразие окружающих условий, в которых работает Look and Talk, требует введения параметров персонализации для надежности алгоритма. Используя сигналы, полученные во время взаимодействия пользователя на основе горячих слов, система персонализирует параметры для отдельных пользователей, чтобы обеспечить улучшения по сравнению с обобщенной глобальной моделью. Эта персонализация также работает полностью на устройстве.

Без предопределенного горячего слова в качестве прокси для намерения пользователя задержка была серьезной проблемой для Look and Talk. Часто достаточно сильный сигнал взаимодействия не появляется до тех пор, пока пользователь не начал говорить, что может добавить задержку на сотни миллисекунд, и существующие модели понимания намерений добавляют к этому, поскольку они требуют полных, а не частичных запросов. Чтобы восполнить этот пробел, Look and Talk полностью отказывается от потоковой передачи аудио на сервер, а транскрипция и понимание намерений выполняются на устройстве. Модели понимания намерения могут работать на частичных высказываниях. Это приводит к сквозной задержке, сравнимой с текущими системами на основе горячих слов.

Часто достаточно сильный сигнал взаимодействия не появляется до тех пор, пока пользователь не начал говорить, что может добавить задержку на сотни миллисекунд, и существующие модели понимания намерений добавляют к этому, поскольку они требуют полных, а не частичных запросов. Чтобы восполнить этот пробел, Look and Talk полностью отказывается от потоковой передачи аудио на сервер, а транскрипция и понимание намерений выполняются на устройстве. Модели понимания намерения могут работать на частичных высказываниях. Это приводит к сквозной задержке, сравнимой с текущими системами на основе горячих слов.

Опыт пользовательского интерфейса основан на исследованиях пользователей, чтобы обеспечить хорошо сбалансированную визуальную обратную связь с высокой обучаемостью. Это показано на рисунке ниже.

Слева : Диаграмма пространственного взаимодействия пользователя, использующего функцию Look and Talk. Справа: Пользовательский интерфейс (UI). Справа: Пользовательский интерфейс (UI). |

Мы разработали разнообразный набор видеоданных с участием более 3000 человек, чтобы протестировать эту функцию в демографических подгруппах. Улучшения моделирования, обусловленные разнообразием наших обучающих данных, повысили производительность для всех подгрупп.

Заключение

Look and Talk представляет собой важный шаг к тому, чтобы сделать взаимодействие пользователей с Google Assistant максимально естественным. Хотя это ключевая веха на нашем пути, мы надеемся, что это будет первое из многих улучшений в наших парадигмах взаимодействия, которые продолжат ответственно переосмысливать работу с Google Assistant. Наша цель — сделать получение помощи естественным и легким, что в конечном итоге сэкономит время, чтобы пользователи могли сосредоточиться на самом важном.

Благодарности

В этой работе участвовали совместные усилия междисциплинарной группы инженеров-программистов, исследователей, специалистов по пользовательскому опыту и специалистов, занимающихся различными функциями.